hbase核心切分流程七步

社区干货

社区干货

9年演进史:字节跳动 10EB 级大数据存储实战

HBase,日志服务,Kafka 数据存储 - Yarn,Flink 的计算框架平台数据 - Spark,MapReduce 的计算相关数据存储![]()# **字节跳动特色的** **HDFS** **架构**在深入相关的技术细节之前,我们先看看字节跳动的 H... 用户文件被切分成块,复制成多副本,每个副本都存在不同的 Data Node 上,以达到容错容灾的效果。每个副本在 Data Node 上都以文件的形式存储,元信息在启动时被加载到内存中。Data Node 会定时向 Name Node 做心跳汇...

干货| 火山引擎DataLeap的Data Catalog系统公有云实践

内外部CICD和监控报警流程一致性等方面。* **数据库和中间件:** 是和业界主流云厂商对齐的存储和中间件领域的标准云服务,和公司内部对应组件也会有若干差异,Data Catalog为此也做了多版本的兼容。Data Catalog在元数据存储上使用到了Hbase/MySQL/ES/Redis,然后在元数据采集和同步场景使用了Kafka,同时用到了日志服务来提高研发运维效率。  特惠活动

特惠活动

hbase核心切分流程七步-优选内容

hbase核心切分流程七步-优选内容

hbase核心切分流程七步-相关内容

hbase核心切分流程七步-相关内容

火山引擎DataLeap的Data Catalog系统公有云实践

目前Data Catalog作为火山引擎大数据研发治理套件DataLeap产品的核心功能之一,经过多年打磨,服务于字节跳动内部几乎所有核心业务线,解决了数据生产者和消费者对于元数据和资产管理的各项核心需求。DataLeap作为一... Data Catalog在元数据存储上使用到了Hbase/MySQL/ES/Redis,然后在元数据采集和同步场景使用了Kafka,同时用到了日志服务来提高研发运维效率。# Data Catalog公有云遇到的挑战Data Catalog经历了一个从0到1在火山...

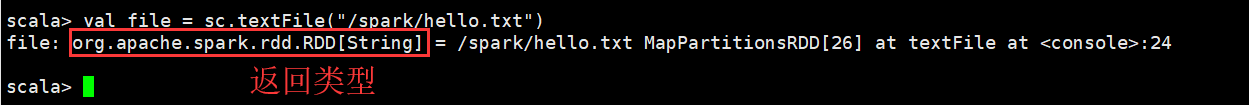

万字长文,Spark 架构原理和 RDD 算子详解一网打进! | 社区征文

### 1.1 Spark架构核心组件```### 3.2 通过并行化的方式创建RDD由一个已经存在的Scala集...

数据库顶会 VLDB 2023 论文解读 - Krypton: 字节跳动实时服务分析 SQL 引擎设

结果通过 ETL 导入到 HBase/ES/ClickHouse 等系统提供在线的查询服务。对于实时链路, 数据会直接进入到 HBase/ES 提供高并发低时延的在线查询服务,另一方面数据会流入到 ClickHouse/Druid 提供在线的查询聚合服务。... 展示了一个 Query 的执行流程。Coordinator 会把优化过的 Query 生成 Fragments 并下发给一组 Data Servers 来执行。比如上图的 Query 生成了两组 Fragments:Fragment 0 和 Fragment 1。Fragment 1 负责执行两表的...

ByConity 技术详解之 ELT

将结果写入HBase或MySQL中再去取数据,将数据取出后作展示。Flink还会去直接暴露中间状态的接口,即queryable state,让用户更好的使用状态数据。但是最后还会与批计算的结果完成对数,如果不一致,需要进行回查操作,整个过程考验运维/开发同学的功力。- **湖仓** **一体&HxxP**:将数据湖与数据仓库结合起来。## ELT in ByConity### 整体执行流程