mongodb格式化输出

社区干货

社区干货

2022技术盘点之平台云原生架构演进之道|社区征文

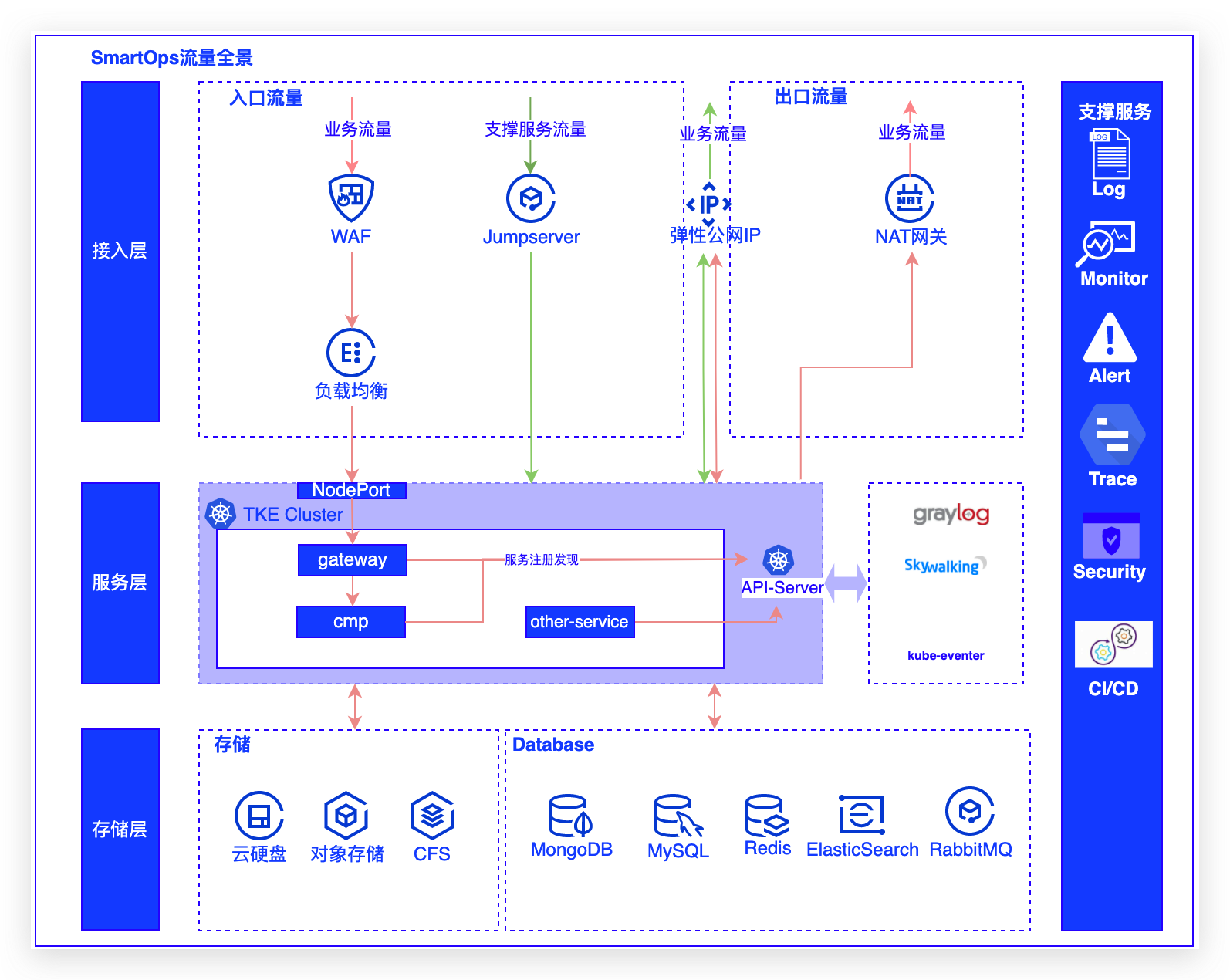

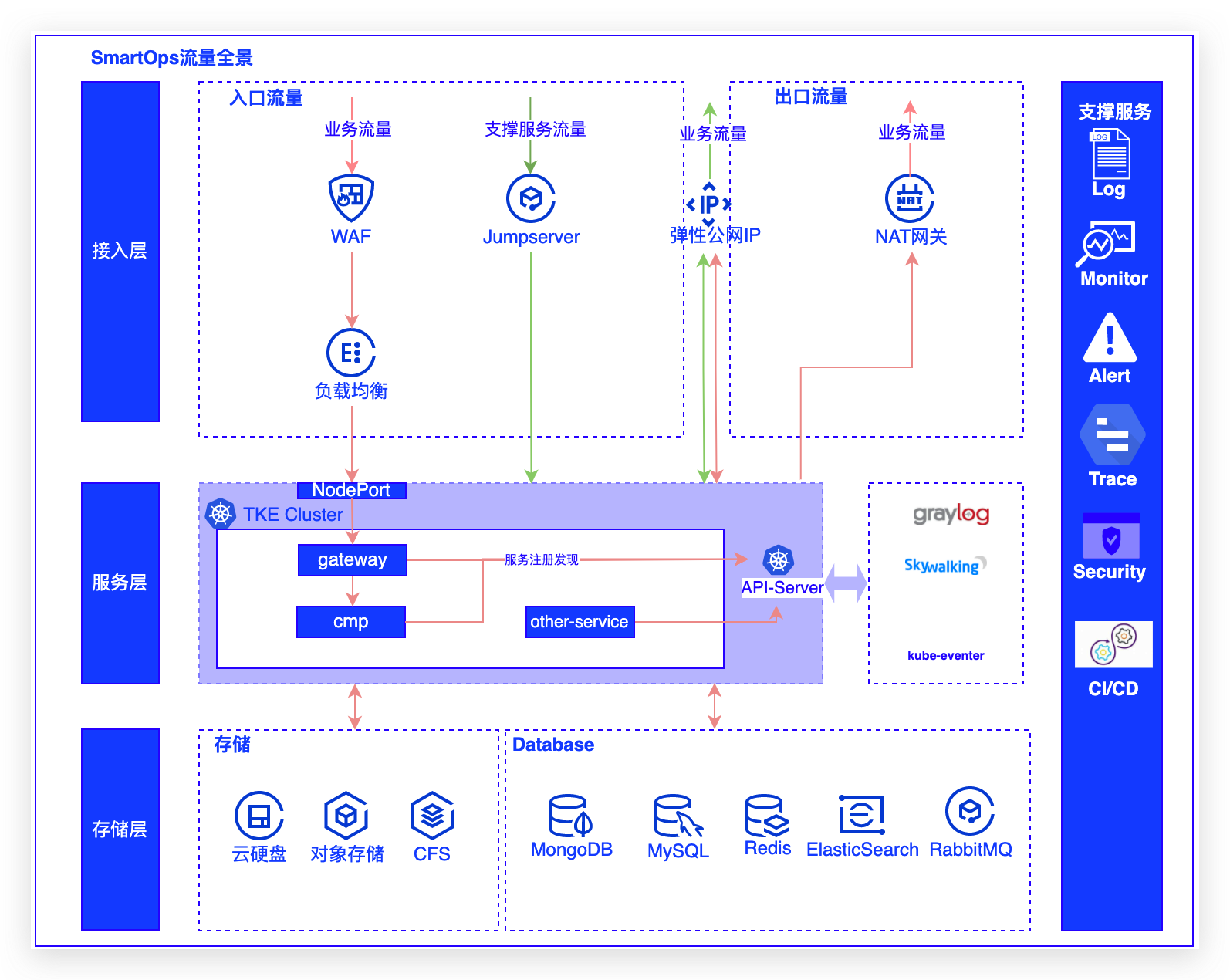

数据库有MongoDB分片集群/MySQL/Redis/ElasticSearch/RabbitMQ进行各类业务数据计算和存储## 三 流量管控### 3.1 南北流量业务流量:业务流量入口最外层经过WAF进行安全防护,之后进入到腾讯云公网负载均衡,负载均衡后管理到TKE集群的NodePort实现流量接入;出口通过NAT网关实现流量分发。其他服务:其他支撑服务,如堡垒机...

火山引擎上云迁移指南(一):上云迁移背景与流程

依据应用分析和风险评估输出结果,拆分业务的服务组件,匹配火山引擎云产品,根据不同业务的需求,制定如下迁移策略。 | 类别 | 说明 | | --- | --- | | 无数据迁移诉求的服务 | - 针对云上网络架构:规划配置VPC,I... MongoDB | 文档数据库MongoDB版 | 火山引擎DTS || ^^ | HBase | 表格数据库HBase版 | 火山引擎DTS |#### 功能和性能验证基于云迁移调研评估步骤中梳理的业务涉及产品功能和性能,结合迁移方案设计,验证产品功...

使用mysql-sniffer 查看MySQL当前执行的语句

# 前言在某些特定的问题排查场景下,或者需要复现问题,我们可能需要开启general log 来查看 MySQL 实时运行的 SQL 语句,以此来缩小问题的范围。general log 会记录所有的SQL语句,无论语句是否正确执行或者是由于语法错误而终止执行。同时开启 general log 在实例负载比较大的情况下了能会对服务器性能产生影响,这里推荐一个好用的工具,它基于 MySQL 协议的抓包工具,实时抓取 MySQL Server 端的请求,并格式化输出。# 工具安装##...

使用 mysql-sniffer 查看MySQL当前执行的语句

# 前言在某些特定的问题排查场景下,或者需要复现问题,我们可能需要开启general log 来查看 MySQL 实时运行的 SQL 语句,以此来缩小问题的范围。general log 会记录所有的SQL语句,无论语句是否正确执行或者是由于语法错误而终止执行。同时开启 general log 在实例负载比较大的情况下了能会对服务器性能产生影响,这里推荐一个好用的工具,它基于 MySQL 协议的抓包工具,实时抓取 MySQL Server 端的请求,并格式化输出。# 工具安装...

特惠活动

特惠活动

mongodb格式化输出-优选内容

mongodb格式化输出-优选内容

mongodb格式化输出-相关内容

mongodb格式化输出-相关内容

快速开始

1 执行格式化一个新的分布式文件系统: $ bin/hadoop namenode -format 启动Hadoop守护进程: $ bin/start-all.shHadoop守护进程的日志写入到 ${HADOOP_LOG_DIR} 目录 (默认是 ${HADOOP_HOME}/logs). 浏览NameNode网... 输出文件从分布式文件系统拷贝到本地文件系统查看: $ bin/hadoop fs -get output output$ cat output/*或者在分布式文件系统上查看输出文件: $ bin/hadoop fs -cat output/* 完成全部操作后,停止守护进程: $ bin/s...

2022技术盘点之平台云原生架构演进之道|社区征文

数据库有MongoDB分片集群/MySQL/Redis/ElasticSearch/RabbitMQ进行各类业务数据计算和存储## 三 流量管控### 3.1 南北流量业务流量:业务流量入口最外层经过WAF进行安全防护,之后进入到腾讯云公网负载均衡,负载均衡后管理到TKE集群的NodePort实现流量接入;出口通过NAT网关实现流量分发。其他服务:其他支撑服务,如堡垒机...

数据快车简介

NoSQL数据库(如MongoDB)、实时流(Kafka)、对象存储(AWS S3、TOS、OSS)等。 数据结构映射和转换:数据快车服务能够处理不同数据源之间的数据结构差异,并提供自动的映射和转换功能。它将数据源的字段映射到ByteHouse中对应的表和列,执行数据类型转换、数据格式化等操作,以确保数据在导入过程中的一致性和准确性。 高效数据导入:数据快车服务通过优化数据导入的方式和过程,实现高效的数据传输和加载。它采用批量导入、并行导入、增量...

数据快车简介

NoSQL数据库(如MongoDB)、实时流(Kafka)、对象存储(AWS S3、TOS、OSS)等。 数据结构映射和转换:数据快车服务能够处理不同数据源之间的数据结构差异,并提供自动的映射和转换功能。它将数据源的字段映射到ByteHouse中对应的表和列,执行数据类型转换、数据格式化等操作,以确保数据在导入过程中的一致性和准确性。 高效数据导入:数据快车服务通过优化数据导入的方式和过程,实现高效的数据传输和加载。它采用批量导入、并行导入、增量...

实时任务

输出为实时更新的数据。实时任务支持输入的数据源为:Kafka、Pulsar; 离线任务,指的是任务跟随离线更新的数据源可被设置为手动和周期执行,输出为定期更新的数据或模型文件。离线任务支持输入的数据源为:Hive, MySQL, ClickHouse, Kafka, HttpAPI, 飞书, CSV/Excel, Oracle, Impala, PostgreSQL, Hbase, SQLServer, MaxCompute, ADB, MongoDB, Hana, Teradata, Db2, Vertica, GreenPlum等20余种主流的数据源; 本文将结合产品实...

离线任务

输出为实时更新的数据。实时任务支持输入的数据源为:Kafk、Pulsar; 离线任务,指的是任务跟随离线更新的数据源可被设置为手动和周期执行,输出为定期更新的数据或模型文件。离线任务支持输入的数据源为:Hive, MySQL, ClickHouse, Kafka, HttpAPI, 飞书, CSV/Excel, Oracle, Impala, PostgreSQL, Hbase, SQLServer, MaxCompute, ADB, MongoDB, Hana, Teradata, Db2, Vertica, GreenPlum等20余种主流的数据源; 本文将结合产品实操...

任务创建

将处理完成的数据输出到目标源中。 任务类型:实时任务、离线任务;实时任务支持 Kafka、Pulsar,离线任务支持的输入数据源如下;实时任务默认不开启; 已支持的离线任务的输入数据源:Hive, MySQL, ClickHouse, Kafka, HttpAPI, 飞书, CSV/Excel, Oracle, Impala, PostgreSQL, Hbase, SQLServer, MaxCompute, ADB, MongoDB, Hana, Teradata, Db2, Vertica, GreenPlum等20几种主流的数据源 已支持数据清洗节点:字段设置、筛选行、添加...

功能发布记录(2023年)

整库实时解决方案新增支持 MongoDB 数据源读取。 实时分库分表解决方案 ByteHouse CDW 任务配置 实时整库同步解决方案 2023/09/27序号 功能 功能描述 使用文档 1 数据开发 数据开发界面支持任务批量删除... 工作台 治理全景 规划诊断 SLA 保障 资源优化 复盘管理 2023/07/03序号 功能 功能描述 使用文档 1 数据开发 EMR Spark 任务类型支持 python 语言方式输出。 Shell\Python 任务支持使用独享资源组私有镜像...

火山引擎上云迁移指南(一):上云迁移背景与流程

依据应用分析和风险评估输出结果,拆分业务的服务组件,匹配火山引擎云产品,根据不同业务的需求,制定如下迁移策略。 | 类别 | 说明 | | --- | --- | | 无数据迁移诉求的服务 | - 针对云上网络架构:规划配置VPC,I... MongoDB | 文档数据库MongoDB版 | 火山引擎DTS || ^^ | HBase | 表格数据库HBase版 | 火山引擎DTS |#### 功能和性能验证基于云迁移调研评估步骤中梳理的业务涉及产品功能和性能,结合迁移方案设计,验证产品功...