mongodb安静输出

社区干货

社区干货

2022技术盘点之平台云原生架构演进之道|社区征文

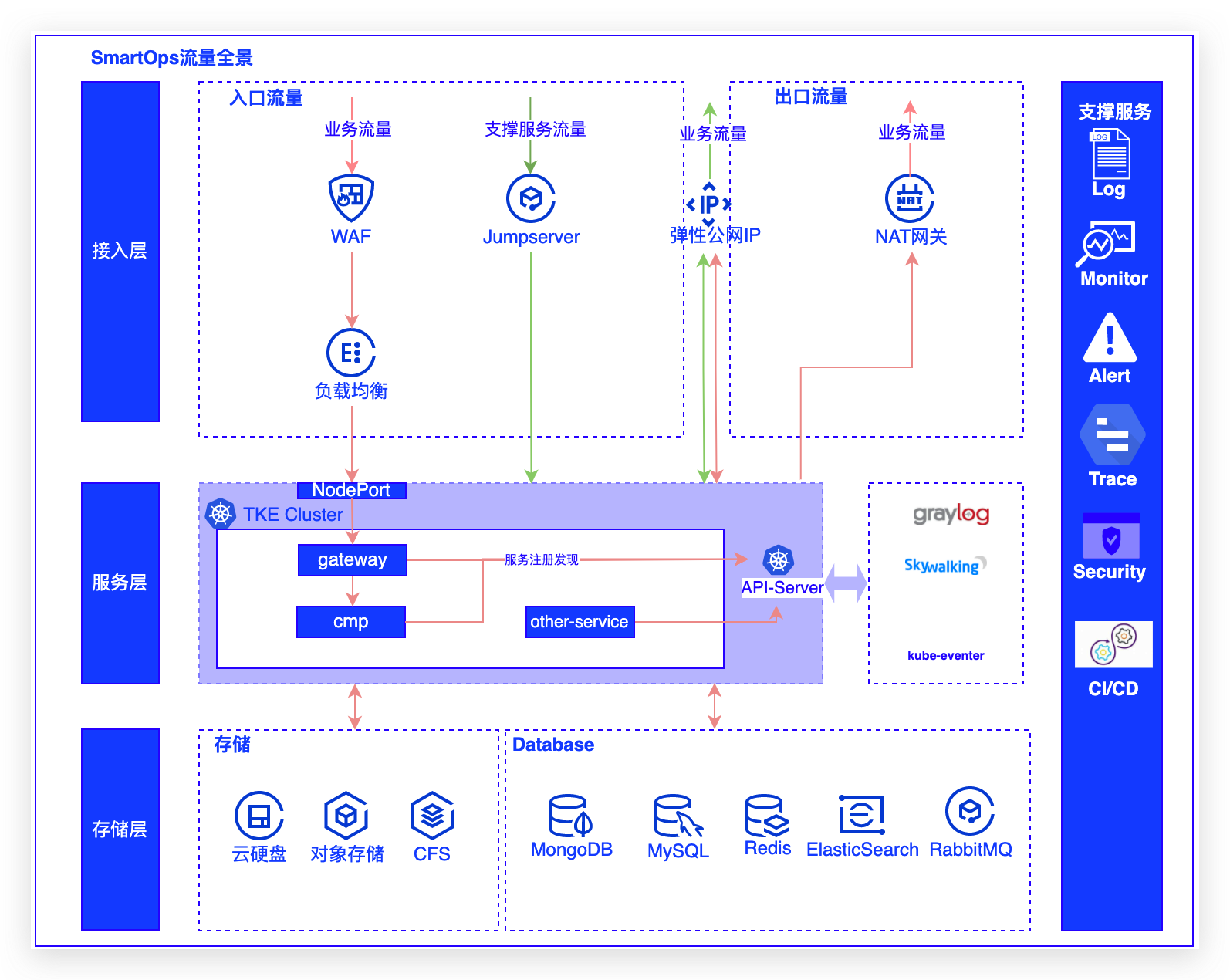

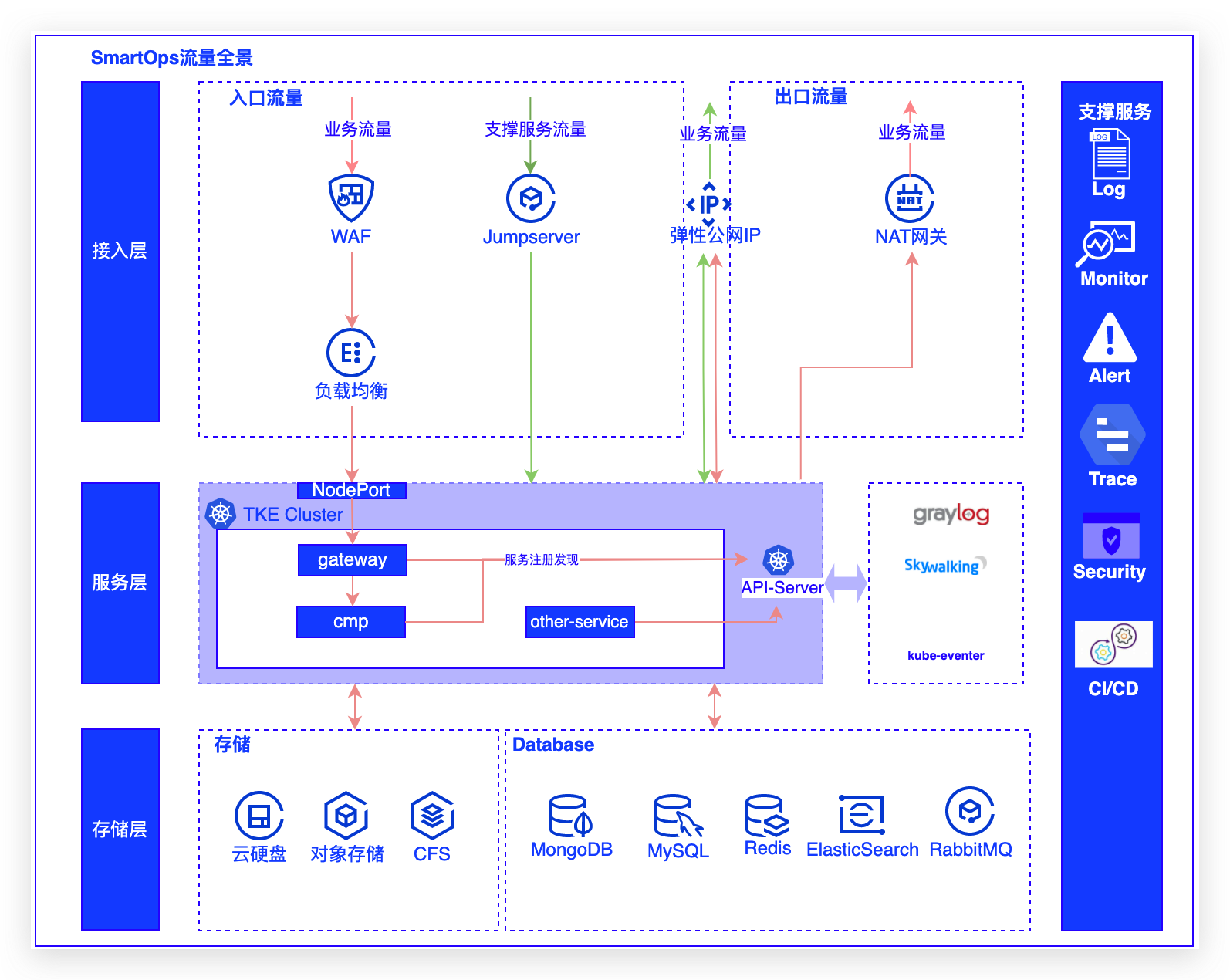

数据库有MongoDB分片集群/MySQL/Redis/ElasticSearch/RabbitMQ进行各类业务数据计算和存储## 三 流量管控### 3.1 南北流量业务流量:业务流量入口最外层经过WAF进行安全防护,之后进入到腾讯云公网负载均衡,负载均衡后管理到TKE集群的NodePort实现流量接入;出口通过NAT网关实现流量分发。其他服务:其他支撑服务,如堡垒机...

火山引擎上云迁移指南(一):上云迁移背景与流程

依据应用分析和风险评估输出结果,拆分业务的服务组件,匹配火山引擎云产品,根据不同业务的需求,制定如下迁移策略。 | 类别 | 说明 | | --- | --- | | 无数据迁移诉求的服务 | - 针对云上网络架构:规划配置VPC,I... MongoDB | 文档数据库MongoDB版 | 火山引擎DTS || ^^ | HBase | 表格数据库HBase版 | 火山引擎DTS |#### 功能和性能验证基于云迁移调研评估步骤中梳理的业务涉及产品功能和性能,结合迁移方案设计,验证产品功...

第一现场|字节跳动开源BitSail:重构数据集成引擎,走向云原生化、实时化

MongoDB 等;消息队列,例如 Kafka、RocketMQ 等;以及大数据生态系统的各种组件,例如 HDFS、Hive 和 ClickHouse 等。整个引擎支持三类同步模式——批式集成、流式集成和增量集成,能够覆盖离线、实... 弹性伸缩等创新特性上做更多研发和输出,未来也期待能够收获更多讨论和建议。活动推荐 **11 月 9 日 19:30,**字节跳动数据平台举办 BitSail 首期直播活动,邀请数据集成领域专家,深入解读字节跳...

【年度总结 | 2023】稳步前进吧,少年

主要输出都是个人的笔记,一些个人项目,在后期我初步打算是核心内容是关于人工智能方向的用户发表高质量的文章,此外还有打造个人品牌,在我上文所提的个人网站flag就是一个很好典型例子,看着站长们炫酷的网站,以及个... 安静,没有其他的事情打扰,但在大学就不一样了,各型各色的诱惑以及各种杂七杂八的事情,还有一些突然其来的事情,让我开始思考的学习的本质,也学了很多方法论,其中对我最受用的方法论有三个,第一个是只做一件事方法...

特惠活动

特惠活动

mongodb安静输出-优选内容

mongodb安静输出-优选内容

mongodb安静输出-相关内容

mongodb安静输出-相关内容

2022技术盘点之平台云原生架构演进之道|社区征文

数据库有MongoDB分片集群/MySQL/Redis/ElasticSearch/RabbitMQ进行各类业务数据计算和存储## 三 流量管控### 3.1 南北流量业务流量:业务流量入口最外层经过WAF进行安全防护,之后进入到腾讯云公网负载均衡,负载均衡后管理到TKE集群的NodePort实现流量接入;出口通过NAT网关实现流量分发。其他服务:其他支撑服务,如堡垒机...

实时任务

输出为实时更新的数据。实时任务支持输入的数据源为:Kafka、Pulsar; 离线任务,指的是任务跟随离线更新的数据源可被设置为手动和周期执行,输出为定期更新的数据或模型文件。离线任务支持输入的数据源为:Hive, MySQL, ClickHouse, Kafka, HttpAPI, 飞书, CSV/Excel, Oracle, Impala, PostgreSQL, Hbase, SQLServer, MaxCompute, ADB, MongoDB, Hana, Teradata, Db2, Vertica, GreenPlum等20余种主流的数据源; 本文将结合产品实...

任务创建

将处理完成的数据输出到目标源中。 任务类型:实时任务、离线任务;实时任务支持 Kafka、Pulsar,离线任务支持的输入数据源如下;实时任务默认不开启; 已支持的离线任务的输入数据源:Hive, MySQL, ClickHouse, Kafka, HttpAPI, 飞书, CSV/Excel, Oracle, Impala, PostgreSQL, Hbase, SQLServer, MaxCompute, ADB, MongoDB, Hana, Teradata, Db2, Vertica, GreenPlum等20几种主流的数据源 已支持数据清洗节点:字段设置、筛选行、添加...

离线任务

输出为实时更新的数据。实时任务支持输入的数据源为:Kafk、Pulsar; 离线任务,指的是任务跟随离线更新的数据源可被设置为手动和周期执行,输出为定期更新的数据或模型文件。离线任务支持输入的数据源为:Hive, MySQL, ClickHouse, Kafka, HttpAPI, 飞书, CSV/Excel, Oracle, Impala, PostgreSQL, Hbase, SQLServer, MaxCompute, ADB, MongoDB, Hana, Teradata, Db2, Vertica, GreenPlum等20余种主流的数据源; 本文将结合产品实操...

V2.64.0

MongoDB 数据库配置优化 在新版本中,MongoDB 数据库新建连接时,支持用户配置认证库和多节点,增强了连接设置的灵活性和对复杂部署环境的支持。操作路径:数据准备-数据连接-选择”MongoDB“ 2.1.2 数据集新功能 【... 外部输出支持 Hive 新版本中,通过外部输出算子,支持将数据输出至 Hive 的外部存储系统。操作路径:数据准备-可视化建模-新建任务-外部输出 【优化】详情页预览优化 在新版本中,可视化建模详情页的数据预览得到了显...

功能发布记录(2023年)

整库实时解决方案新增支持 MongoDB 数据源读取。 实时分库分表解决方案 ByteHouse CDW 任务配置 实时整库同步解决方案 2023/09/27序号 功能 功能描述 使用文档 1 数据开发 数据开发界面支持任务批量删除... 工作台 治理全景 规划诊断 SLA 保障 资源优化 复盘管理 2023/07/03序号 功能 功能描述 使用文档 1 数据开发 EMR Spark 任务类型支持 python 语言方式输出。 Shell\Python 任务支持使用独享资源组私有镜像...

火山引擎上云迁移指南(一):上云迁移背景与流程

依据应用分析和风险评估输出结果,拆分业务的服务组件,匹配火山引擎云产品,根据不同业务的需求,制定如下迁移策略。 | 类别 | 说明 | | --- | --- | | 无数据迁移诉求的服务 | - 针对云上网络架构:规划配置VPC,I... MongoDB | 文档数据库MongoDB版 | 火山引擎DTS || ^^ | HBase | 表格数据库HBase版 | 火山引擎DTS |#### 功能和性能验证基于云迁移调研评估步骤中梳理的业务涉及产品功能和性能,结合迁移方案设计,验证产品功...

第一现场|字节跳动开源BitSail:重构数据集成引擎,走向云原生化、实时化

MongoDB 等;消息队列,例如 Kafka、RocketMQ 等;以及大数据生态系统的各种组件,例如 HDFS、Hive 和 ClickHouse 等。整个引擎支持三类同步模式——批式集成、流式集成和增量集成,能够覆盖离线、实... 弹性伸缩等创新特性上做更多研发和输出,未来也期待能够收获更多讨论和建议。活动推荐 **11 月 9 日 19:30,**字节跳动数据平台举办 BitSail 首期直播活动,邀请数据集成领域专家,深入解读字节跳...

【案例】汽车用户关键行为统计

MongoDb, Hana, teradata, Db2, Vertica, GreenPlum等20几种主流的数据源接入的能力,�支持数据的采样/全量/筛选/部分列读取 2.数据处理数据准备模块包含了多种数据处理的算子 处理方式 解释说明 字段设置... 作为指标对接到CDP或者输出hive/clickhouse,便于后续处理 1.数据描述线上行为数据表(用户唯一标志id和设备id): 字段名称 字段类型 字段意义 字段说明 p_date string 分区字段,日期 数据埋点根据日期分区,按天存...