MySQL重新组织时会丢失分区信息。

社区干货

社区干货

MySQL 统计信息相关参数解析

统计信息将全部丢失。设置非持久化统计信息有两种方式:1. 设置全局变量 `INNODB_STATS_PERSISTENT=OFF`2. 使用 create/alter table 属性 `STATS_PERSISTENT=0`,例如:```sqlmysql> alter table test0407 ST... 或者是查询 information schema 下统计信息相关的表时会自动进行收集5. 启用--auto-rehash(默认)功能情况下,使用mysql client登录### 非持久化统计信息相关参数1. `innodb_stats_on_metadata`:当统计信息配置...

字节跳动 Flink 单点恢复功能及 Regional CheckPoint 优化实践

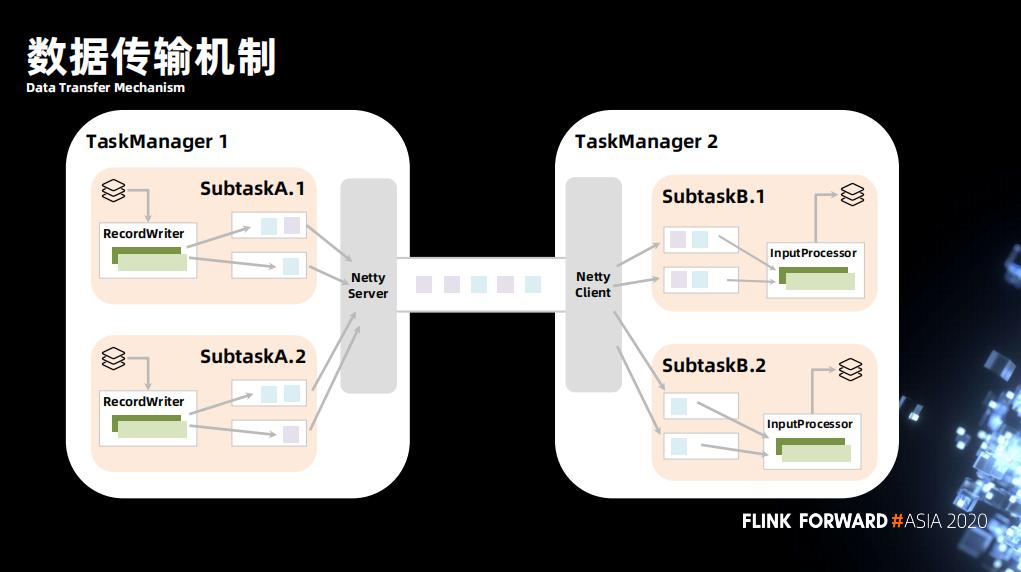

当数据流入时会先被 RecordWriter 接收2. RecordWriter 根据数据的信息,例如 key,将数据进行 Shuffle 选择对应的 Channel3. 将数据装载到 Buffer 中,并放到 Channel 对应的 Buffer 队列里4. 通过 Netty Server 向下游发送5. 下游 Netty Client 接收数据6. 根据 Buffer 中的分区信息,转发发到下游对应的 Channel 中7. 由 InputProcessor 将数据从 Buffer 中取出,执行 Operator 逻辑 **根据上面提出的...

分布式数据库TiDB的设计和架构

平台化方面有较资深的落地经验。# 导语市场上有很多数据库产品,如Oracle、MySQL、SQLServer、NoSQL、NewSQL等,那么目前数据库圈最火的分布式关系型数据库之一TiDB你了解吗?相信很多同学以前听说过TiDB,也知道是一款国人研发的数据库,但你知道TiDB到底是如何实现的?它跟其他数据库产品相比,它的核心优势是什么?此次夜校分享,xiaoyu向大家介绍了数据库发展史、TiDB 设计、架构及生态及TiDB在得物的应用。# 数据库技术发展演...

字节跳动 Flink 单点恢复功能及 Regional CheckPoint 优化实践

允许短时间内小部分数据丢失 - 对数据输出的持续性要求高![]()在讲述技术方案之前,有必要先来了解 Flink 现有的数据传输机制。从左往右看(SubTaskA):1. 当数据流入时会先被 RecordWriter 接收 2. RecordWriter 根据数据的信息,例如 key,将数据进行 Shuffle 选择对应的 Channel 3. 将...

特惠活动

特惠活动

MySQL重新组织时会丢失分区信息。

-优选内容

MySQL重新组织时会丢失分区信息。

-优选内容

MySQL重新组织时会丢失分区信息。

-相关内容

MySQL重新组织时会丢失分区信息。

-相关内容

通过MaterializedMySQL导入

可以重新查看Binlog日志情况。 SQL [root@node1 ~] service mysqld restart[root@node1 ~] mysql -u root -passwordmysql> show variables like 'log_%';注意 MaterializeMySQL表引擎用户必须具备MySQL库的以下权限... MySQL不可用时的重试间隔(毫秒)。 负值禁用重试。 默认值:1000 allows_query_when_mysql_lost Bool true 允许在 MySQL 丢失时查询物化表。 默认值:0(false) skip_error_count Int64 0 跳过MaterializedMyS...

同步至火山引擎版 veDB MySQL

前提条件已在公网环境中自行搭建 MySQL,并创建数据库账号。 已创建云数据库 veDB MySQL 版实例和数据库。详细信息,请参见创建 veDB MySQL 实例和创建数据库。 源端的数据库实例的接入方式选择的是公网自建时,且... 可能引起目标库数据丢失。 限制说明应用限制类型 说明 源库限制 数据库版本:当前支持 5.6、5.7 和 8.0 的 MySQL 实例。 在源库的实例版本大于等于 5.6 时,需设置参数 gtid_mode 为 ON。 说明 当 MySQL 的版本小...

同步至专有网络 MySQL

本文介绍如何在数据库传输服务 DTS 控制台创建专有网络 MySQL 同步至专有网络 MySQL 任务。 前提条件按需设置源端和目标端信息,具体如下所示: 在使用 VPN 实现数据迁移时,自建数据库所属的本地网络已通过 VPN 网关... 可能引起目标库数据丢失。 限制说明应用限制类型 说明 源端限制 数据库版本:当前支持 5.6、5.7 和 8.0 的 MySQL 实例。 在源库的实例版本大于等于 5.6 时,需设置参数 gtid_mode 为 ON。 说明 当 MySQL 的版本小...

创建火山引擎 ECS 自建 MySQL 数据订阅任务

MySQL(例如源库是第三方云服务的实例)时,您需要保留至少 24 小时的日志(例如 Binlog 日志),建议保留 7 天以上的日志信息,否则 DTS 可能因无法获取日志从而导致任务失败,某些情况下也可能会导致数据丢失。 消费端限制 当消息订阅到 Kafka 时,具有以下限制条件:成功创建订阅任务后,不支持修改 Kafka Partition 的接收策略。 如果消费端为火山引擎 ECS 自建 Kafka 或消息队列 Kafka 版时,创建订阅任务后,请勿修改分区 Partition ...

迁移至火山引擎版 MySQL

本场景介绍如何在数据库传输服务 DTS 控制台创建火山引擎版 MySQL 迁移至火山引擎版 MySQL 任务。 前提条件已创建云数据库 MySQL 版实例和数据库。详细信息,请参见创建 RDS MySQL 实例和创建数据库。 创建数据迁移... 某些情况下也可能导致数据丢失。 涉及外键依赖的表,需要同时迁移,否则将导致数据迁移失败。 单任务中表的数量建议不超过 2 万,库的数量不超过 1000 个。当有大量库表需要迁移时,建议拆分为多个任务。 目标库限...

迁移至火山引擎版 veDB MySQL

前提条件已在公网环境中自行搭建 MySQL,并创建数据库账号。 已创建云数据库 veDB MySQL 版实例和数据库。详细信息,请参见创建 veDB MySQL 实例和创建数据库。 源端的数据库实例的接入方式选择的是公网自建时,且... 某些情况下也可能导致数据丢失。 涉及外键依赖的表,需要同时迁移,否则将导致数据迁移失败。 单任务中表的数量建议不超过 2 万,库的数量不超过 1000 个。当有大量库表需要迁移时,建议拆分为多个任务。 目标库限...

创建火山引擎版 MySQL数据订阅任务

MySQL(例如源库是第三方云服务的实例)时,您至少需要保留 24 小时的日志(例如 Binlog 日志),建议保留 7 天以上的日志信息,否则 DTS 可能因无法获取日志从而导致任务失败,某些情况下也可能会导致数据丢失。 消费端限制 当消息订阅到 Kafka 时,具有以下限制条件:成功创建订阅任务后,不支持修改 Kafka Partition 的接收策略。 如果消费端为火山引擎 ECS 自建 Kafka 或消息队列 Kafka 版时,创建订阅任务后,请勿修改分区 Partition...

迁移至火山引擎版 MySQL

本场景介绍如何在数据库传输服务 DTS 控制台创建公网自建 MySQL 迁移至火山引擎版 MySQL 任务。 前提条件已在公网环境中自行搭建 MySQL,并创建数据库账号。 已创建云数据库 MySQL 版实例和数据库。详细信息,请参见... 某些情况下也可能导致数据丢失。 涉及外键依赖的表,需要同时迁移,否则将导致数据迁移失败。 单任务中表的数量建议不超过 2 万,库的数量不超过 1000 个。当有大量库表需要迁移时,建议拆分为多个任务。 目标库限...

同步至公网自建 MySQL

请参见预检查项(MySQL)。 注意事项当源库为自建 MySQL 时,您需要关注以下信息: 同步时,如果源库进行主备切换,否则会导致同步任务失败。 在同步期间,如果源库执行了重启操作,同步任务会暂时中断并自动尝试修复,如... 可能引起目标库数据丢失。 限制说明应用限制类型 说明 源库限制 数据库版本:当前支持 5.6、5.7 和 8.0 的 MySQL 实例。 在源库的实例版本大于等于 5.6 时,需设置参数 gtid_mode 为 ON。 说明 当 MySQL 的版本小...