Hadoop中的Path.getFileSystem和FileSystem.get方法区别是什么?

社区干货

社区干货

9年演进史:字节跳动 10EB 级大数据存储实战

# 背景## **HDFS** **简介**HDFS 全名 Hadoop Distributed File System,是业界使用最广泛的开源分布式文件系统。原理和架构与 Google 的 GFS 基本一致。它的特点主要有以下几项:- 和本地文件系统一样的目录... ### **接入层**接入层是字节版 HDFS 区别于社区版本最大的一层,社区版本中并无这一层定义。在字节跳动的落地实践中,由于集群的节点过于庞大,我们需要非常多的 NameNode 实现联邦机制来接入不同上层业务的数据服...

字节跳动10万节点HDFS集群多机房架构演进之路

**01****背景****现状**### HDFS 全称是 Hadoop Distributed File System,其本身是 Apache Hadoop 项目的一个模块,作为大数据存储的基石提供高吞吐的海量数据存储... 其作用是跟社区的 JournaNode 是一样的,就是为 Active 和 Standby NameNode 提供一个共享的 EditLog 存储方案,这是实现 NameNode 的 HA 方法的基础。值得一提的是,BookKeeper 本身提供了机房级别的保存配置策略...

字节跳动10万节点 HDFS 集群多机房架构演进之路

# **背景**## **现状**HDFS 全称是 Hadoop Distributed File System,其本身是 Apache Hadoop 项目的一个模块,作为大数据存储的基石提供高吞吐的海量数据存储能力。自从 2006 年 4 月份发布以来,HDFS 目前依然有... **BookKeeper**, 即 Apache BookKeeper,其作用是跟社区的 JournaNode 是一样的,就是为 Active 和 Standby NameNode 提供一个共享的 EditLog 存储方案,这是实现 NameNode 的 HA 方法的基础。值得一提的是,Boo...

万字长文,Spark 架构原理和 RDD 算子详解一网打进! | 社区征文

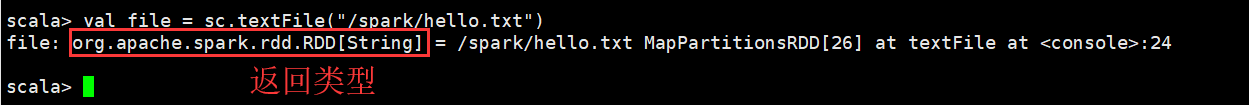

它是能被序列化,也能被反序列化。在开发的时候,RDD给人的感觉就是一个只读的数据。但是不是,RDD存储的不是数据,而是数据的位置,数据的类型,获取数据的方法,分区的方法等等。### 2.3 RDD的五大特性(1)一组分片(P... 还有所有Hadoop支持的数据集,比如HDFS、Cassandra、HBase等```cppscala> val file = sc.textFile("/spark/hello.txt")```### 3.2...

特惠活动

特惠活动

Hadoop中的Path.getFileSystem和FileSystem.get方法区别是什么?

-优选内容

Hadoop中的Path.getFileSystem和FileSystem.get方法区别是什么?

-优选内容

Hadoop中的Path.getFileSystem和FileSystem.get方法区别是什么?

-相关内容

Hadoop中的Path.getFileSystem和FileSystem.get方法区别是什么?

-相关内容

基于Spark的词频统计

执行以下命令完成Spark的下载及安装bash wget https://dlcdn.apache.org/spark/spark-3.2.0/spark-3.2.0-bin-hadoop3.2.tgzsudo tar -zxvf spark-3.2.0-bin-hadoop3.2.tgz -C //解压Spark安装包到根目录下解压完成后出现如图所示回显: 2.进行Spark环境的配置执行sudo vim /etc/profile命令,在文件末尾插入以下内容: bash JAVA_HOME = /usr/lib/jvm/jdk_1.8.0_301 //该路径为个人虚拟机内jdk的路径SPARK_HOME = /usr/local/hadoop...

使用 Hive 访问 CloudFS 中的数据

Hive 是基于 Hadoop 的一个数据仓库工具,用来进行数据提取、转化、加载。本文介绍如何配置 Hive 服务来访问 CloudFS 中的数据。 前提条件在使用 Hive 服务访问大数据文件存储服务 CloudFS 前,确保您已经完成以下准... Hadoop的share/hadoop/hdfs目录下。 配置core-site.xml文件。 xml fs.defaultFS cfs://xxxx.cfs-cn-beijing.ivolces.com fs.cfs.impl com.volcengine.cloudfs.fs.CfsFileSystem fs.AbstractFileSystem.cfs.impl co...

Flink 使用 Proton

.secret-access-key:xxx 可选:当需要通过Filesystem connector读取存储TOS的非Parquet数据的时候才需要fs.tos.impl: io.proton.fs.RawFileSystem如果需要用过 Filesystem connector 读取存储在 TOS 上的 Parquet 类... 需要显示设置HADOOP_CLASSPATH。 bash export HADOOP_CLASSPATH=`$HADOOP_HOME/bin/hadoop classpath`/usr/lib/emr/current/flink/bin/sql-client.sh embeddedset execution.target=yarn-per-job; 创建数据源 sql ...

Hadoop 使用 Proton

下文首先介绍在 火山引擎EMR 和 自建Hadoop集群 两种场景下,如何使用Proton实现存算分离架构。接着介绍存算分离模式下回收站的配置方式,最后介绍如何在开发环境中引入 proton 依赖。 1 火山引擎EMR1.1 认证配置1.1... 中的版本信息,选择您对应的 Proton 版本,下载对应的 Proton 包,放入 HDFS 安装目录下的 share/hadoop/hdfs/ 中。 2.1.2 配置修改 修改 core-site.xml,新增如下内容: javascript fs.AbstractFileSystem.tos.impl io...

读取Hadoop集群中的数据

本文为您介绍如何配置EMR Serverless StarRocks实例,以查询Hadoop高可用集群中的数据。 1 前提条件已创建包含了HDFS服务,并且开启了服务高可用的集群,详情请参见创建集群。 已创建EMR Serverless StarRocks实例,详... 在StarRocks中查询HDFS文件中的数据 sql CREATE DATABASE db_example;USE db_example;CREATE EXTERNAL TABLE t0( name string, id int) ENGINE=filePROPERTIES ( "path"="hdfs://emr-cluster/warehouse/...

使用说明

Hadoop 项目的一部分,运行在 HDFS 文件系统之上,为 Hadoop 提供类 BigTable 的服务。HBase关键名词说明: 名词 说明 Namespace 命名空间是表的逻辑分组,类似于关系数据库系统中的数据库。这种抽象为即将到来的多租... 可以看到名为 .hbase-snapshot 的快照文件 hadoop fs -ls /apps/hbase/dataSLF4J: Class path contains multiple SLF4J bindings.SLF4J: Found binding in [jar:file:/opt/emr/2.0.0/hadoop-2.10.2/share/hadoop/c...

Android(v4.1.0.0及以上)

项目中加入SDK 打开压缩包 byted_effect_andr.zip,找到 effect-SDKXXX.aar 文件 拷贝其到项目中的主模块(一般是 app)的 libs 目录下,如拷贝到 app/libs/ 目录(没有 libs 文件夹,可手动创建) 打开主模块(一般是 app... getTimestamp();否则使用系统方法: java long timeStamp System.currentTimeMillis();附录:ImageSource 类型 三种不同的类型主要在与对于输入纹理的处理和绘制上的区别,具体看下面。 类型 区别 输出纹理 TYPE_CAME...

快速开始

本文向您介绍如何通过火山引擎 E-MapReduce(EMR)控制台,快速使用 Airflow 组件进行工作流调度。 步骤一: 服务引入注意 在 EMR 集群创建中,Airflow 服务能力存在于以下三种类型的集群中:Hadoop、Presto、Trino。 若... These args will get passed on to each operator You can override them on a per-task basis during operator initialization default_args={ 'depends_on_past': False, 'email': ['...

DevOps基于k8s发布系统CI/CD的实现|社区征文

list = null; try { list = gitLabApi.getRepositoryApi().getBranches(param.getProjectIdOrPath(), param.getBranchName()); } catch (GitLabApiException e) { LogUtils.throwException(logger, e, Messa... String pomPath = "D:/hello/pom.xml";MavenCli cli = new MavenCli();try { cli.doMain(commands, pomPath, System.out, System.out);} catch (Exception e) { e.printStackTrace();}```但是,一般情况下...