a-frame中组件中的相机位置值不会改变

社区干货

社区干货

MAD,现代安卓开发技术:Android 领域开发方式的重大变革|社区征文

有的时候在没有其他 App 代码的情况下通过 Memory Profilers 还可以查看其内部的实例和变量细节。* CPU:性能剖析器检查 CPU 活动,切换到 Frames 视图还可以**界面卡顿追踪*** Memory:识别可能会导致应用卡顿、冻结甚至崩溃的内存泄漏和内存抖动,可以捕获堆转储、强制执行垃圾回收以及跟踪内存分配以定位**内存方面的问题*** Battery:会监控 CPU、网络无线装置和 GPS 传感器的使用情况,并直观地显示其中每个组件消耗的电...

Go 生态下的字节跳动大规模微服务性能优化实践

业务高速发展变化和不同团队灵活协作的需求。时至今日,字节跳动的在线微服务类型数量已超过 10 万。但作为一家快速发展的企业,字节特殊的内部业务场景也对微服务落地提出了一些挑战,如:* **大规模**:一是... 我们需要对具体的组件进行修改。我们的思路是为性能平台用户提供自顶向下的逐步钻探的分析流程。我们在单机收集数据,包括 CPU 利用率、代码的 Stack 、Frame 等信息,然后将它们打散,在不同的维度形成不同的组...

借助 MAD 助力你的 Android 应用开发|社区征文

Android 自 08 年诞生之后的多年间 SDK 变化一直不大,开发方式较为固定。13 年起技术更新逐渐加速,特别是 17年之后, 随着 Kotlin 及 Jetpack 等新技术的出现 Android 开发方式发生了很大变化,去年推出的 Jetpack C... Kotlin 的安全性还体现在数据不会被随意修改。我们在代码中大量使用 `data class` 并且要求属性使用 `val` 而非 `var` 定义,这有利于单向数据流范式在项目中的推广,在架构层面实现数据的读写分离。```kotlindat...

干货 | 在字节跳动,一个更好的企业级SparkSQL Server这么做

Spark 组件由于其较好的容错与故障恢复机制,在企业的长时作业中使用的非常广泛,而SparkSQL又是使用Spark组件中最为常用的一种方式。 相比直接使用编程式的方式操作Spark的RDD或者DataFrame的API,SparkSQL可直接... 2. 兼容Hive协议,如果要支持JDBC接口,那么就需要提供一个SparkSQL的JDBC Driver,而目前大数据领域Hive Server2提供的Hive-JDBC-Driver已经被广泛使用,从迁移成本来说最好的方式就是保持Hive的使用方式不变,只需要...

特惠活动

特惠活动

a-frame中组件中的相机位置值不会改变

-优选内容

a-frame中组件中的相机位置值不会改变

-优选内容

a-frame中组件中的相机位置值不会改变

-相关内容

a-frame中组件中的相机位置值不会改变

-相关内容

干货 | 在字节跳动,一个更好的企业级SparkSQL Server这么做

Spark 组件由于其较好的容错与故障恢复机制,在企业的长时作业中使用的非常广泛,而SparkSQL又是使用Spark组件中最为常用的一种方式。 相比直接使用编程式的方式操作Spark的RDD或者DataFrame的API,SparkSQL可直接... 2. 兼容Hive协议,如果要支持JDBC接口,那么就需要提供一个SparkSQL的JDBC Driver,而目前大数据领域Hive Server2提供的Hive-JDBC-Driver已经被广泛使用,从迁移成本来说最好的方式就是保持Hive的使用方式不变,只需要...

在字节跳动,一个更好的企业级 SparkSQL Server 这么做

Spark 组件由于其较好的容错与故障恢复机制,在企业的长时作业中使用的非常广泛,而SparkSQL又是使用Spark组件中最为常用的一种方式。相比直接使用编程式的方式操作Spark的RDD或者DataFrame的API,SparkSQL可直接输... 那么需要提供SparkSQL的JDBC Driver。目前,大数据领域Hive Server2提供的Hive-JDBC-Driver已经被广泛使用,从迁移成本来说最好的方式就是保持Hive的使用方式不变,只需要换个端口就行,也就是可以通过Hive的JDBC Driv...

客户端 SDK

amStats 类型说明中新增"获取当前编码格式"相关接口(getVideoCodecType),支持获取当前编码格式。详细信息,请参考 StreamStats 类型说明。 在 Start() 接口的 config 字段中新增 accountId 用于动态修改用户的火山... (setCreateLocalLog)接口。 2023 年 7 月云手机客户端 SDK V1.26.0 的发布说明如下: AndroidAndroid 端 SDK 包含以下新增功能和变更: 申请云手机服务时,新增通过 renderView 参数指定视频流的渲染控件。详细信息,...

火山引擎 DataLeap 下 Notebook 系列文章二:技术路线解析

> 更多技术交流、求职机会,欢迎关注**字节跳动数据平台微信公众号,回复【1】进入官方交流群** 在 Jupyter 的生态下,除了 Notebook 本身,火山引擎 DataLeap 研发团队还注意到了很多其他组件。彼时,JupyterLab... 团队还针对性地改进了 JupyterLab 的 UI。 另外火山引擎 DataLeap 研发团队还开发了定制的可视化 SDK,使得用户在 Notebook 上计算得到的 Pandas Dataframe 可以接入火山引擎 DataLeap 数据研发已经提供的数据...

一文了解 DataLeap 中的 Notebook

Kernel 是 Notebook 中的代码实际的运行环境,它是一个独立的进程。每一次「运行」动作,产生的效果是单个 Cell 的代码被运行。具体来讲,「运行」就是把 Cell 内的代码片段,通过 Jupyter Notebook 后端以特定格式... 同时还接入了 DataLeap 提供的 Python & SQL 代码智能补全功能。额外地,我们还开发了定制的可视化 SDK,使得用户在 Notebook 上计算得到的 Pandas Dataframe 可以接入 DataLeap 数据研发已经提供的数据结果分析模...

干货 | 在字节跳动,一个更好的企业级SparkSQL Server这么做

Spark 组件由于其较好的容错与故障恢复机制,在企业的长时作业中使用的非常广泛,而SparkSQL又是使用Spark组件中最为常用的一种方式。 相比直接使用编程式的方式操作Spark的RDD或者DataFrame的API,SparkSQL可直... 那么需要提供SparkSQL的JDBC Driver。目前,大数据领域Hive Server2提供的Hive-JDBC-Driver已经被广泛使用,从迁移成本来说最好的方式就是保持Hive的使用方式不变,只需要换个端口就行,也就是可以通过Hive的JDBC Driv...

关于 DataLeap 中的 Notebook你想知道的都在这

安全等全套数据中台建设,降低工作成本和数据维护成本、挖掘数据价值、为企业决策提供数据支撑。本文主要详细讲述DataLeap 中的 Notebook ,包括前期选型、技术路线、架构升级、调度方案、以及未来工作等五部分重点... 同时还接入了 DataLeap 提供的 Python & SQL 代码智能补全功能。额外地,我们还开发了定制的可视化 SDK,使得用户在 Notebook 上计算得到的 Pandas Dataframe 可以接入 DataLeap 数据研发已经提供的数据结果分析模...

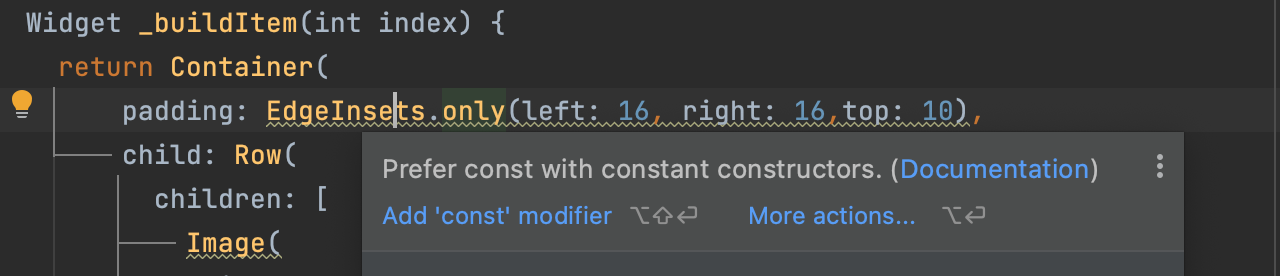

Const在Flutter性能方面的表现|社区征文

在实际的Flutter开发中,可以发现编辑器AS会提示在组件之前加上const关键字,这是因为... 这就是为什么在开发中,要尽量在小的范围去使用setState,避免不必要的重建任务。为了优化这个问题,官方就更新出了const关键字,被const修饰的widget,就代表永远不会被重建。比如在上述代码中Image是不可变的,Text是...

一文了解 DataLeap 中的 Notebook

Kernel 是 Notebook 中的代码实际的运行环境,它是一个独立的进程。每一次「运行」动作,产生的效果是单个 Cell 的代码被运行。具体来讲,「运行」就是把 Cell 内的代码片段,通过 Jupyter Notebook 后端以特定格式... 同时还接入了 DataLeap 提供的 Python & SQL 代码智能补全功能。额外地,我们还开发了定制的可视化 SDK,使得用户在 Notebook 上计算得到的 Pandas Dataframe 可以接入 DataLeap 数据研发已经提供的数据结果分析模...