Hadoop:java.lang.ClassNotFoundException:map-reduce

社区干货

社区干货

字节跳动 MapReduce - Spark 平滑迁移实践

我们首先统计了 MapReduce 类型作业的业务方和任务维护方式。左边的饼图是业务方的占比统计,占比最大的是 Hadoop Streaming 作业,差不多占到了所有作业的 45%,占比第二名的是 Druid 作业 24%,第三是 Distcopy... Distcp 以及普通用户使用 Java 编写的作业。其中 Hadoop Streaming 使用 MapReduce 的旧 API,而 Distcp 在使用的新 API,这就相当于我们的升级方案需要支持所有的 MapReduce 作业。 **方案拆解**对...

字节跳动 MapReduce - Spark 平滑迁移实践

我们首先统计了 MapReduce 类型作业的业务方和任务维护方式。左边的饼图是业务方的占比统计,占比最大的是 Hadoop Streaming 作业,差不多占到了所有作业的 45%,占比第二名的是 Druid 作业 24%,第三是 Distcopy... Distcp 以及普通用户使用 Java 编写的作业。其中 Hadoop Streaming 使用 MapReduce 的旧 API,而 Distcp 在使用的新 API,这就相当于我们的升级方案需要支持所有的 MapReduce 作业。 **方案拆解**对...

干货 | 看 SparkSQL 如何支撑企业级数仓

以及任务以 MapReduce 分布式任务运行在 YARN 上。标准的 JDBC 接口,标准的 SQL 服务器,分布式任务执行,以及元数据中心,这一系列组合让 Hive 完整的具备了构建一个企业级数据仓库的所有特性,并且 Hive 的 SQL 服... MapReduce 和 HBase,形成了早期 Hadoop 的三大利器。然而这三大利器更聚焦在异构数据的信息提取处理上,没有提供对结构化数据很友好的类似 SQL 语法的分析入口,同时在编程态的支撑也不够友好,只有 Map 和 Reduce ...

万字长文,Spark 架构原理和 RDD 算子详解一网打进! | 社区征文

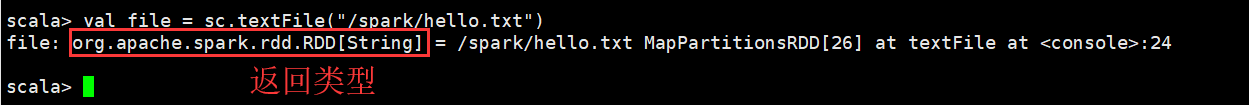

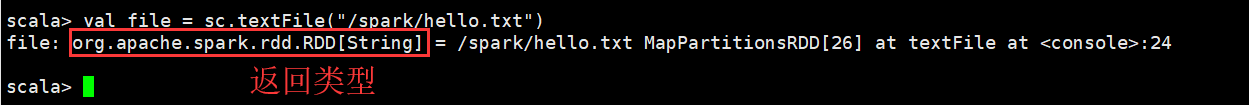

25scala> val rdd = sc.textFile("hdfs://192.168.56.137:9000/wc/e.txt")rdd: org.apache.spark.rdd.RDD[String] = hdfs://192.168.56.137:9000/wc/e.txt MapPartitionsRDD[21] at textFile at :24```3. 通... 还有所有Hadoop支持的数据集,比如HDFS、Cassandra、HBase等```cppscala> val file = sc.textFile("/spark/hello.txt")```### 3.2...

特惠活动

特惠活动

Hadoop:java.lang.ClassNotFoundException:map-reduce

-优选内容

Hadoop:java.lang.ClassNotFoundException:map-reduce

-优选内容

Hadoop:java.lang.ClassNotFoundException:map-reduce

-相关内容

Hadoop:java.lang.ClassNotFoundException:map-reduce

-相关内容

使用说明

1 概述MapReduce 是用于并行处理大数据集的软件框架。用于大规模数据集(大于1TB)的并行运算。概念“Map(映射)”和“Reduce(归纳)”,及他们的主要思想,都是从函数式编程语言借鉴的,还有从矢量编程语言借来的特性。更... 执行以下 hadoop jar 提交命令: javascript /usr/lib/emr/current/hadoop/bin/hadoop jar /usr/lib/emr/current/hadoop/share/hadoop/mapreduce/hadoop-mapreduce-examples-3.3.4.jar pi 16 100000//提交 jar 包,参...

基础使用

本文将为您介绍Spark支持弹性分布式数据集(RDD)、Spark SQL、PySpark和数据库表的基础操作示例。 1 使用前提已创建E-MapReduce(简称“EMR”)集群,详见:创建集群。 2 RDD基础操作Spark围绕着 RDD 的概念展开,RDD是可以并行操作的元素的容错集合。Spark支持通过集合来创建RDD和通过外部数据集构建RDD两种方式来创建RDD。例如,共享文件系统、HDFS、HBase或任何提供Hadoop InputFormat的数据集。 2.1 创建RDD示例:通过集合来创建RDD ...

干货 | 看 SparkSQL 如何支撑企业级数仓

以及任务以 MapReduce 分布式任务运行在 YARN 上。标准的 JDBC 接口,标准的 SQL 服务器,分布式任务执行,以及元数据中心,这一系列组合让 Hive 完整的具备了构建一个企业级数据仓库的所有特性,并且 Hive 的 SQL 服... MapReduce 和 HBase,形成了早期 Hadoop 的三大利器。然而这三大利器更聚焦在异构数据的信息提取处理上,没有提供对结构化数据很友好的类似 SQL 语法的分析入口,同时在编程态的支撑也不够友好,只有 Map 和 Reduce ...

万字长文,Spark 架构原理和 RDD 算子详解一网打进! | 社区征文

25scala> val rdd = sc.textFile("hdfs://192.168.56.137:9000/wc/e.txt")rdd: org.apache.spark.rdd.RDD[String] = hdfs://192.168.56.137:9000/wc/e.txt MapPartitionsRDD[21] at textFile at :24```3. 通... 还有所有Hadoop支持的数据集,比如HDFS、Cassandra、HBase等```cppscala> val file = sc.textFile("/spark/hello.txt")```### 3.2...

观点|SparkSQL在企业级数仓建设的优势

以及任务以MapReduce分布式任务运行在YARN上。标准的JDBC接口,标准的SQL服务器,分布式任务执行,以及元数据中心,这一系列组合让Hive完整的具备了构建一个企业级数据仓库的所有特性,并且Hive的SQL服务器是目前... MapReduce和HBase,形成了早期Hadoop的三大利器。然而这三大利器更聚焦在异构数据的信息提取处理上,没有提供对结构化数据很友好的类似SQL语法的分析入口,同时在编程态的支撑也不够友好,只有Map和Reduce两阶段,...

Distcp拷贝数据到TOS

1 安装Proton SDK组件参考:Proton 无缓存模式 2 使用DistCp命令进行数据迁移2.1 迁移命令shell 构造 DistCp命令将HDFS数据拷贝到TOS>hadoop distcp \ -Dmapreduce.job.queuename=default \ -Dmapreduce.job.name... Java java.io.IOException: Too many chunks created with splitRatio:2, numMaps:250. Reduce numMaps or decrease split-ratio to proceed. at org.apache.hadoop.tools.mapred.lib.DynamicInputFormat.v...

字节跳动 Spark Shuffle 大规模云原生化演进实践

这里就是把 Map 的数据重新组合到所有的 Reducers 上。如果有 M 个 Mappers 和 R 个 Reducers,就会把 M Mappers 的 Partition 数据分区成后面 R Reducers 的 Partition。 Shuffle 的过程可以分为两个阶段— Shuffl... 迁移时也提供了 Hadoop 上云的迁移方案——Yodel(Yarn on Gödel),是一个完全兼容 Hadoop Yarn 的协议,目标是将所有大数据应用平滑地迁移到 Kubernetes 体系上。在这套迁移工作中,ESS 也做了定制化的相关工作,完...

三分钟了解大数据技术发展史|社区征文

大数据分布式计算框架 MapReduce 和 NoSQL 数据库 BigTable,这三篇论文影响了当今大数据生态,可以称得上大数据的基石,Doug cutting 大佬在基于谷歌的三篇论文开发出了 hadoop hdfs 分布式文件存储、MapReduce 计算框架,实际上从 hadoop 开源代码中窥见大数据并没有多么高深的技术难点,大部分实现都是基础的 java 编程,但是对业界的影响是非常深远的。那个时候大多数公司还是聚焦在单机上,如何尽可能提升单机的性能,需求更贵的服务...

狂飙的大模型-2023年度总结|社区征文

(https://zhuyaguang.github.io/promptclass/),[吴恩达-使用ChatGPT API构建系统-笔记](https://zhuyaguang.github.io/wuclass2/),[吴恩达-基于LangChain的大语言模型应用开发](https://zhuyaguang.github.io/wucl... and reduce the chances of receiving irrelevant \ or incorrect responses. Don't confuse writing a \ clear prompt with writing a short prompt. \ In many cases, longer prompts provide more clarity \...