创建数据仓库

社区干货

社区干货

DataLeap数据仓库流程最佳实践

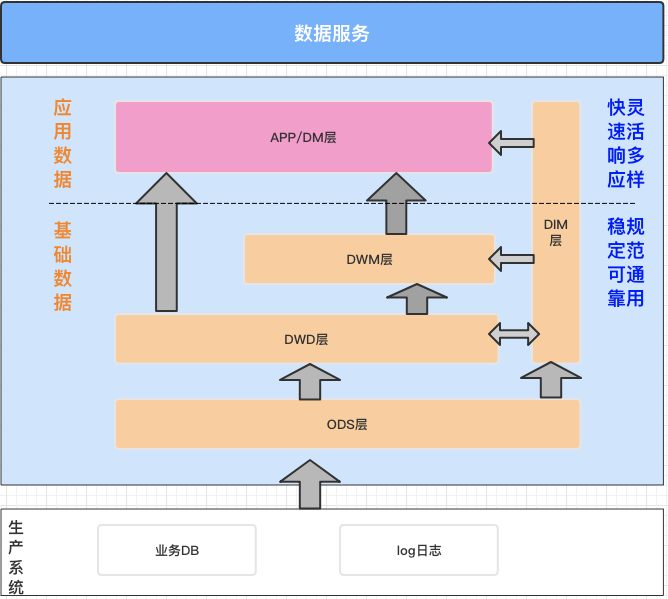

应用数据层。本样例中,我们的数据仓库建设思路是:* ODS(从生产系统采集原始数据,并将原始数据集成冗余宽表)* DWD(对ODS冗余表数据进行轻度过滤处理)* DWM (基于DWD表与业务需求,轻度聚合最近三天的数据)* APP (基于DWD或DWM,输出具体报表信息)在“数据地图”中创建数据仓库中要使用到的表:![图片]...

干货 | 这样做,能快速构建企业级数据湖仓

Codegen 和向量化都是从数据仓库,而不是 Hadoop 体系的产品中衍生出来。Codegen 是 Hyper 提出的技术,而向量化则是 MonetDB 提出的,所以计算引擎的精细化也是沿着数仓开辟的路子在走。Spark 等 Hadoop 体系均走... 让用户能够分钟级地创建和销毁集群,同时提供精细化的集群运维监控告警能力。**Stateless、瞬态集群**,因此数据仓库会存在大量冗余的数据;不分层的话,如果源业务系统的业... 所以对于有明确需求的数据,我们建立针对需求的上卷汇总粒度,对需求不明朗的数据我们建立原子粒度。**3、确认维度** - 维度表是作为业务分析的入口和描述性标识,所以也被称为数据仓库的“灵魂”。在一堆的数据...

基于火山引擎 EMR 构建企业级数据湖仓

都是从数据仓库而不是 Hadoop 体系的产品中长出来的:Codegen 是 Hyper 提出的技术,而向量化则是 MonetDB 提出的,所以计算引擎的精细化也是沿着数仓开辟的路子在走。Spark 等 Hadoop 体系均走了 Codegen 的道路,因为... 让用户能够分钟级地创建和销毁集群,同时提供精细化的集群运维监控告警能力。**Stateless、瞬态集群** 特惠活动

特惠活动

创建数据仓库-优选内容

创建数据仓库-优选内容

创建数据仓库-相关内容

创建数据仓库-相关内容

基于火山引擎 EMR 构建企业级数据湖仓

都是从数据仓库而不是 Hadoop 体系的产品中长出来的:Codegen 是 Hyper 提出的技术,而向量化则是 MonetDB 提出的,所以计算引擎的精细化也是沿着数仓开辟的路子在走。Spark 等 Hadoop 体系均走了 Codegen 的道路,因为... 让用户能够分钟级地创建和销毁集群,同时提供精细化的集群运维监控告警能力。**Stateless、瞬态集群**,还是基于传统 MPP 架构的数据仓库(如Teradata ),抑或是基于传统 Oracle 、MySQL 、MS SQL Server 关系型数据库的数据仓库,其实都面临如下问题:- 怎么组织数... 不能将不同粒度的事实建立在同一张事实表中。### 维度表> **维度表是维度建模的灵魂,通常来说,维度表设计得好坏直接决定了维度建模的好坏**维度表包含了 实表所记录的业务过程度量的上下文和环境,它们除了记...

字节跳动开源其云原生数据仓库 ByConity

项目简介-----ByConity 是字节跳动开源的云原生数据仓库,它采用计算-存储分离的架构,支持多个关键功能特性,如计算存储分离、弹性扩缩容、租户资源隔离和数据读写的强一致性等。通过利用主流的... Worker 会从最底层的 Cloud Storage 读取数据,并通过建立 Pipeline 的方式进行计算。最终多个 Worker 的计算结果通过 Server 汇聚,并返回给客户端。ByConity 还有两个主要的组件,分别是 Time-stamp Oracle 和 D...

火山引擎云原生数据仓库 ByteHouse 技术白皮书 V1.0 (Ⅳ)

> 更多技术交流、求职机会,欢迎关注**字节跳动数据平台微信公众号,回复【1】进入官方交流群**近日,《火山引擎云原生数据仓库 ByteHouse 技术白皮书》正式发布。白皮书简述了 ByteHouse 基于 ClickHouse 引擎的发展历程,首次详细展现 ByteHouse 的整体架构设计及自研核心技术,为云原生数据仓库发展,及企业数字化转型实战运用提供最新的参考和启迪。以下为 ByteHouse 技术白皮书【数据导入导出】版块摘录。技术白皮书(Ⅰ)(Ⅱ...

使用 Hive 访问 CloudFS 中的数据

Hive 是基于 Hadoop 的一个数据仓库工具,用来进行数据提取、转化、加载。本文介绍如何配置 Hive 服务来访问 CloudFS 中的数据。 前提条件在使用 Hive 服务访问大数据文件存储服务 CloudFS 前,确保您已经完成以下准备工作: 开通大数据文件存储服务 CloudFS 并创建文件存储,获取挂载信息。详细操作请参考创建文件存储系统。 开通 E-MapReduce 服务并创建集群。详细操作请参考E-MapReduce 集群创建。 在配置 Hive 服务之前,请确认/u...

元数据迁移

1 迁移和部署 Apache Hive 到火山引擎 EMRApache Hive 是一个开源的数据仓库和分析包,它运行在 Apache Hadoop 集群之上。Hive 元存储库包含对表的描述和构成其基础的基础数据,包括分区名称和数据类型。Hive 是可以... 数据库和 Metastore 服务三种: 内置数据库作为 Hive 元数据建议只应用于开发和测试环境。 使用火山引擎 RDS 作为 Hive 元数据 外置数据库可以是火山引擎的 RDS 数据库或者客户在 ECS 上部署的数据库实例。 创建集...

ByConity 技术详解之 Hive 外表和数据湖

如何接入外部数据存储已经是一个技术选型必须考虑的问题。也出于同样的考虑,ByConity 0.2.0 中发布了一系列对接外部存储的能力,初步实现对 Hive 外表及数据湖格式的接入。# 支持 Hive 外表随着企业数据决策的要求越来越高,Hive 数据仓库已成为了许多组织的首选工具之一。通过在查询场景中结合 Hive, ByConity 可以提供更全面的企业决策支持和打造更完整的数据管理模式。因此从 0.2.0 版本开始,ByConity 可以通过建立外表的形...