Kafka生产者类型错误:列表索引必须是整数或切片,而不是字典。

社区干货

社区干货

Kafka 消息传递详细研究及代码实现|社区征文

Kafka Documentation 中 *[Producer Configs](https://kafka.apache.org/documentation/#producerconfigs)* 里有相关配置说明:[**compression.type**](url)生产者生成的数据的压缩类型。通过使用压缩,可以节省网络带宽和Kafka存储成本。type: stringdefault: nonevalid values: [none, gzip, snappy, lz4, zstd]importance: high [**retries**](url)生产者发送消息失败或出现潜在暂时性错误时,会进行的重试次...

字节跳动新一代云原生消息队列实践

作者|字节跳动消息队列研发工程师-雷丽媛上文我们了解了在字节跳动内部业务快速增长的推动下,经典消息队列 Kafka 的劣势开始逐渐暴露,在弹性、规模、成本及运维方面都无法满足业务需求。因此字节消息队列团队... Proxy 可以感知到相关错误并进行 **退避重试,避免将异常直接暴露给客户端** ;此外我们可以 **监控 Proxy 在访问其他组件时产生的错误** ,进行一些 **自动的故障诊断** ,并将 **故障节点自动隔离** ,避免对用户...

数据库顶会 VLDB 2023 论文解读:Krypton: 字节跳动实时服务分析 SQL 引擎设计

上图是字节典型的广告后端架构,数据通过 Kafka 流入不同的系统。对于离线链路,数据通常流入到 Spark/Hive 中进行计算,结果通过 ETL 导入到 HBase/ES/ClickHouse 等系统提供在线的查询服务。对于实时链路, 数据会直... 大量使用了复合数据类型。从上面的表格中可见,Krypton Format 相比 Parquet,读性能在 TPCH 上提高了 21%,在 Magnus 上提升了 40%;在数据大小上,TPC-H 上,Krypton 增长了 13%,主要是因为 Krypton 内部的索引,但在 M...

应用性能前端监控,字节跳动这些年经验都在这了

则必须先有相关的监控数据,才能对症下药。**性能是留住用户的关键。** 大量的研究报告已经表明了性能和商业成绩的关系,糟糕的性能会让您的站点损失用户数、转化率和口碑。**错误监控则能够让开发者第一时间发现并... 数据收集层: 数据收集层是无状态的API服务,逻辑较轻。只提供针对SDK上报数据的鉴权校验, 拆包等工作, 然后写入消息队列 Kafka 供数据清洗层消费- 数据清洗层:数据清洗层是数据处理的逻辑中心。 提供堆栈格...

特惠活动

特惠活动

Kafka生产者类型错误:列表索引必须是整数或切片,而不是字典。-优选内容

Kafka生产者类型错误:列表索引必须是整数或切片,而不是字典。-优选内容

Kafka生产者类型错误:列表索引必须是整数或切片,而不是字典。-相关内容

Kafka生产者类型错误:列表索引必须是整数或切片,而不是字典。-相关内容

ListKafkaConf

请求参数 无 响应参数 参数 类型 说明 AvailableVersions String 所有支持的Kafka版本列表。 ChargeTypes String 当前Kafka服务支持的计费方式。 - PostPaid:按需计费 - PrePaid:包年/包月 InstanceParams List ... "Description": "日志索引保存时间", "Name": "OffsetRetentionMinutes", "PType": "TypeInt", "Restart": false, "RunningValue": "4320", "Unit": "分钟", "ValueRange": "1-10080" }, { "DefaultValue": "12",...

读取日志服务 TLS 数据写入云搜索服务 ESCloud

您可以使用 Flink kafka 连接器连接日志服务,通过 Flink 任务将日志服务中采集的日志数据消费到下游的大数据组件或者数据仓库。本文通过 Flink SQL 任务,实现读取 TLS 主题中的日志数据,然后写入到 ESCloud 索引中... 本文使用的是 ESCloud 索引。请按照以下步骤创建实例,并获取实例的访问地址。 登录云搜索服务控制台。 在顶部导航栏选择目标地域。 创建实例。在实例列表页面,单击创建实例。 在创建实例页面,设置实例名称,可用区...

从 Kafka 导入数据

最多可创建 100 个不同类型的数据导入配置。 费用说明从 Kafka 导入数据涉及日志服务的写流量、日志存储等计费项。具体的价格信息请参考日志服务计费项。 计费项 说明 写流量 导入 Kafka 数据到日志服务时,涉及日志服务写流量费用。 日志存储 保存 Kafka 数据到日志服务后,后端会自动对其进行压缩,存储费用以压缩后的实际大小为准。 其他 推荐为已导入的数据开启索引,便于后续的查询分析与数据统计。开启索引后会产生索...

字节跳动新一代云原生消息队列实践

作者|字节跳动消息队列研发工程师-雷丽媛上文我们了解了在字节跳动内部业务快速增长的推动下,经典消息队列 Kafka 的劣势开始逐渐暴露,在弹性、规模、成本及运维方面都无法满足业务需求。因此字节消息队列团队... Proxy 可以感知到相关错误并进行 **退避重试,避免将异常直接暴露给客户端** ;此外我们可以 **监控 Proxy 在访问其他组件时产生的错误** ,进行一些 **自动的故障诊断** ,并将 **故障节点自动隔离** ,避免对用户...

接入 Filebeat

Filebeat 是用于转发和集中日志数据的轻量级传输程序,可以监听指定的日志文件或位置,从中收集日志事件并将其转发到 Elasticsearch 或 Logstash 进行索引。本文介绍在 Filebeat 中接入消息队列 Kafka版。 背景信息F... version 使用的 Kafka 客户端版本。建议根据购买的服务端(Kafka 实例)版本进行配置,购买 2.2.2 版本实例则配置为"2.2.0";购买 2.8.2 版本实例则配置为"2.8.0"。 topics 用于指定读取数据的 Topic 列表。 gro...

数据库顶会 VLDB 2023 论文解读:Krypton: 字节跳动实时服务分析 SQL 引擎设计

上图是字节典型的广告后端架构,数据通过 Kafka 流入不同的系统。对于离线链路,数据通常流入到 Spark/Hive 中进行计算,结果通过 ETL 导入到 HBase/ES/ClickHouse 等系统提供在线的查询服务。对于实时链路, 数据会直... 大量使用了复合数据类型。从上面的表格中可见,Krypton Format 相比 Parquet,读性能在 TPCH 上提高了 21%,在 Magnus 上提升了 40%;在数据大小上,TPC-H 上,Krypton 增长了 13%,主要是因为 Krypton 内部的索引,但在 M...

应用性能前端监控,字节跳动这些年经验都在这了

则必须先有相关的监控数据,才能对症下药。**性能是留住用户的关键。** 大量的研究报告已经表明了性能和商业成绩的关系,糟糕的性能会让您的站点损失用户数、转化率和口碑。**错误监控则能够让开发者第一时间发现并... 数据收集层: 数据收集层是无状态的API服务,逻辑较轻。只提供针对SDK上报数据的鉴权校验, 拆包等工作, 然后写入消息队列 Kafka 供数据清洗层消费- 数据清洗层:数据清洗层是数据处理的逻辑中心。 提供堆栈格...

团队变动,裁员 ,拿股权,年底降薪,仍然要往云原生方向进发|社区征文

Go 自然是首屈一指**1. 继续精进 Go,不断的使用学习到的新知识去调整和架构业务代码,引用更加合理的设计去优化历史遗留问题2. 分别梳理和细化了关于反射,切片,通道,map,interface{},指针,结构体等数据类型的源码... 应该也是家常便饭了吧- [微服务框架 go-zero 快速实战](https://juejin.cn/post/7138960256054345741)**日志收集,监控告警**1. ELK2. GRAFANA3. Prometheus4. Superset5. Elasticsearch6. Kafka,Rabbitm...

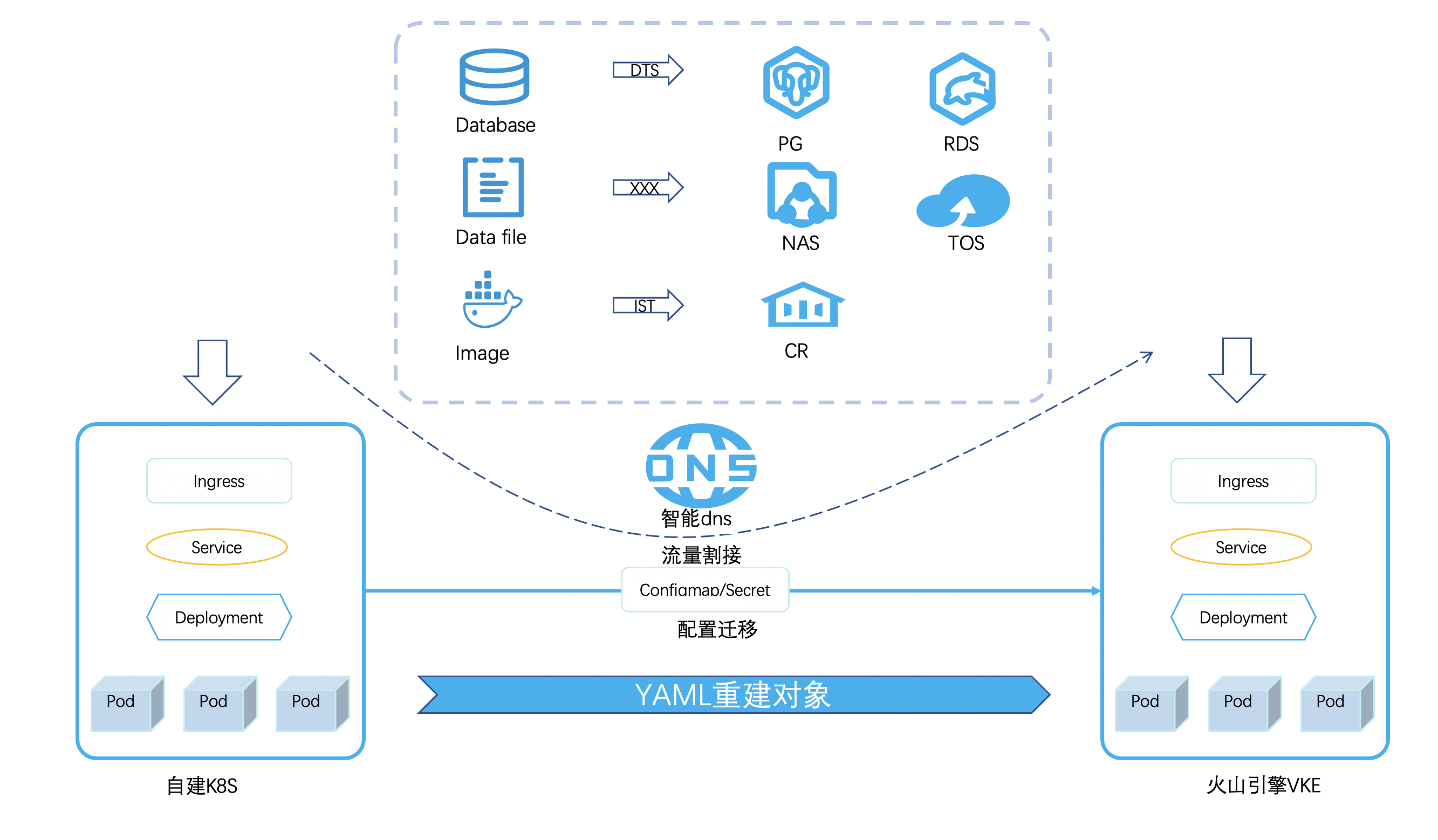

火山引擎上云迁移指南(二):迁移实施

可靠迁移是关键。根据数据类型的不同,我们会使用与之匹配的企业级迁移工具。 - 镜像迁移: ... MirrorMaker是Kafka官方提供的用来做跨机房同步的组件。在kafka的安装目录的bin目录下有一个kafka-mirror-maker.sh文件就是MirrorMaker的入口。MirrorMaker本质上既是一个生产者又是一个消费者,MirrorMaker从一个源...