Kafka消费者无法消费现有主题中的消息。

社区干货

社区干货

聊聊 Kafka:Topic 创建流程与源码分析 | 社区征文

Kafka 中的主题总是多生产者和多订阅者:一个主题可以有零个、一个或多个向其写入事件的生产者,以及零个、一个或多个订阅这些事件的消费者。可以根据需要随时读取主题中的事件——与传统消息传递系统不同,事件在消费... 关于主题、副本分配、分区的相关校验- 检查Topic是否存在- 检查--replica-assignment参数和 (--partitions || --replication-factor) 不能同时使用- 如果 (--partitions || --replication-factor) 没...

如何排查消费者无法连接到Kafka问题

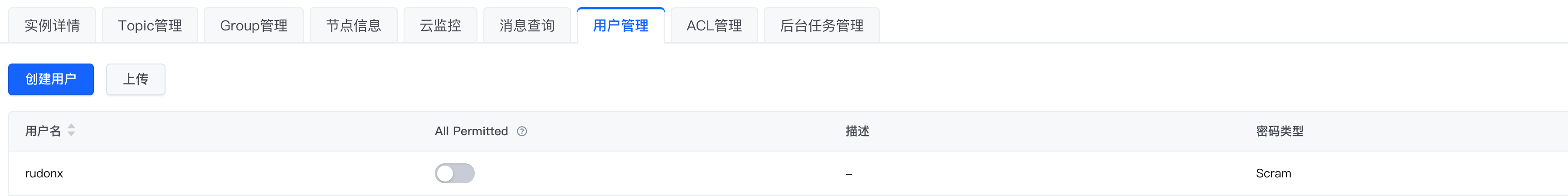

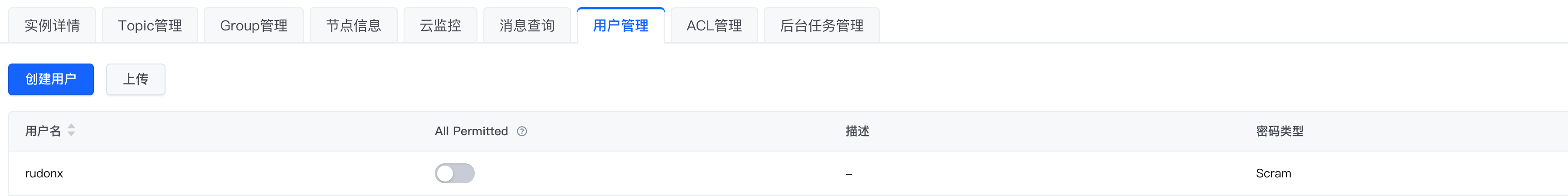

# 问题描述在开发和测试过程中,我们可能会遇到无法连接 Kafka 的情况,本文使用 kafka-console-consumer,来模拟几类常见的连接报错# 环境配置* 密码类型选择 Scram* 使用 SASL_SSL接入点,公网连接,客户端配置文件如下:```Plain Textsasl.jaas.config=org.apache.kafka.common.security.sc...

Kafka 消息传递详细研究及代码实现|社区征文

本文将研究 Kafka 从生产、存储到消费消息的详细过程。 ## Producer### 消息发送所有的 Kafka 服务器节点任何时间都能响应是否可用、是否 topic 中的 partition leader,这样生产者就能发送它的请求到服务器... producer 在确认一个请求发送完成之前需要收到的反馈信息。这个参数是为了保证发送请求的可靠性。acks = 0:producer 把消息发送到 broker 即视为成功,不等待 broker 反馈。该情况吞吐量最高,消息最易丢失acks ...

消息队列选型之 Kafka vs RabbitMQ

对此本文将在接下来的内容中以 Kafka 和 RabbitMQ 为例分享消息队列选型的一些经验。消息队列即 Message+Queue,消息可以说是一个数据传输单位,它包含了创建时间、通道/主题信息、输入参数等全部数据;队列(Queue)是一种 FIFO(先进先出)的数据结构,编程语言一般都内置(内存中的)队列实现,可以作为进程间通讯(IPC)的方法。使用队列最常见的场景就是生产者/消费者模式:生产者生产消息放到队列中,消费者从队列里面获取消息消费。典型...

特惠活动

特惠活动

Kafka消费者无法消费现有主题中的消息。-优选内容

Kafka消费者无法消费现有主题中的消息。-优选内容

Kafka消费者无法消费现有主题中的消息。-相关内容

Kafka消费者无法消费现有主题中的消息。-相关内容

OpenKafkaConsumer

调用 OpenKafkaConsumer 接口为指定日志主题开启 Kafka 协议消费功能。 使用说明调用此接口为日志主题开启 Kafka 协议消费功能之后,可以将日志主题作为 Kafka 的 Topic 进行消费,每条日志对应一条 Kafka 消息。通过 Kafka 协议消费日志具体方式和配置请参考通过 Kafka 协议消费日志。此接口调用频率限制为 20 次/s,超出频率限制会报错 ExceedQPSLimit。 说明 消费日志时会产生私网或公网的读流量。价格信息请参考计费指引。 关闭...

如何排查消费者无法连接到Kafka问题

# 问题描述在开发和测试过程中,我们可能会遇到无法连接 Kafka 的情况,本文使用 kafka-console-consumer,来模拟几类常见的连接报错# 环境配置* 密码类型选择 Scram* 使用 SASL_SSL接入点,公网连接,客户端配置文件如下:```Plain Textsasl.jaas.config=org.apache.kafka.common.security.sc...

流式导入

在 ByteHouse 中,您可以直接通过 Kafka 或 Confluent Cloud 流式传输数据。Kafka 数据导入任务将持续运行,读取 Topic 中的消息。ByteHouse 的 Kafka 任务可以保证 exactly once ,您的数据在消费后即可立即访问。同... Kafka中授予4个权限: 列出主题 (Topics) 列出消费者组 (Consumer group) 消费消息 (Consume message) 创建消费者,以及消费者组 (consumers & consumer groups) 有关通过 Kafka 授权命令行界面授予权限的更多信息,请...

消息生产与消费

如何确定消息是否发送成功? Producer 建立的 Broker 连接数量是多少? Kafka 实例是否支持延迟消息?火山引擎消息队列 Kafka版暂不支持延迟消息。 如何查看正在消费消息的 IP 地址?您可以参考以下步骤查看消费中的客... 中单击实例列表。 找到目标实例,单击实例名称。 在顶部页签栏中单击Group管理,页签中展示当前实例下的 Group 列表。 单击 Group ID,查看指定 Group 的消费状态。在消费者状态区域中,展开 Topic,其中消费者信息一列...

Kafka/BMQ

请直接使用 kafka 连接器访问 Kafka 0.10 和 0.11 集群。Kafka-0.10 和 Kafka-0.11 两个版本的连接器使用的 Kafka 客户端有缺陷,在某些情况下可能无法自动提交 Kafka offset 信息。 使用 datastream API 开发的用户... String 指定 Kafka 消费组的 ID。 注意 在 Flink 中使用 Kafka 连接器消费 BMQ 消息时,需要提前在 BMQ 平台侧创建 Consumer Group。如果没有提前创建 Group,任务可以正常运行,但不能正常提交 Offset。 proper...

Kafka 消息传递详细研究及代码实现|社区征文

本文将研究 Kafka 从生产、存储到消费消息的详细过程。 ## Producer### 消息发送所有的 Kafka 服务器节点任何时间都能响应是否可用、是否 topic 中的 partition leader,这样生产者就能发送它的请求到服务器... producer 在确认一个请求发送完成之前需要收到的反馈信息。这个参数是为了保证发送请求的可靠性。acks = 0:producer 把消息发送到 broker 即视为成功,不等待 broker 反馈。该情况吞吐量最高,消息最易丢失acks ...

Kafka 生产者最佳实践

本文档以 Confluent 官方的 Java 版本 SDK 为例介绍 Kafka 生产者和消费者的使用建议。推荐在使用消息队列 Kafka版进行消息生产与消费之前,阅读以下使用建议,提高接入效率和业务稳定性。 消息顺序性火山引擎 Kafka 实例的消息在同一分区中可以保证数据的先入先出。即写入同一分区的消息,若消息 A 先于消息 B 写入,那么在进行消息读取时,消息A也一定可以先于消息 B 被客户端读到。需要注意的是此处仅保证通过同一生产者先后发送的...

创建 Kafka 触发器

函数服务支持对接火山引擎的 消息队列 Kafka 版。 通过创建 Kafka 触发器,函数服务将作为消费者消费 Kafka 中的消息,并将消息传递给用户函数,触发函数代码逻辑。您无需关心函数服务消费消息的细节,只需编写处理消息... 函数服务将扮演消费者,去消费指定 Kafka 实例下指定 Topic 中的消息。请选择前提条件中准备好的 Kafka 实例和 Topic。 Topic:消息主题,表示一类消息的集合,是消息队列 Kafka 版进行消息订阅的基本单位。 说明 仅支...

Kafka消息订阅及推送

以集团粒度进行消息的分发,部署时默认构建topic为 cdp_dataAsset_orgId_1 ,该topic仅支持消费集团id为1,客户可在终端进入kafka目录通过以下命令进行消费调试 sql //消费kafka/opt/tiger/kafka_2.11-2.1.1/bin/kafk... Long 是 changes 信息变更 Array[Object] 是 4 cdp.label.domain.rename 重命名目录 _event_name 事件名称 String 是 cdp.label.domain.rename _event_timestamp 变更时间 Long 是 project...