kafka从hdp消费代码

社区干货

社区干货

Kafka 消息传递详细研究及代码实现|社区征文

Kafka 是其中之一。Apache Kafka 是一个开源的分布式事件流平台,可跨多台计算机读取、写入、存储和处理事件,并有发布和订阅事件流的特性。本文将研究 Kafka 从生产、存储到消费消息的详细过程。 ## Produce... Kafka consumer 从 broker 中 pull 数据。具体代码实现调用 poll() 方法。```// poll() 调用间隔时间ConsumerRecords records = consumer.poll(Duration.ofMillis(100));```push 和 pull 比较:两者区别...

聊聊 Kafka:Topic 创建流程与源码分析 | 社区征文

Kafka 中的主题总是多生产者和多订阅者:一个主题可以有零个、一个或多个向其写入事件的生产者,以及零个、一个或多个订阅这些事件的消费者。可以根据需要随时读取主题中的事件——与传统消息传递系统不同,事件在消费... 直接跟到创建 topic 的核心代码 getCreateTopicsCall 这里来:```private Call getCreateTopicsCall(final CreateTopicsOptions options, final Map > futures, ...

Logstash 如何通过 Kafka 协议消费 TLS 日志

# **问题现象**如何通过修改 Logstash 配置文件,实现通过 Kafka 协议消费日志到其他业务系统。# 问题分析TLS 日志服务支持通过 Logstash 消费日志数据,您可以通过配置 Logstash 服务内置的 logstash-input-kafk... 强烈建议不要把 AccessKey ID 和 AccessKey Secret 保存到工程代码里,否则可能导致 AccessKey 泄露,威胁您账号下所有资源的安全, 建议使用 `jaas_path` 参数配置,示例如下```Javajaas_path => "/usr/share/logst...

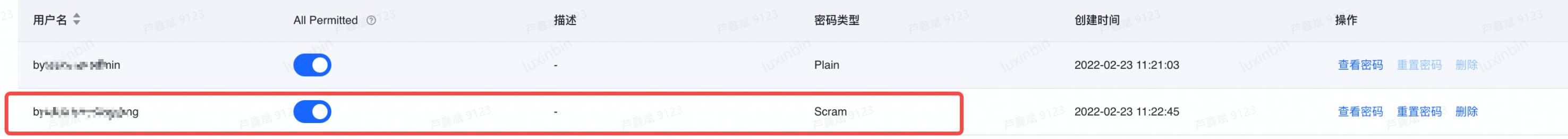

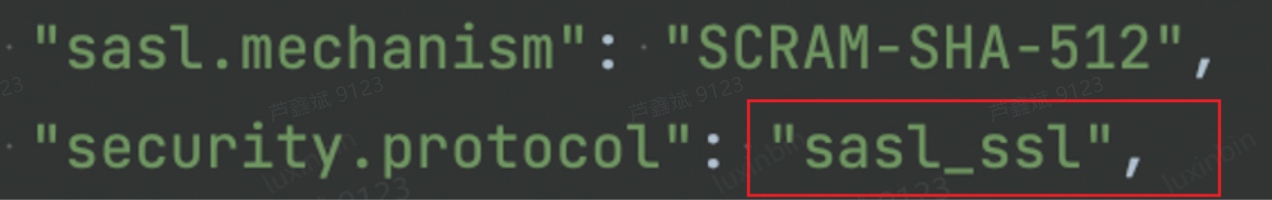

如何使用Scram类型密码连接消息队列Kafka

# 问题描述 客户在前端创建Scram类型密码,代码中无法连接到Kafka  # 问题分析 客户代码中协议及认证机制部分配置如下:  因为SASL_SSL协议并不支持SCRAM,需要更改为SASL_PLAINTEXT...

特惠活动

特惠活动

kafka从hdp消费代码-优选内容

kafka从hdp消费代码-优选内容

kafka从hdp消费代码-相关内容

kafka从hdp消费代码-相关内容

Kafka订阅埋点数据(私有化)

本文档介绍了在增长分析(DataFinder)产品私有化部署场景下,开发同学如何访问Kafka Topic中的流数据,以便进一步进行数据分析和应用,比如实时推荐等。 1. 准备工作 kafka消费只支持内网环境消费,在开始之前,需要提前... 代码示例: Plain public static void main() { Properties properties = new Properties(); // broker list获取方式: sd config kafka_vpc properties.put("bootstrap.servers", "127.0.0.1:9092"); p...

通过 Kafka 消费 Canal Proto 格式的订阅数据

数据库传输服务 DTS 的数据订阅服务支持使用 Kafka 客户端消费 Canal Proto 格式的订阅数据。本文以订阅云数据库 MySQL 版实例为例,介绍如何使用 Go、Java 和 Python 语言消费 Canal Proto 格式的数据。 前提条件已注册火山引擎账号并完成实名认证。账号的创建方法和实名认证,请参见如何进行账号注册和实名认证。 用于订阅消费数据的客户端需要指定服务端 Kafka 版本号,版本号需为 2.2.x(例如 2.2.2)。您可以在示例代码中指定 K...

创建 Kafka 触发器

函数服务支持对接火山引擎的 消息队列 Kafka 版。 通过创建 Kafka 触发器,函数服务将作为消费者消费 Kafka 中的消息,并将消息传递给用户函数,触发函数代码逻辑。您无需关心函数服务消费消息的细节,只需编写处理消息的函数。本文为您介绍如何创建 Kafka 触发器。 前提条件函数已开启 VPC 调用功能,详细操作可参见 更新函数配置。 函数至少完成一次全量发布,详细操作可参见 发布函数。 已创建 Kafka 实例和 Topic,且已获得访问 Kaf...

Kafka 迁移上云(方案一)

本文介绍通过方案一将开源 Kafka 集群迁移到火山引擎消息队列 Kafka版的操作步骤。 注意事项业务迁移只迁移消息生产、消费链路和业务流量,并不会迁移 Kafka 旧集群上的消息数据。 创建Kafka实例、迁移消息收发链路... 为新建的消息队列 Kafka版实例开启新的消费者和生产者,在云端搭建新的消息生产和消费流程,并启动消息的生产与消费。如果 Kafka 实例开启了公网访问,您可以直接修改生产端和消费端代码中的接入点,由自建集群接入点改...

通过 Kafka 消费火山引擎 Proto 格式的订阅数据

Java 和 Python 语言消费 Canal 格式的数据。 前提条件已注册火山引擎账号并完成实名认证。账号的创建方法和实名认证,请参见如何进行账号注册和实名认证。 已安装 protoc,建议使用 protoc 3.18 或以上版本。 说明 您可以执行 protoc -version 查看 protoc 版本。 用于订阅消费数据的客户端需要指定服务端 Kafka 版本号,版本号需为 2.2.x(例如 2.2.2)。您可以在示例代码中指定 Kafka 版本号,具体参数如下表所示。 运行语言 说明...

Kafka/BMQ

Kafka 连接器提供从 Kafka Topic 或 BMQ Topic 中消费和写入数据的能力,支持做数据源表和结果表。您可以创建 source 流从 Kafka Topic 中获取数据,作为作业的输入数据;也可以通过 Kafka 结果表将作业输出数据写入到... 'properties.sasl.jaas.config' = 'org.apache.flink.kafka.shaded.org.apache.kafka.common.security.scram.ScramLoginModule required username="yourname" password="yourpassword";') 示例代码源表示例 sql ...

什么是消息队列 Kafka版

Kafka 构建的分布式消息中间件服务,具备高吞吐、高可扩展性等特性,提供流式数据的发布/订阅和多副本存储机制,广泛应用于日志压缩收集、流式数据处理、消息解耦、流量削峰去谷等应用场景。消息队列 Kafka版开箱即用,业务代码无需改造,帮助您将更多的精力专注于业务快速开发,免除繁琐的部署和运维工作。 产品功能高效的消息收发:海量消息堆积的情况下,消息队列 Kafka版仍然维持Kafka集群对消息收、发的高吞吐能力。对已消费消息重新...

使用 Kafka 协议上传日志

再通过消费管道供下游应用进行消费。日志服务支持通过 Kafka 协议上传和消费日志数据,基于 Kafka 数据管道提供完整的数据上下行服务。使用 Kafka 协议上传日志功能,无需手动开启功能,无需在数据源侧安装数据采集工... Kafka 开源 SDK:直接复制各个配置项的取值,并将其填写在 Kafka 开源 SDK 的对应参数中。完整的代码示例请参考示例代码。 Logstash:日志服务自动生成 Logstash 的 Kafka 插件配置,测试插件连通性。详细说明请参考通...

读取日志服务 TLS 数据写入云搜索服务 Cloud Search

日志服务提供 Kafka 协议消费功能,可以将一个日志主题当作一个 Kafka Topic 来消费,每条日志对应一条 Kafka 消息。您可以使用 Flink kafka 连接器连接日志服务,通过 Flink 任务将日志服务中采集的日志数据消费到下... 在任务编辑区编写生产消息的 SQL 任务的业务逻辑代码。您可以直接使用以下代码,修改 TLS 相关信息即可。代码实现将 Datagen 连接器实时生成的随机数写入 TLS 主题中。 SQL create table orders_datagen ( or...