Kafka流:try-catch块未捕获异常

社区干货

社区干货

Kafka 消息传递详细研究及代码实现|社区征文

## 背景新项目涉及大数据方面。之前接触微服务较多,趁公司没反应过来,赶紧查漏补缺。Kafka 是其中之一。Apache Kafka 是一个开源的分布式事件流平台,可跨多台计算机读取、写入、存储和处理事件,并有发布和订阅事... catch (Exception e) { e.printStackTrace();}producer.close();``` Kafka producer 消息发送的另一种实现方式:```@Slf4jpublic class KafkaTemplateProducer { public void sendTemplat...

聊聊 Kafka:Topic 创建流程与源码分析 | 社区征文

## 一、Topic 介绍Topic(主题)类似于文件系统中的文件夹,事件就是该文件夹中的文件。Kafka 中的主题总是多生产者和多订阅者:一个主题可以有零个、一个或多个向其写入事件的生产者,以及零个、一个或多个订阅这些事... new CreateTopicsOptions().retryOnQuotaViolation(false)) createResult.all().get() println(s"Created topic ${topic.name}.") } catch { case e : ExecutionExceptio...

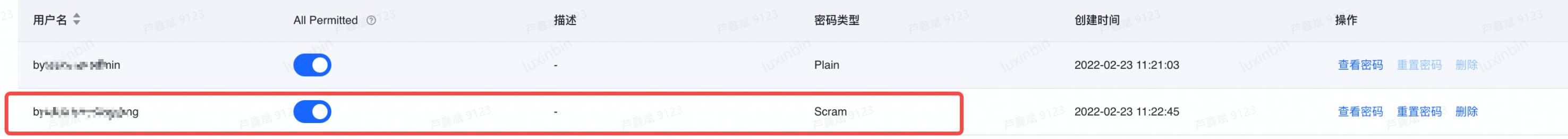

如何使用Scram类型密码连接消息队列Kafka

# 问题描述 客户在前端创建Scram类型密码,代码中无法连接到Kafka  # 问题分析 客户代... try: n = 0 while True: dic = {} dic['id'] = n n = n + 1 dic['myuuid'] = str(uuid.uuid4().hex) dic['time'] = datetime.d...

「火山引擎」数智平台 VeDI 数据中台产品双月刊 VOL.03

有料的模块内容。> > 双月更新,您可通过关注「字节跳动数据平台」官网公众号、添加小助手微信加入社群获取产品动态~> > 接下来让我们来看看 11-12 月数据中台产品有什么大事件吧~## **产品一句话介绍****火... Kafka、ClickHouse、Hudi、Iceberg 等大数据生态组件,100%开源兼容,支持构建实时数据湖、数据仓库、湖仓一体等数据平台架构,帮助用户轻松完成企业大数据平台的建设,降低运维门槛,快速形成大数据分析能力。## **产...

特惠活动

特惠活动

Kafka流:try-catch块未捕获异常

-优选内容

Kafka流:try-catch块未捕获异常

-优选内容

Kafka流:try-catch块未捕获异常

-相关内容

Kafka流:try-catch块未捕获异常

-相关内容

默认接入点收发消息

public synchronized static Properties getKafkaProperties(String path) { if (null != properties) { return properties; } //获取配置文件config.properties的内容 Properties kafkaProperties = new Properties(); try { FileInputStream conf = new FileInputStream(path); kafkaProperties.load(conf); } catch (Exception e) { ...

快速开始

本文介绍如何快速使用 Volcengine Java SDK 实现基础的 Kafka 实例资源管理流程,包括创建实例、创建 Topic等操作。 前提条件已安装 Volcengine Java SDK。更多信息,请参见安装 Java SDK。 已创建并获取火山引擎访问... try { CreateInstanceResponse response = api.createInstance(createInstanceRequest); System.out.println(response); } catch (ApiException e) { System.out...

快速开始

本文介绍如何快速使用 Volcengine Python SDK 实现基础的 Kafka 实例资源管理流程,包括创建实例、创建 Topic 等操作。 前提条件已安装 Volcengine Python SDK。更多信息,请参见安装 Python SDK。 已创建并获取火山... KAFKAApi() try: resp = api_instance.create_instance(volcenginesdkkafka.CreateInstanceRequest( zone_id="cn-beijing-a", version="2.2.2", compute_spec="kafka....

DescribeKafkaConsumer

调用 DescribeKafkaConsumer 查看指定日志主题的 Kafka 消费功能状态。 使用说明此接口调用频率限制为 20 次/s,超出频率限制会报错 ExceedQPSLimit。 请求说明请求方式:GET 请求地址:https://tls-{Region}.ivolces... false:未开启。 ConsumeTopic String out-0fdaa6b6-3c9f-424c-8664-fc0d222c**** Kafka 协议消费主题 ID,格式为 out+日志主题 ID。通过 Kafka 协议消费此日志主题中的日志数据时,Topic 应指定为此 ID。 请求示例...

OpenKafkaConsumer

调用 OpenKafkaConsumer 接口为指定日志主题开启 Kafka 协议消费功能。 使用说明调用此接口为日志主题开启 Kafka 协议消费功能之后,可以将日志主题作为 Kafka 的 Topic 进行消费,每条日志对应一条 Kafka 消息。通过 Kafka 协议消费日志具体方式和配置请参考通过 Kafka 协议消费日志。此接口调用频率限制为 20 次/s,超出频率限制会报错 ExceedQPSLimit。 说明 消费日志时会产生私网或公网的读流量。价格信息请参考计费指引。 关闭...

SASL_SSL 接入点 PLAIN 机制收发消息

public synchronized static Properties getKafkaProperties(String path) { if (null != properties) { return properties; } //获取配置文件config.properties的内容 Properties kafkaProperties = new Properties(); try { FileInputStream conf = new FileInputStream(path); kafkaProperties.load(conf); } catch (Exception e) { ...

SASL_SSL 接入点 SCRAM 机制收发消息

public synchronized static Properties getKafkaProperties(String path) { if (null != properties) { return properties; } //获取配置文件config.properties的内容 Properties kafkaProperties = new Properties(); try { FileInputStream conf = new FileInputStream(path); kafkaProperties.load(conf); } catch (Exception e) { ...

SASL_PLAINTEXT 接入点 PLAIN 机制收发消息

public synchronized static Properties getKafkaProperties(String path) { if (null != properties) { return properties; } //获取配置文件config.properties的内容 Properties kafkaProperties = new Properties(); try { FileInputStream conf = new FileInputStream(path); kafkaProperties.load(conf); } catch (Exception e) { ...

SASL_PLAINTEXT 接入点 SCRAM 机制收发消息

public synchronized static Properties getKafkaProperties(String path) { if (null != properties) { return properties; } //获取配置文件config.properties的内容 Properties kafkaProperties = new Properties(); try { FileInputStream conf = new FileInputStream(path); kafkaProperties.load(conf); } catch (Exception e) { ...