顺序执行SQL过程并在出现错误时停止

社区干货

社区干货

【模板推荐】玩转SQL Server数据库自动同步

还需要在e签宝走签署流程。通过此流程,可以实现:SQL Server新增的文件自动同步至e签宝天印平台发起签署,省去手动上传的麻烦,提高工作效率,减少错误率。 **适用人群:**财务**推荐指数:**⭐⭐⭐⭐⭐ **模板2:** **钉钉同步审批数据至SQL Server数据库******集成应用:****钉钉(自建应用) + SQL Server + 循环执行[ 特惠活动

特惠活动

顺序执行SQL过程并在出现错误时停止

-优选内容

顺序执行SQL过程并在出现错误时停止

-优选内容

顺序执行SQL过程并在出现错误时停止

-相关内容

顺序执行SQL过程并在出现错误时停止

-相关内容

干货 | 在字节跳动,一个更好的企业级SparkSQL Server这么做

> SparkSQL是Spark生态系统中非常重要的组件。面向企业级服务时,SparkSQL存在易用性较差的问题,导致难满足日常的业务开发需求。**本文将详细解读,如何通过构建SparkSQL服务器实现使用效率提升和使用门槛降低。**# 前言Spark 组件由于其较好的容错与故障恢复机制,在企业的长时作业中使用的非常广泛,而SparkSQL又是使用Spark组件中最为常用的一种方式。 相比直接使用编程式的方式操作Spark的RDD或者DataFrame的API,SparkSQL...

SQL诊断使用说明

包括耗时低于5s的查询。当需要重新调整慢查询记录的阈值时,只需要更改auto_profile_slow_query_threshold_ms 为默认值即可。 2 SQL诊断界面2.1 查询监控图查询监控图显示耗时 Top 100 的查询分布,可以方便快速定位耗时长的查询。 2.2 SQL列表SQL列表展示了查询的各种基本信息,可以按照不同条件进行搜索。点击查询 ID 可以进入查询详情页。 2.3 查询详情页2.3.1 查询概述 查询总览展示了查询的详细信息,例如开始时间、执行用户、 ...

SQL 语法

1. 概述 LAS SQL 语法标准以 ANSI SQL 2011 为基础,增加了 OLAP 相关语法,同时基于 Spark 3.0,支持了大部分的 Spark SQL build-in functions。 2. 阅读说明 中括号[] 括起来的部分代表 可选 。比如 CREATE TABLE [... 增删列语法支持内表和外表,属于 Schema Evolution 的特性,需要说明的是,对于LAS内表而言,有如下限制:对于 LAS 标准内表,alter table add column 执行后需要至少写入一条数据,否则 presto 执行查询时,将会报错不支持...

在字节跳动,一个更好的企业级 SparkSQL Server 这么做

> SparkSQL是Spark生态系统中非常重要的组件。面向企业级服务时,SparkSQL存在易用性较差的问题,导致难满足日常的业务开发需求。**本文将详细解读,如何通过构建SparkSQL服务器实现使用效率提升和使用门槛降低。**# **1. 前言**Spark 组件由于其较好的容错与故障恢复机制,在企业的长时作业中使用的非常广泛,而SparkSQL又是使用Spark组件中最为常用的一种方式。相比直接使用编程式的方式操作Spark的RDD或者DataFrame的API,Sp...

干货 | 在字节跳动,一个更好的企业级SparkSQL Server这么做

> > > SparkSQL是Spark生态系统中非常重要的组件。面向企业级服务时,SparkSQL存在易用性较差的问题,导致> 难满足日常的业务开发需求。> **本文将详细解读,如何通过构建SparkSQL服务器实现使用效率提升和使用门... Spark 组件由于其较好的容错与故障恢复机制,在企业的长时作业中使用的非常广泛,而SparkSQL又是使用Spark组件中最为常用的一种方式。 相比直接使用编程式的方式操作Spark的RDD或者DataFrame的API,SparkSQL可直...

开发 Flink SQL 任务

负责开发 SQL 任务,完成开发和调试后将任务上线到生产环境。 运维阶段:一般是运维人员(Project_OPS)负责启动任务,并查看任务执行情况。 步骤一:开发 SQL 任务登录流式计算 Flink 版控制台。 在顶部菜单栏选择目标... 系统提示success。 代码编辑和验证通过后,单击保存按钮,保存任务代码。 步骤二:调试 SQL 任务系统验证功能只能校验 SQL 语法正确性,无法完全规避代码运行中可能出现的错误,在任务上线前,强烈建议完成任务调试。...

订阅方案概览

在完成配置对象或预检查后,选择保存后,任务进入的状态。 执行中 订阅任务正在进行的任务。 订阅失败 在订阅过程中出现问题或故障时,导致任务中断或异常后,任务进入的状态。 订阅完成 订阅任务执行以下操作后,任务进入的状态: 订阅任务完成后,进入的状态。 终止处在执行中的任务,任务状态将先进入终止中,随后进入订阅完成。 订阅方案概览源数据库类型 版本 源数据库接入方式 支持订阅的数据类型 配置文档 MySQL MySQL 5.7 M...

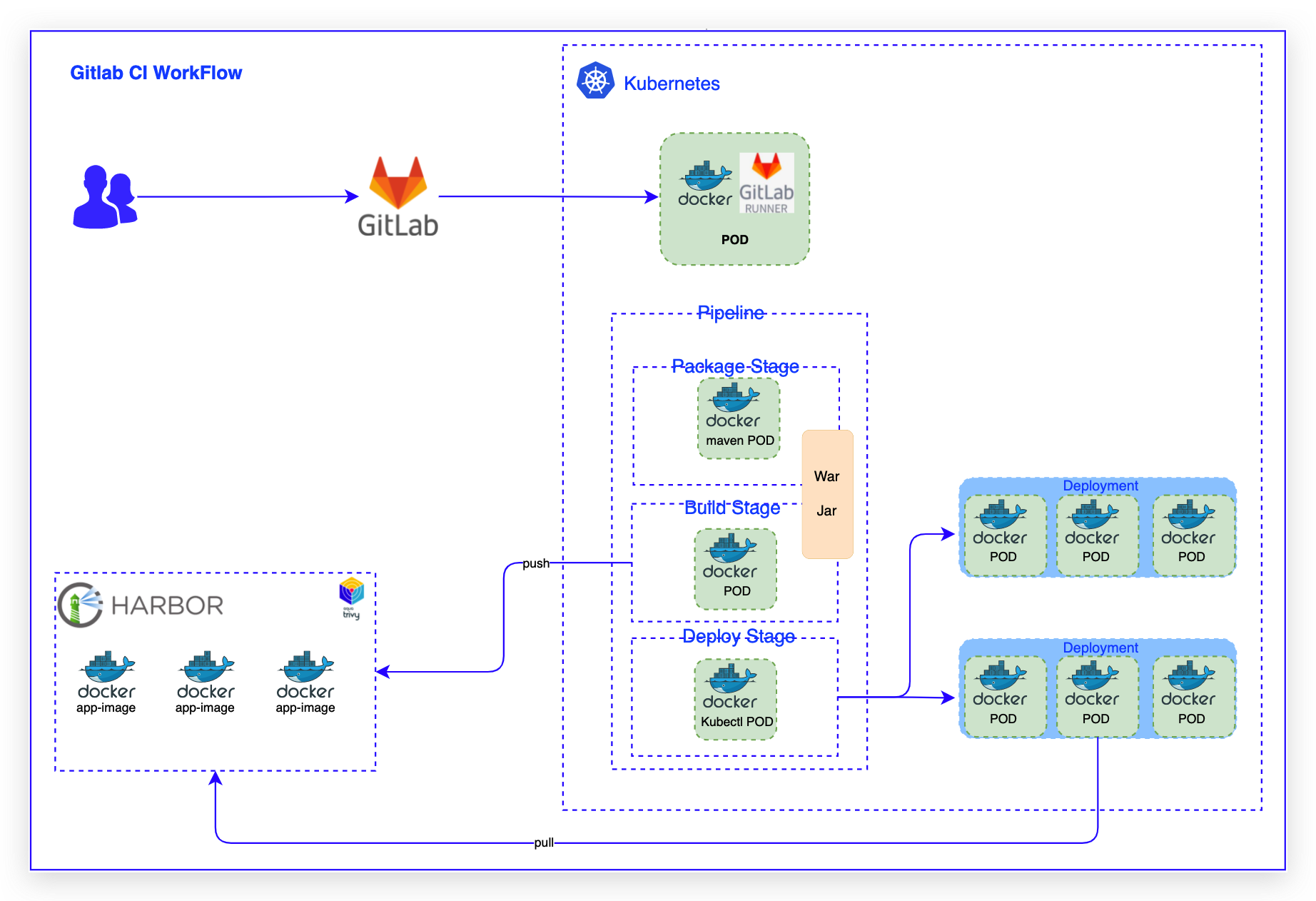

2022技术盘点之平台云原生架构演进之道|社区征文

容器编排:在CD过程中,利用kubectl set image进行容器编排部署,自建Kubernetes集群进行业务容器编排管理- 高可用:当某个节点出现故障时,Kubernetes 会自动创建一个新的 GitLab-Runner 容器,并挂载同样的 Runner 配置,使服务达到高可用。- 弹性伸缩:触发式任务,合理使用资源,每次运行脚本任务时,Gitlab-Runner 会自动创建...

管理定时 SQL 分析任务

成功创建定时 SQL 任务后,您可以在控制台中查看定时 SQL 任务的基础配置等信息,还可以启动或暂停任务。本文档介绍管理定时 SQL 任务的相关操作步骤。 查看任务详情创建定时 SQL 任务后,您可以参考以下步骤查看任务... 您可以在任务列表中查看各个任务的概览信息,例如任务状态、源日志主题等。关于任务状态的详细说明请参考任务状态。 单击指定的任务名称。您可以在任务详情页面中查看指定任务的基本信息和任务执行情况,详细信息请参...