数据仓库数据集市ods

社区干货

社区干货

数仓黄金价值圈: 为什么、是什么、怎么做|社区征文

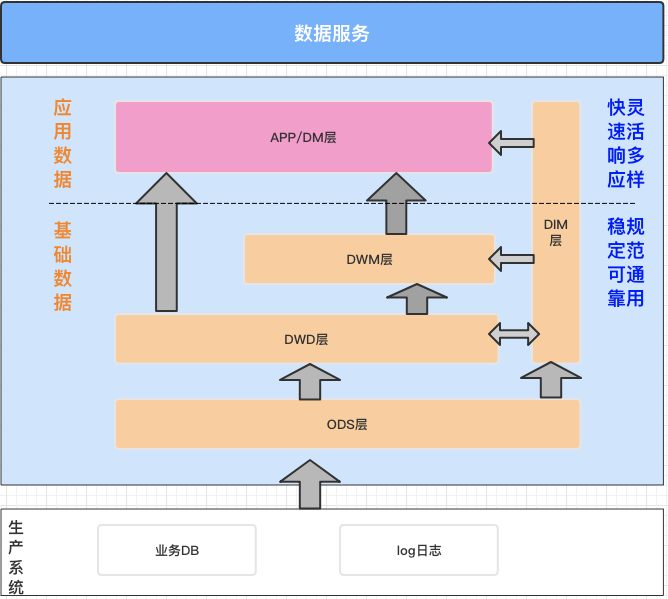

今天给大家一起分享下有着悠久历史的数据仓库的一些思考由三部分组成为什么,搭建数据仓库是什么,数据仓库定义怎么做,如何搭建数仓# 一:为什么,搭建数据仓库最终目标:**数据驱动资源优化配置,即科学、高效... 方便后期数据核对需要。- CDM:通用数据模型,又称为数据中间层(Common Data Model),包含DWD、DWS、DIM层。- DWD:数据仓库明细层数据(Data Warehouse Detail)。对ODS层数据进行清洗转化,以业务过程作为建模驱动...

DataLeap数据仓库流程最佳实践

基于上述表数据,我们的数据分析需求如下:1)“查看最近三天商店销售额情况(未促销)TOP3”2)“查看最近三天消费最多的用户与金额TOP3”3)“获取商店地域分布情况”经典数据仓库按照大类分为基础数据层、应用数据层。本样例中,我们的数据仓库建设思路是:* ODS(从生产系统采集原始数据,并将原始数据集成...

一种在数据量比较大、字段变化频繁场景下的大数据架构设计方案|社区征文

后续数据存储时就要选择列可以随意增减,或者列增减成本不高的存储方案。我们考虑以上情况,发现Kappa架构还是较符合的,整体流程如图1从源系统同步过来的数据落到ODS层,但是要注意采集...

浅谈数仓建设及数据治理 | 社区征文

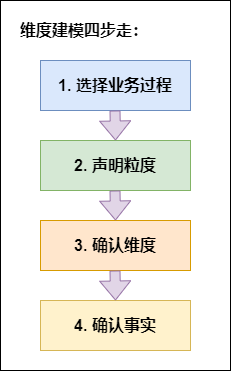

维度表来构建数据仓库、数据集市。目前在互联网公司最常用的建模方法就是维度建模。**维度建模怎么建:**在实际业务中,给了我们一堆数据,我们怎么拿这些数据进行数仓建设呢,数仓工具箱作者根据自身60多年的实际业务经验,给我们总结了如下四步。数仓工具箱中的维度建模四步走:这四步是环环相扣,步步相连。下面详细拆解下每个步骤怎么做**1...

特惠活动

特惠活动

数据仓库数据集市ods-优选内容

数据仓库数据集市ods-优选内容

数据仓库数据集市ods-相关内容

数据仓库数据集市ods-相关内容

实战分享(直播&PPT)

欢迎关注【字节跳动数据平台】视频号,第一时间获取更多技术分享。以下是关于大数据、湖仓一体、数据湖、数据仓库、开源、数据中台等主题的直播与演讲 PPT 等一手材料,欢迎自取与观看: 【Apache Hudi 中文社区技术交... 《数据湖化的新思考》《基于数据湖的样本存储与样本生成》 Hudi 中文社区技术交流会-第九期 2023.03.30《社区最新进展同步》《字节跳动基于 Hudi 的湖仓一体及应用实践》《电商流量基于 Hudi 的 ODS 落湖实践》 Hu...

创建专题设置

说明 “数据专题”以业务视角出发,将服务于同一业务场景的表归纳整理,形成数据仓库,方便使用者查询及管理。以营销场景为例,可以按照商品中心、会员中心等方向,形成对应数仓。PS:专题中,涉及到产品线、业务域、主题... 以此数据las schema库,添加 ods、dim、dwd、dwm 库。 点击确认选择,再点击确认后保存成功 可按需编辑专题调整等操作,同时支持目录刷新

浅谈数仓建设及数据治理 | 社区征文

维度表来构建数据仓库、数据集市。目前在互联网公司最常用的建模方法就是维度建模。**维度建模怎么建:**在实际业务中,给了我们一堆数据,我们怎么拿这些数据进行数仓建设呢,数仓工具箱作者根据自身60多年的实际业务经验,给我们总结了如下四步。数仓工具箱中的维度建模四步走:这四步是环环相扣,步步相连。下面详细拆解下每个步骤怎么做**1...

ByteHouse:基于ClickHouse的实时数仓能力升级解读

ByteHouse是火山引擎上的一款云原生数据仓库,为用户带来极速分析体验,能够支撑实时数据分析和海量数据离线分析。便捷的弹性扩缩容能力,极致分析性能和丰富的企业级特性,助力客户数字化转型。全篇将从两个版块讲解... 各种各样的数据源都可以通过Kafka或者Flink写入到ByteHouse里面,然后来对接上层的应用。按照数仓分层角度,Kafka、Flink可以理解为ODS层,那ByteHouse就可以理解为DWD和DWS层。如果说有聚合或者预计算的场景,也可以...

干货 | 这样做,能快速构建企业级数据湖仓

Codegen 和向量化都是从数据仓库,而不是 Hadoop 体系的产品中衍生出来。Codegen 是 Hyper 提出的技术,而向量化则是 MonetDB 提出的,所以计算引擎的精细化也是沿着数仓开辟的路子在走。Spark 等 Hadoop 体系均走... 以便支持应用层直接使用数据集市中的数据。以某互联网企业平台部门距离,用户期望基于业务数据构建分析平台,支持多种分析负载,包括可视化大屏、报表系统、自助分析以及开发分析应用等。 要搭建这种多元化分析...

字节跳动基于数据湖技术的近实时场景实践

Hudi不仅仅是数据湖的一种存储格式(Table Format),而是提供了Streaming 流式原语的、具备数据库、 数据仓库核心功能(高效upsert/deletes、索引、压缩优化)的数据湖平台。 - Hudi 支持各类计算、查询引擎(Fli... 字节数据湖拥有良好的元数据管理能力,并在此之上实现了索引。使用行、列存储并用的存储格式,为高性能读写提供坚实的基础。 - 字节数据湖新增了多源拼接功能,对于需要融合多种数据源或者构建集市型数据集的场...

基于 ByteHouse 构建实时数仓实践

> 更多技术交流、求职机会,欢迎关注字节跳动数据平台微信公众号,回复【1】进入官方交流群 **随着数据的应用场景越来越丰富,企业对数据价值反馈到业务中的时效性要求也越来越高,很早就有人提出过一个概念:**... 提高数据稳定性;ByteHouse 作为流式数据持久化存储层,使用 ByteHouse HaKafka 、HaUniqueMergeTree 表引擎可将 Kafka 临时数据高效稳定接入储存到 ByteHouse ,为后端应用提供极速统一的数据集市查询服务。具体的...

干货|ByteHouse:百万级TPS!看字节跳动如何基于ClickHouse落地高性能实时数仓

> yteHouse 是火山引擎上的一款云原生数据仓库,为用户带来极速分析体验,能够支撑实时数据分析和海量数据离线分析。便捷的弹性扩缩容能力,极致分析性能和丰富的企业级特性,助力客户数字化转型。> > > > > **全... 各种各样的数据源都可以通过Kafka或者Flink写入到ByteHouse里面,然后来对接上层的应用。按照数仓分层角度,Kafka、Flink可以理解为ODS层,那ByteHouse就可以理解为DWD和DWS层。如果说有聚合或者预计算的场景,也...

使用说明

也加入了数据仓库才有的事务、数据校验等功能,既解决了数据湖数据混乱难于治理的问题,也解决了数据仓库数据封闭、信息损失以及时效性不强的问题。 Lakehouse 定位(图片来源于 Spark-Submit 2022) 基于 Delta Lake 可以构建所谓的 Lakehouse 解决方案,原始数据以流式或者批式的方式写入 Delta Lake,在 Delta Lake 内部完成 Bronze Table 到 Gold Table 的 transform 过程(类比数据仓库的 ODS 到 ADS 的过程)。不论是原始表、中间表...