kafka-console-producer使用Kerberos时抛出security-protocol不是一个被识别的选项。

社区干货

社区干货

如何排查消费者无法连接到Kafka问题

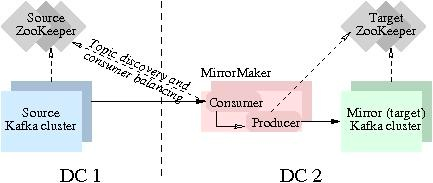

# 问题描述在开发和测试过程中,我们可能会遇到无法连接 Kafka 的情况,本文使用 kafka-console-consumer,来模拟几类常见的连接报错# 环境配置* 密码类型选择 Scram本实验主要聚焦跑通Kafka MirrorMaker (MM1)数据迁移流程。实验中的Source Kafka版本为2.12,基于本地机器搭建。现实生产环境会更加复杂,如果您有迁移类的需求,欢迎咨询[技术支持服务](https://console.volcengine.com...

「火山引擎数据中台产品双月刊」 VOL.07

语法自动识别等能力。- **【** **私有化 2.0 上线** **】** - 更加面向 Hadoop 开源生态 - 本次迭代统一管控了 Hadoop、HBase、Kafka、Hive、OpenSearch、Tez、Kerberos、ZooKeeper,元数据配置上新增了 Hive Meta 支持集群内置 MySQL、独立 RDS。 - 面向生态提供开源组件的技术能力。 - Hadoop 生态、CDH 体系向 LAS 2.0 的迁移更容易对标、集成更容易实现。 - LAS 湖仓能力...

「火山引擎」数智平台 VeDI 数据中台产品双月刊 VOL.07

语法自动识别等能力。- **【** **私有化 2.0 上线** **】** - 更加面向 Hadoop 开源生态 - 本次迭代统一管控了 Hadoop、HBase、Kafka、Hive、OpenSearch、Tez、Kerberos、ZooKeeper,元数据配置上新增了 Hive Meta 支持集群内置 MySQL、独立 RDS。 - 面向生态提供开源组件的技术能力。 - Hadoop 生态、CDH 体系向 LAS 2.0 的迁移更容易对标、集成更容易实现。 - LAS 湖仓能力、...

特惠活动

特惠活动

kafka-console-producer使用Kerberos时抛出security-protocol不是一个被识别的选项。-优选内容

kafka-console-producer使用Kerberos时抛出security-protocol不是一个被识别的选项。-优选内容

kafka-console-producer使用Kerberos时抛出security-protocol不是一个被识别的选项。-相关内容

kafka-console-producer使用Kerberos时抛出security-protocol不是一个被识别的选项。-相关内容

默认接入点收发消息

使用默认接入点时,配置文件示例如下。 说明 请根据注释提示填写相关参数,并删除注释。 JSON { "bootstrap.servers": "xxxxx", // 修改配置为实例的默认接入点 "security.protocol": "PLAINTEXT", // 默认接入点... 2 发送消息 实现方法创建消息发送程序 producer.py。 编译并运行 producer.py 发送消息。 查看运行结果。运行结果示例如下。 说明 消息队列 Kafka版提供示例项目供您快速接入,下载并解压缩 Demo 后,可以直接执行以...

默认接入点收发消息

/kafka.go```` 示例代码通过默认接入点生产消息的示例代码如下,您也可以参考 Demo 中的示例文件 {DemoPath}/client/producer.go,实现相关业务逻辑。 go package clientimport ( "fmt" "github.com/confluentinc/confluent-kafka-go/kafka")func RunProduce(config *KafkaConf) error { // 构造生产配置 configMap := &kafka.ConfigMap{ "bootstrap.servers": config.BootstrapServers, "security.protocol": ...

Kafka数据同步

用户只需要通过简单的consumer配置和producer配置,启动MirrorMaker,即可实现实时数据同步。本实验主要聚焦跑通Kafka MirrorMaker (MM1)数据迁移流程。实验中的Source Kafka版本为2.12,基于本地机器搭建。现实生产环境会更加复杂,如果您有迁移类的需求,欢迎咨询[技术支持服务](https://console.volcengine.com...

通过 Kafka 协议消费日志

日志服务提供 Kafka 协议消费功能,即可以将一个日志主题,当作一个 Kafka Topic 来消费。本文档介绍通过 Kafka 协议消费日志数据的相关步骤。 背景信息日志服务支持为指定的日志主题开启 Kafka 协议消费功能,开启后... props.put(CommonClientConfigs.SECURITY_PROTOCOL_CONFIG, "SASL_SSL"); props.put(SaslConfigs.SASL_MECHANISM, "PLAIN"); props.put(SaslConfigs.SASL_JAAS_CONFIG, "org...

快速开始

选择分析场景为实时计算,集群类型为 Kafka。 根据需要填写好其它的集群创建选项,确认无误后,单击立即创建,提交创建集群。详见创建集群。 单击集群列表 > Kafka 集群名称, 进入集群详情页,可以查看集群创建的进度... 在录入时不需要做任何字符串替换。 listener.security.protocol.map 配置为INTERNAL:PLAINTEXT,EXTERNAL:PLAINTEXT inter.broker.listener.name 配置为INTERNAL advertised.listeners 配置为INTERNAL://{{host...

Python SDK

producer.send('your topic', b'some_message_bytes').get() print("send message: partition " + str(result.partition) + " offset " + str(result.offset)) SASL_PLAINTEXT通过 SASL 用户名和密码进行鉴权。您需要获取有权限用户的名称和密码,如何获取请参见获取(重置)用户密码。 Python from kafka import KafkaProducerproducer = KafkaProducer( bootstrap_servers="your broker list", security_protocol="SASL_...

「火山引擎数据中台产品双月刊」 VOL.07

语法自动识别等能力。- **【** **私有化 2.0 上线** **】** - 更加面向 Hadoop 开源生态 - 本次迭代统一管控了 Hadoop、HBase、Kafka、Hive、OpenSearch、Tez、Kerberos、ZooKeeper,元数据配置上新增了 Hive Meta 支持集群内置 MySQL、独立 RDS。 - 面向生态提供开源组件的技术能力。 - Hadoop 生态、CDH 体系向 LAS 2.0 的迁移更容易对标、集成更容易实现。 - LAS 湖仓能力...

支持的云服务

security_group 安全组volcengine_security_group_rule 安全组规则volcengine_subnet 子网volcengine_vpc 虚拟私有网络 公网IP 公网IP(Elastic IP Address,EIP)及其公网出口带宽,是火山引擎为云资源提供的可独立... volcengine_tls_alarm 日志告警volcengine_tls_alarm_notify_group 日志告警组volcengine_tls_host 日志机器volcengine_tls_host_group 日志机器组volcengine_tls_index 日志索引volcengine_tls_kafka_consumer ...

「火山引擎」数智平台 VeDI 数据中台产品双月刊 VOL.07

语法自动识别等能力。- **【** **私有化 2.0 上线** **】** - 更加面向 Hadoop 开源生态 - 本次迭代统一管控了 Hadoop、HBase、Kafka、Hive、OpenSearch、Tez、Kerberos、ZooKeeper,元数据配置上新增了 Hive Meta 支持集群内置 MySQL、独立 RDS。 - 面向生态提供开源组件的技术能力。 - Hadoop 生态、CDH 体系向 LAS 2.0 的迁移更容易对标、集成更容易实现。 - LAS 湖仓能力、...