U-SQL-- 从文件夹中读取最新修改的文件

社区干货

社区干货

达梦@记一次国产数据库适配思考过程|社区征文

(https://p9-juejin.byteimg.com/tos-cn-i-k3u1fbpfcp/0b992f4419994e2fa9f6ed6699f72c03~tplv-k3u1fbpfcp-5.jpeg?)若是通过**Mysql或Oracle或其他数据库,文件等方式迁移导入**。这里记录一下迁移过程中遇到的问题... ```说明:这里的groupId坐标参数,可由使用者自行在nexus中upload创建声明,然后在pom.xml中引入相关坐标即可。扩展:若是需要从本地deploy到nexus或是先获取本地仓库.m2的包->nexus仓库的包->aliyun maven仓库的包...

2022技术盘点之平台云原生架构演进之道|社区征文

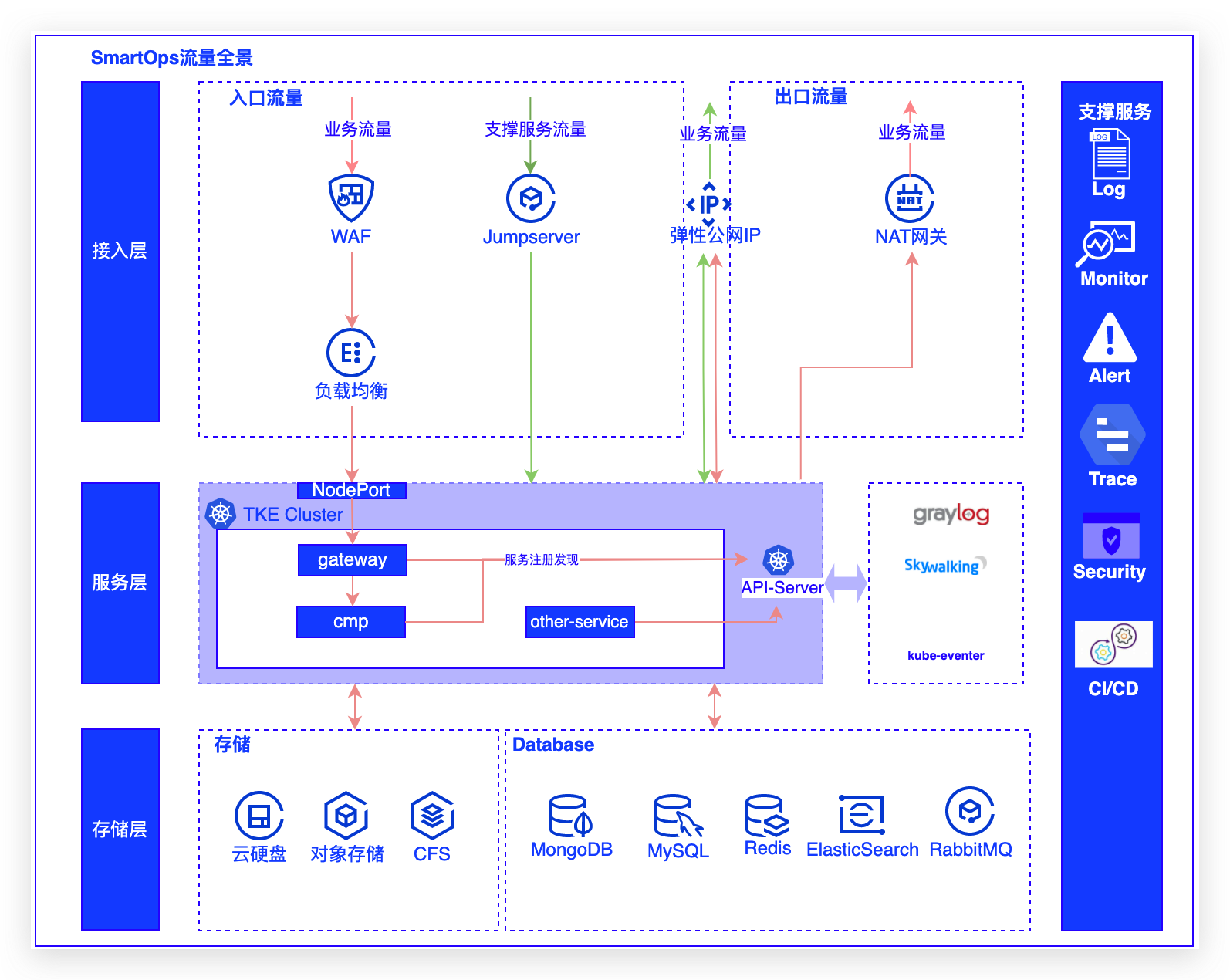

数据库有MongoDB分片集群/MySQL/Redis/ElasticSearch/RabbitMQ进行各类业务数据计算和存储## 三 流量管控... 服务通过Kubernetes API-Server获取后端一组Service Pod真实IP,业务POD通过Calico网络进行POD与POD直接流量通讯。## 四 安全管控### 4.1 SmartOps安全全景 特惠活动

特惠活动

U-SQL-- 从文件夹中读取最新修改的文件-优选内容

U-SQL-- 从文件夹中读取最新修改的文件-优选内容

U-SQL-- 从文件夹中读取最新修改的文件-相关内容

U-SQL-- 从文件夹中读取最新修改的文件-相关内容

配置参数说明

=your_value配置文件除了使用标志 flag 指定配置参数外,更推荐用配置文件的方式,可以将配置持久化,便于有需要的时候进行调用。 在 ByteHouse CLI 启动时,会默认寻找名为 bytehouse_conf.toml 的默认配置文件。如果... uesecure = trueconnection_timeout = 100 Settings for query Settings, set SQL mode by 1 or 0 ansi_sql = 0加载配置文件使用配置文件的方式如下: shell bytehouse-cli --config_file bytehouse_conf.toml按照如...

ByteHouse+Apache Airflow:高效简化数据管理流程

中检索相关数据文件来启动数据加载过程。它使用适当的凭据和 API 集成确保与 S3 存储桶的安全身份验证和连接。一旦数据从 AWS S3 中获取,Airflow 会协调数据的转换和加载到 ByteHouse 中。它利用 ByteHouse 的集成能力,根据预定义的模式和数据模型高效地存储和组织数据。 成功将数据加载到 ByteHouse 后,数据洞察有限公司可以利用 ByteHouse 的功能进行分析和机器学习任务。他们可以使用 ByteHouse 的类 SQL 语言查询数据,...

读取云原生消息引擎 BMQ 数据写入对象存储 TOS

本文介绍通过一个简单的 Flink SQL 任务,实现从 BMQ Topic 中读取实时数据,然后写入 TOS 中。 流程介绍 准备数据源 BMQ Topic。您需要在云原生消息引擎控制台创建资源池、Topic 和 Consumer Group,并获取资源池接入点地址。 准备数据目的 TOS Bucket。您需要在对象存储控制台创建存储桶和文件夹。 开发 Flink SQL 任务。当您准备好数据源和数据目的后,便可以在流式计算 Flink 控制台开发 SQL 任务,通过简单的代码实现从 BMQ Topi...

分布式数据库在抖音春晚活动中的应用

u1fbpfcp-5.jpeg?)相信对数据库感兴趣的同学对上面这张图也不会陌生。这张图是 DB Engines 的数据库排名,准确来说是一个关系型数据库的排名。在 2021 年 4 月份的榜单上,MySQL 和 PG 都是关系型数据库的 Top5。这... 首先是这个架构里使用了数据库中间件。中间件本身存在一定的使用限制,对用户不是很友好。举个例子,它可能在使用的过程中需要用户感知一些 sharding key,如果用户不指定sharding key,读写可能会被放大,使用起来性能...

集成示例

资源中心通常用于上传文件、UDF 函数和任务组管理。 EMR DolphinScheduler 中的资源中心基于同集群内的 Hadoop 集群,默认目录是:/dolphinscheduler,由配置项 resource_upload_path 定义。关于如何修改服务配置参数... 在上方导航栏中,单击资源中心按钮,进入资源文件夹管理界面。 在文件管理界面,单击上传文件按钮,从本地选择对应文件,单击确定按钮,完成资源上传。 3 数据源中心在运行 Spark SQL、Hive SQL 类型任务时,DolphinS...

读取日志服务 TLS 数据写入云搜索服务 Cloud Search

还需要获取项目的访问地址、项目 ID、主题 ID,Kafka 协议主题 ID,以便在 Flink SQL 任务中填入信息实现与 TLS 的连通。 准备数据目的 ESCloud Index。您需要在云搜索服务控制台购买实例并获取实例的访问地址。 开发... 读取能力为 10 MiB/s、100 次/s。创建后暂不支持修改分区数量,但支持通过自动分裂功能提高日志主题的整体读写能力。 自动分裂日志分区 是否开启分区的自动分裂功能。 (默认)开启:当写入的数据量连续 5 分钟超过已...

读取日志服务 TLS 数据写入云搜索服务 ESCloud

还需要获取项目的访问地址、项目 ID、主题 ID,Kafka 协议主题 ID,以便在 Flink SQL 任务中填入信息实现与 TLS 的连通。 准备数据目的 ESCloud Index。您需要在云搜索服务控制台购买实例并获取实例的访问地址。 开发... 读取能力为 10 MiB/s、100 次/s。创建后暂不支持修改分区数量,但支持通过自动分裂功能提高日志主题的整体读写能力。 自动分裂日志分区 是否开启分区的自动分裂功能。 (默认)开启:当写入的数据量连续 5 分钟超过已...

干货|ByteHouse+Airflow:六步实现自动化数据管理流程

Airflow通过从AWS S3中检索相关数据文件来启动数据加载过程。它使用适当的凭据和API集成确保与S3存储桶的安全身份验证和连接。一旦数据从AWS S3中获取,Airflow会协调数据的转换和加载到ByteHouse中。它利用ByteHouse的集成能力,根据预定义的模式和数据模型高效地存储和组织数据。 成功将数据加载到ByteHouse后,可以利用ByteHouse的功能进行分析和机器学习任务,使用ByteHouse的类SQL语言查询数据,进行复杂的分析后生...

分布式数据库在抖音春晚活动中的应用

ure=bXEucp4SHYNdSPFJKiW375jM%2Fw0%3D)相信对数据库感兴趣的同学对上面这张图不会陌生。这张图是 DB Engines 的数据库排名,准确来说是一个关系型数据库的排名。在 2021 年 4 月份的榜单上,MySQL 和 PG 都... 首先是这个架构里使用了数据库中间件。 **中间件本身存在一定的使用限制** ,对用户不是很友好。举个例子,它可能在使用的过程中需要用户感知一些 sharding key,如果用户不指定 sharding key,读写可能会被放大,使用...