hbase卡在split

社区干货

社区干货

9年演进史:字节跳动 10EB 级大数据存储实战

HBase,日志服务,Kafka 数据存储 - Yarn,Flink 的计算框架平台数据 - Spark,MapReduce 的计算相关数据存储![]()# **字节跳动特色的** **HDFS** **架构**在深入相关的技术细节之前,我们先看看字节跳动的 H... 被卡在某个慢请求的处理上。我们优化的方向会分为读慢节点和写慢节点两个方面。### **读慢节点优化**我们经历了几个阶段:- 最早,使用社区版本,其 Switch Read 以读取一个 packet 的时长为统计单位,当读取...

干货|Hudi Bucket Index 在字节跳动的设计与实践

**HBase Index** | 维护每一个 Record Key 的 Partition Path 和 File Group,在插入 File Group定位阶段所有 task 向 HBase 发送 Batch Get 请求,获取 Record Key 的 Mapping 信息。 | 重量级,Record Key ... 而 Hudi 表是以 File Group 为单位将数据切割生成 inputSplit 的,单个 File Group 数据过大将导致查询并发降低,性能下降。 **一般说来建议单个桶的大小控制在 3 GB 左右。**- 同时我们也应该避免桶的数量过多,过...

干货|Hudi Bucket Index 在字节跳动的设计与实践

**HBase Index** | 维护每一个 Record Key 的 Partition Path 和 File Group,在插入 File Group定位阶段所有 task 向 HBase 发送 Batch Get 请求,获取 Record Key 的 Mapping 信息。 | 重量级,Record Key 到 Fil... 而 Hudi 表是以 File Group 为单位将数据切割生成 inputSplit 的,单个 File Group 数据过大将导致查询并发降低,性能下降。 **一般说来建议单个桶的大小控制在 3GB 左右。*** 同时我们也应该避免桶的数量过多,过...

Hudi Bucket Index 在字节跳动的设计与实践

**HBase Index** | 维护每一个 Record Key 的 Partition Path 和 File Group,在插入 File Group定位阶段所有 task 向 HBase 发送 Batch Get 请求,获取 Record Key 的 Mapping 信息。 | 重量级,Record Key 到 File Group 的 mapping 记录在 HBase。对于小批次的keys,查询效率高,依赖外部系统。Hbase Index 会引入额外的外部系统,从而提升运维代价。 |在本文中,我们将介绍一个新的 Hudi 索引模块 Bucket Index 在字节跳动...

特惠活动

特惠活动

hbase卡在split-优选内容

hbase卡在split-优选内容

hbase卡在split-相关内容

hbase卡在split-相关内容

Hudi Bucket Index 在字节跳动的设计与实践

**HBase Index** | 维护每一个 Record Key 的 Partition Path 和 File Group,在插入 File Group定位阶段所有 task 向 HBase 发送 Batch Get 请求,获取 Record Key 的 Mapping 信息。 | 重量级,Record Key 到 File Group 的 mapping 记录在 HBase。对于小批次的keys,查询效率高,依赖外部系统。Hbase Index 会引入额外的外部系统,从而提升运维代价。 |在本文中,我们将介绍一个新的 Hudi 索引模块 Bucket Index 在字节跳动...

Hudi Bucket Index 在字节跳动的设计与实践

**HBase Index** | 维护每一个 Record Key 的 Partition Path 和 File Group,在插入 File Group定位阶段所有 task 向 HBase 发送 Batch Get 请求,获取 Record Key 的 Mapping 信息。 | 重量级,Record Key 到 File... 而 Hudi 表是以 File Group 为单位将数据切割生成 inputSplit 的,单个 File Group 数据过大将导致查询并发降低,性能下降。 **一般说来建议单个桶的大小控制在 3GB 左右** 。* 同时我们也应该避免桶的数量过多,过...

干货|Hudi Bucket Index 在字节跳动的设计与实践

Hbase index 类型,但在字节跳动大规模数据入湖、探索分析等场景中,我们仍然碰到了现有索引类型无法解决的挑战,因此在实践中我们开发了 Bucket Index 的索引方式。## 业务场景挑战字节跳动某业务部门需要利用实... 而 Hudi 表是以 File Group 为单位将数据切割生成 inputSplit 的,单个 File Group 数据过大将导致查询并发降低,性能下降。 **一般说来建议单个桶的大小控制在 3GB 左右。**- 同时我们也应该避免桶的数量过多,过...

万字长文,Spark 架构原理和 RDD 算子详解一网打进! | 社区征文

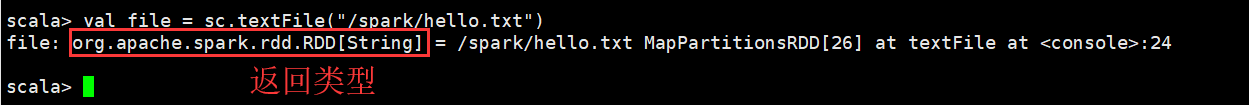

HBase等```cppscala> val file = sc.textFile("/spark/hello.txt")```### 3.2 通过并行化的方式创建RDD由一个已经存在的Scala集合创建。```cppscala> val array = Array(1,2,3,4,5)array: Array[Int] = Array(1, 2, 3, 4, 5)scala> val rdd = sc.parallelize(array)rdd: org.apache.spark.rdd.RDD[Int] = ParallelCollectionRDD[27] at ...

9年演进史:字节跳动 10EB 级大数据存储实战

HBase,日志服务,Kafka 数据存储* Yarn,Flink 的计算框架平台数据* Spark,MapReduce 的计算相关数据存储**02****字节跳动特色的 HDFS 架构**在深入相关的技术细节之前,我... 被卡在某个慢请求的处理上。我们优化的方向会分为读慢节点和写慢节点两个方面。#### **读慢节点优化**我们经历了几个阶段:* 最早,使用社区版本,其 Switch Read 以读取一个 packet 的时长为统计单位,当...