kafka设置连接超时时间

社区干货

社区干货

Kafka 消息传递详细研究及代码实现|社区征文

本文将研究 Kafka 从生产、存储到消费消息的详细过程。 ## Producer### 消息发送所有的 Kafka 服务器节点任何时间都能响应是否可用、是否 topic 中的 partition leader,这样生产者就能发送它的请求到服务器... Kafka Documentation 中 *[Producer Configs](https://kafka.apache.org/documentation/#producerconfigs)* 里有相关配置说明:[**compression.type**](url)生产者生成的数据的压缩类型。通过使用压缩,可以节省...

消息队列选型之 Kafka vs RabbitMQ

对此本文将在接下来的内容中以 Kafka 和 RabbitMQ 为例分享消息队列选型的一些经验。消息队列即 Message+Queue,消息可以说是一个数据传输单位,它包含了创建时间、通道/主题信息、输入参数等全部数据;队列(Queue)... 这种异步通信模式可以减少请求等待,能让服务异步并行处理,提高系统的吞吐量和响应时间。上图以支付会员红包系统交互过程为例,红包 Platform 通过 MQ 通知红包 Consumer 实现异步转账,同时有兜底 Task 查询转账所...

如何排查消费者无法连接到Kafka问题

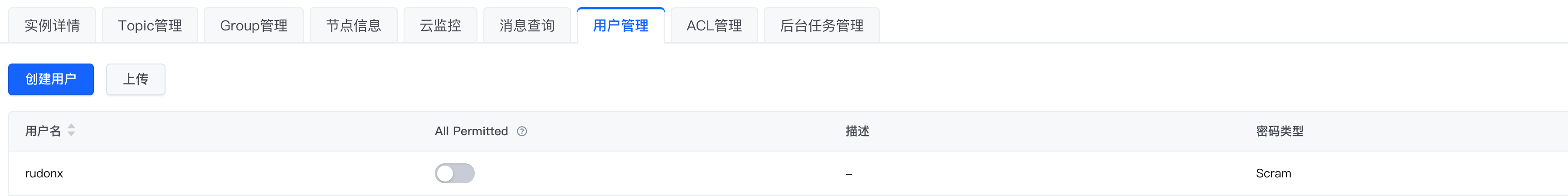

# 问题描述在开发和测试过程中,我们可能会遇到无法连接 Kafka 的情况,本文使用 kafka-console-consumer,来模拟几类常见的连接报错# 环境配置* 密码类型选择 Scram* 使用 SASL_SSL接入点,公网连接,客户端配置文件如下:```Plain Textsasl.jaas.config=org.apache.kafka.common.security.sc...

排查Kafka消息堆积的问题

# 问题描述在使用 Kafka 过程中,发现 Kafka 有消息堆积,我们该如何排查此类问题?# 问题分析通常来说,消费堆积有如下原因:1. 生产速度过快,而消费过慢,从而引起堆积。2. 消费端产生了阻塞下面我们会针对上述... 建议您设置相应的超时时间,同时对消费失败进行处理,从而避免阻塞。**如果您有其他问题,欢迎您联系火山引擎**[技术支持服务](https://console.volcengine.com/ticket/createTicketV2/)

特惠活动

特惠活动

kafka设置连接超时时间-优选内容

kafka设置连接超时时间-优选内容

kafka设置连接超时时间-相关内容

kafka设置连接超时时间-相关内容

Topic 和 Group 管理

为什么消息的存储时间显示为 1970? 为什么消息在 Topic 分区中分布不均衡? 为什么 Group 的订阅关系显示为空? 为什么 Group 列表中多了一些 Group?通过消息队列 Kafka版控制台或 OpenAPI 查看指定实例的 Group 列... 那么也会在 Kafka 集群上创建对应的 Group。 为什么 Group 会被自动删除?消息队列 Kafka版支持自动删除 Group(auto.delete.group) 功能,您可以设置后端服务是否自动删除 Empty 状态的消费组。开启后,如果消费者组...

修改参数配置

再创建的 Topic 默认参数值为实例的参数配置。实际生效的消息保留时长等配置,以各个 Topic 的参数配置为准。 磁盘容量阈值策略设置消息保留时长后,如果实例的磁盘容量充足,过期的消息会被按时自动删除。如果业务在短时间内消息猛增,此时尚未过期的消息快速填满了某个 Broker 或全部实例的磁盘空间,可能造成生产和消费的异常。消息队列 Kafka版在磁盘容量不足时,通过阈值策略管理保证服务的可用性。Kafka 实例支持自定义设置磁盘...

实例管理

消息的保留时间是多久? 支持的 Kafka 版本包括哪些? 如何选择计算规格和存储规格?消息队列 Kafka版提供多种实例规格供您选择,你可以根据业务的读写流量峰值、所需的存储空间大小和分区数量估算计算规格与存储规格... 实际可用存储会小于设置的存储规格,建议预留 25% 左右的存储空间。 分区数量:根据实际的业务需求设置分区数量。每个计算规格提供一定的免费分区额度,您也可以选购更多的分区。 如何选择云盘?创建 Kafka 实例时支...

实例连接

消息队列 Kafka版提供以下实例连接相关的常见问题供您参考。 FAQ 列表是否支持修改 VPC 和子网? 是否支持修改实例的连接地址和端口号? SSL 证书的有效期是多久? 是否支持无密码访问 Kafka 实例? 是否支持跨 VPC 或... Kafka 客户端访问实例时无需下载并手动配置 SSL 证书,旧证书到期时也无需手动替换新证书,所以您无需担心证书过期风险。通过 SASL_SSL 方式收发消息的流程请参考 Java SDK Demo 中提供的SASL_SSL 接入点 PLAIN 机制...

配置 Kafka 数据源

若您还未创建 Kafka 实例,您可前往 Kafka 实例控制台中创建,详见创建实例。 连接串形式接入用连接串形式配置 Kafka 数据源,其中参数名称前带 * 的为必填参数,名称前未带 * 的为可选填参数。 参数 说明 基本配置... 可自行设置,仅支持中文,英文,数字,“_”,100个字符以内。 参数配置 *Kafka 版本 Kafka 版本,下拉可选。当前支持 Kafka 2.2.x 和 0.10 版本。 *Kafka 集群地址 启动客户端连接Kafka服务时使用。填写格式为 ip:...

消息队列选型之 Kafka vs RabbitMQ

对此本文将在接下来的内容中以 Kafka 和 RabbitMQ 为例分享消息队列选型的一些经验。消息队列即 Message+Queue,消息可以说是一个数据传输单位,它包含了创建时间、通道/主题信息、输入参数等全部数据;队列(Queue)... 这种异步通信模式可以减少请求等待,能让服务异步并行处理,提高系统的吞吐量和响应时间。上图以支付会员红包系统交互过程为例,红包 Platform 通过 MQ 通知红包 Consumer 实现异步转账,同时有兜底 Task 查询转账所...

使用默认接入点连接实例

背景信息消息队列 Kafka版提供 PLAINTEXT 协议的普通访问方式,即默认接入点。在 VPC 网络环境下通过默认接入点连接实例时,无需配置用户名及密码,直接访问即可。 前提条件已获取默认接入点信息,包括连接地址和端口... Topic名称 Kafka 实例的 Topic 名称。 消费组名称 自定义的消费组名称。如果您已在配置文件中指定了消费组名称,请确认命令行中配置了相同的名称,否则可能导致消费失败。 成功操作后,消费者可以收到生产者发...

Upsert Kafka

Upsert Kafka 连接器支持以 upsert 方式从 Kafka topic 中读取数据并将数据写入 Kafka topic,支持做数据源表和结果表。 作为源表时,Upsert Kafka 连接器可以将 Kafka 中存储的数据转换为 changelog 流,其中每条数据记录代表一个更新或删除事件。数据记录中有 key,表示 UPDATE;数据记录中没有 key,表示 INSERT;数据记录中 key 的 value 为空,表示 DELETE。 作为结果表时,Upsert Kafka 连接器可以消费上游计算逻辑产生的 changelog...

使用Logstash消费Kafka中的数据并写入到云搜索

Kafka 中的数据,并写入到云搜索服务中。 关于实验 预计部署时间:20分钟级别:初级相关产品:消息队列 - Kafka & 云搜索受众: 通用 环境说明 如果还没有火山引擎账号,点击此链接注册账号 如果您还没有VPC,请先点击链接创建VPC 消息队列 - Kafka 云搜索 云服务器ECS:Centos 7 在 ECS 主机上准备 Kafka 客户端的运行环境,提前安装好Java运行环境 在 ECS 主机上安装 Logstash 实验步骤 步骤一:准备 Logstash 配置文件Logstash 配...