kafka是基于tcp的吗

社区干货

社区干货

Kafka 消息传递详细研究及代码实现|社区征文

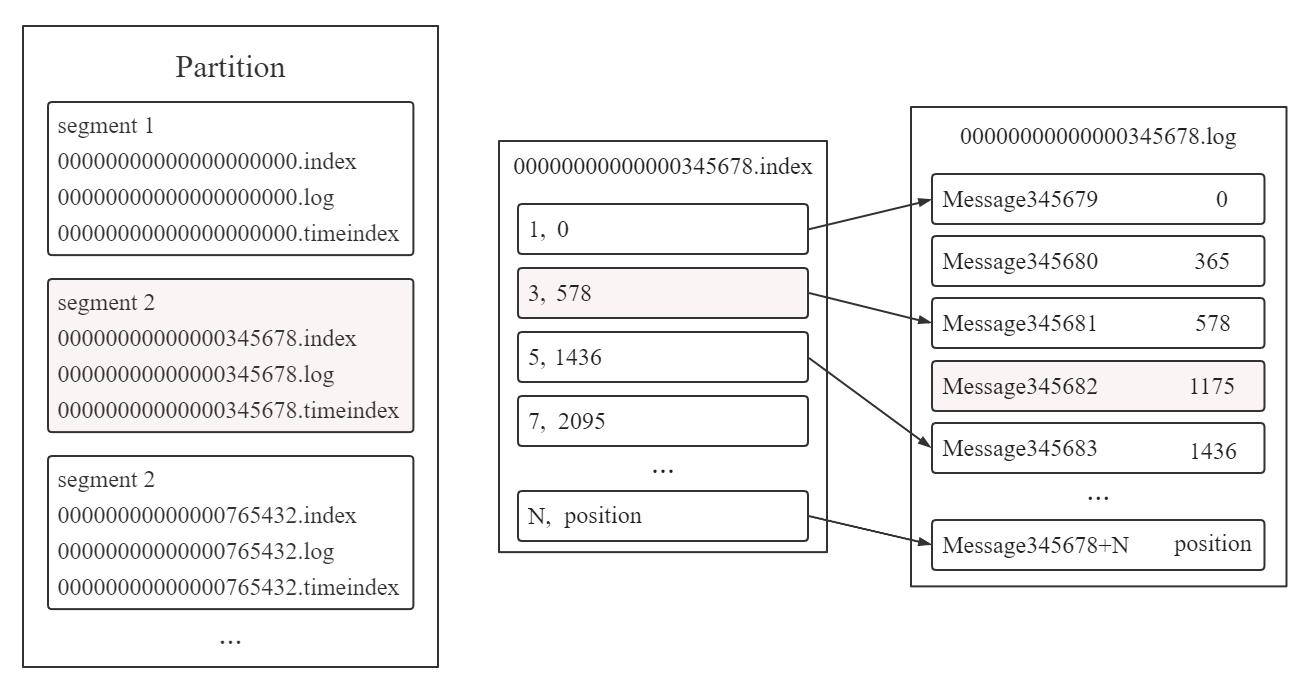

## 背景新项目涉及大数据方面。之前接触微服务较多,趁公司没反应过来,赶紧查漏补缺。Kafka 是其中之一。Apache Kafka 是一个开源的分布式事件流平台,可跨多台计算机读取、写入、存储和处理事件,并有发布和订阅事... 整个查询过程基于二分法,顺序为:(1) 利用二分法找到小于 345682 且离其最近的...

消息队列选型之 Kafka vs RabbitMQ

在面对众多的消息队列时,我们往往会陷入选择的困境:“消息队列那么多,该怎么选啊?Kafka 和 RabbitMQ 比较好用,用哪个更好呢?”想必大家也曾有过类似的疑问。对此本文将在接下来的内容中以 Kafka 和 RabbitMQ 为例分... 功能丰富等方面的卓越表现是分不开的。* **Kafka** 起初是由 LinkedIn 公司采用 Scala 语言开发的一个分布式、多分区、多副本且基于 Zookeeper 协调的分布式消息系统,现已捐献给 Apache 基金会。它是一种高吞吐量...

如何使用iptables实现外网访问VPC内的Kafka

# 问题描述客户想通过外网地址访问 VPC 内的 Kafka 地址进行程序调试,本文展示如果使用iptables转发请求实现外网访问。# 解决方案1.创建一台与 Kafka 同 VPC 的 ECS 服务器,放开安全组 9093 端口同时绑定公网 I... iptables -t nat -A PREROUTING -p tcp -m tcp --dport 9093 -j DNAT --to-destination 192.168.1.254:9093(base) [root@rudonx ~] iptables -t nat -A POSTROUTING -p tcp -m tcp --dport 9093 -j SNAT --to-s...

如何使用iptables实现外网访问VPC内的Kafka

# 问题描述客户想通过外网地址访问 VPC 内的 Kafka 地址进行程序调试,本文展示如果使用iptables转发请求实现外网访问。# 解决方案1.创建一台与 Kafka 同 VPC 的 ECS 服务器,放开安全组 9093 端口同时绑定公网... iptables -t nat -A PREROUTING -p tcp -m tcp --dport 9093 -j DNAT --to-destination 192.168.1.254:9093(base) [root@rudonx ~] iptables -t nat -A POSTROUTING -p tcp -m tcp --dport 9093 -j SNAT --to-s...

特惠活动

特惠活动

kafka是基于tcp的吗-优选内容

kafka是基于tcp的吗-优选内容

kafka是基于tcp的吗-相关内容

kafka是基于tcp的吗-相关内容

如何使用iptables实现外网访问VPC内的Kafka

# 问题描述客户想通过外网地址访问 VPC 内的 Kafka 地址进行程序调试,本文展示如果使用iptables转发请求实现外网访问。# 解决方案1.创建一台与 Kafka 同 VPC 的 ECS 服务器,放开安全组 9093 端口同时绑定公网 I... iptables -t nat -A PREROUTING -p tcp -m tcp --dport 9093 -j DNAT --to-destination 192.168.1.254:9093(base) [root@rudonx ~] iptables -t nat -A POSTROUTING -p tcp -m tcp --dport 9093 -j SNAT --to-s...

如何使用iptables实现外网访问VPC内的Kafka

# 问题描述客户想通过外网地址访问 VPC 内的 Kafka 地址进行程序调试,本文展示如果使用iptables转发请求实现外网访问。# 解决方案1.创建一台与 Kafka 同 VPC 的 ECS 服务器,放开安全组 9093 端口同时绑定公网... iptables -t nat -A PREROUTING -p tcp -m tcp --dport 9093 -j DNAT --to-destination 192.168.1.254:9093(base) [root@rudonx ~] iptables -t nat -A POSTROUTING -p tcp -m tcp --dport 9093 -j SNAT --to-s...

什么是消息队列 Kafka版

消息队列 Kafka版是一款基于 Apache Kafka 构建的分布式消息中间件服务,具备高吞吐、高可扩展性等特性,提供流式数据的发布/订阅和多副本存储机制,广泛应用于日志压缩收集、流式数据处理、消息解耦、流量削峰去谷等应用场景。消息队列 Kafka版开箱即用,业务代码无需改造,帮助您将更多的精力专注于业务快速开发,免除繁琐的部署和运维工作。 产品功能高效的消息收发:海量消息堆积的情况下,消息队列 Kafka版仍然维持Kafka集群对消息收...

Kafka 消费者最佳实践

本文档以 Confluent 官方 Java 版本客户端 SDK 为例,介绍使用火山引擎 Kafka 实例时的消费者最佳实践。 广播与单播在同一个消费组内部,每个消息都预期仅仅只被消费组内的某个消费者消费一次,因而使用同一个消费组的... 消费者的所有请求发送和响应几乎都基于消费者poll方法的调用。若客户端使用订阅(Subscribe)的方式进行消费,那么在使用过程中,需要保证poll方法在固定的周期内进行调用,最长不能超过max.poll.interval.ms的配置,默认...

Kafka 生产者最佳实践

消息顺序性火山引擎 Kafka 实例的消息在同一分区中可以保证数据的先入先出。即写入同一分区的消息,若消息 A 先于消息 B 写入,那么在进行消息读取时,消息A也一定可以先于消息 B 被客户端读到。需要注意的是此处仅保证通过同一生产者先后发送的消息可以保证有序,不同生产者之间的消息因为无法确认到达服务端的先后顺序,所以无法保证有序。基于以上特性,若要实现消息顺序性的能力,可以考虑以下方式: **全局有序:**创建仅 1 分区的 ...

使用 Kafka 协议上传日志

即可以使用 Kafka Producer SDK 来采集日志数据,并通过 Kafka 协议上传到日志服务。本文介绍通过 Kafka 协议将日志上传到日志服务的操作步骤。 背景信息Kafka 作为高吞吐量的消息中间件,在多种自建场景的日志采集方案中被用于消息管道。例如在日志源服务器中的开源采集工具采集日志,或通过 Producer 直接写入日志数据,再通过消费管道供下游应用进行消费。日志服务支持通过 Kafka 协议上传和消费日志数据,基于 Kafka 数据管道提供...

Kafka订阅埋点数据(私有化)

本文档介绍了在增长分析(DataFinder)产品私有化部署场景下,开发同学如何访问Kafka Topic中的流数据,以便进一步进行数据分析和应用,比如实时推荐等。 1. 准备工作 kafka消费只支持内网环境消费,在开始之前,需要提前准备好如下输入: Kafka 0.10.1版本及以上的客户端(脚本或JAR包) zookeeper链接:可联系运维获取 broker链接:可联系运维获取 topic名称:下方给出了两个topic数据格式,确认需要消费哪一个topic; ConsumerGroup:确认好Co...

Kafka订阅埋点数据(私有化)

本文档介绍了在增长分析(DataFinder)产品私有化部署场景下,开发同学如何访问Kafka Topic中的流数据,以便进一步进行数据分析和应用,比如实时推荐等。 1. 准备工作 kafka消费只支持内网环境消费,在开始之前,需要提前准备好如下输入: Kafka 0.10.1版本及以上的客户端(脚本或JAR包) zookeeper链接:可联系运维获取 broker链接:可联系运维获取 topic名称:下方给出了两个topic数据格式,确认需要消费哪一个topic; ConsumerGroup:确认好Co...

Kafka订阅埋点数据(私有化)

本文档介绍了在增长分析(DataFinder)产品私有化部署场景下,开发同学如何访问Kafka Topic中的流数据,以便进一步进行数据分析和应用,比如实时推荐等。 1. 准备工作 kafka消费只支持内网环境消费,在开始之前,需要提前准备好如下输入: Kafka 0.10.1版本及以上的客户端(脚本或JAR包) zookeeper链接:可联系运维获取 broker链接:可联系运维获取 topic名称:下方给出了两个topic数据格式,确认需要消费哪一个topic; ConsumerGroup:确认好C...