kafka的send方法乱码

社区干货

社区干货

Kafka 消息传递详细研究及代码实现|社区征文

这种方式是对请求传递的最有效保证。acks = -1 与 acks = all 等效type: stringdefault: allvalid values: [all, -1, 0, 1]importance: low Java 实现 Kafka 消息发送分为直接、同步、异步发送。其中直接发送无回调,同步发送有阻塞,故生产环境多用异步发送。```Properties properties = new Properties();// 建立与 Kafka 群集的初始连接的主机/端口对的列表 多个以逗号隔开properties.put(ProducerConfig.BOOT...

聊聊 Kafka:Topic 创建流程与源码分析 | 社区征文

kafka 带命名空间的这种,则不要漏掉了。### 2.2 Kafka 版本 >= 2.2 支持下面的方式(推荐)```./bin/kafka-topics.sh --create --bootstrap-server localhost:9092 --partitions 3 --replication-factor 3 --topic topic_test```### 2.3 Broker 参数 auto.create.topics.enable 创建(不推荐)Server 端如果 `auto.create.topics.enable` 设置为 true 时,那么当 Producer 向一个不存在的 topic 发送数据时,该 topic 同样会...

如何使用 SASL_SSL 公网连接消息队列Kafka版

Kafka 进行生产和消费。# 问题分析在公网环境下,消息队列 Kafka 版要求通过 SSL 证书对消息进行鉴权和加密,保障数据传输过程的安全性,防止数据在网络传输过程中被截取或者窃听,相较于普通公网访问方式具备更高的... data = bytes("hello kafka!", encoding="utf-8")producer.send(conf['topic_name'], data)producer.close()print('end producer')```**如果您有其他问题,欢迎您联系火山引擎**[技术支持服务](https://conso...

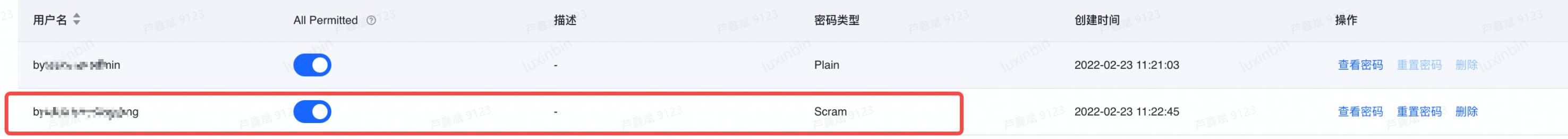

如何使用Scram类型密码连接消息队列Kafka

# 问题描述 客户在前端创建Scram类型密码,代码中无法连接到Kafka  # 问题分析 客户代... producer.send(topic, json.dumps(dic).encode()) print("send:" + json.dumps(dic)) time.sleep(0.5) except KafkaError as e: print(e) finally: ...

特惠活动

特惠活动

kafka的send方法乱码-优选内容

kafka的send方法乱码-优选内容

kafka的send方法乱码-相关内容

kafka的send方法乱码-相关内容

创建 TOS Sink Connector 任务

本文档介绍创建 TOS Sink Connector 任务的操作步骤,成功创建任务后,Kafka Topic 中的消息将根据指定的聚合规则同步到对象存储 TOS 的存储桶中。 前提条件已创建消息队列 Kafka版实例,且实例状态为运行中。 已为指... 方式包括以下两种,可同时设置。 每 1~24 小时聚合一次。 每 10~5000MiB 聚合一次。创建 TOS Sink Connector 任务后,消息队列 Kafka版会根据指定的聚合方式,分别打包指定 Kafka Topic 中每个分区的数据,并发送至指定...

如何使用 SASL_SSL 公网连接消息队列Kafka版

Kafka 进行生产和消费。# 问题分析在公网环境下,消息队列 Kafka 版要求通过 SSL 证书对消息进行鉴权和加密,保障数据传输过程的安全性,防止数据在网络传输过程中被截取或者窃听,相较于普通公网访问方式具备更高的... data = bytes("hello kafka!", encoding="utf-8")producer.send(conf['topic_name'], data)producer.close()print('end producer')```**如果您有其他问题,欢迎您联系火山引擎**[技术支持服务](https://conso...

开发指南

//发送消息条数int count = 100;Properties properties = new Properties();properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, server);properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class);properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class);KafkaProducer producer = new KafkaProducer<>(properties);try { for (int i = 0; i (topic, val...

默认接入点收发消息

1 添加配置文件创建消息队列 Kafka版配置文件 config.json。配置文件字段的详细说明,请参考配置文件。使用默认接入点时,配置文件示例如下。 说明 请根据注释提示填写相关参数,并删除注释。 json { "bootstrap.servers": "xxxxx", // 修改配置为实例的默认接入点 "topic": "xxxx", // 修改配置为待发送的 topic 名称 "consumer": { "group.id": "xxxx" // 修改为指定消费组的名称 }} 2 发送消息 实现方法创建消息发送程序...

默认接入点收发消息

2 发送消息 实现方法创建消息发送程序 producer.py。 编译并运行 producer.py 发送消息。 查看运行结果。运行结果示例如下。 说明 消息队列 Kafka版提供示例项目供您快速接入,下载并解压缩 Demo 后,可以直接执行以下命令发送并消费消息。 Python python3 {DemoPath}/bytedance_kafka.py 示例代码通过默认接入点生产消息的示例代码如下,您也可以参考 Demo 中的示例文件 {DemoPath}/client/producer.py,实现相关业务逻辑。 Pytho...

默认接入点收发消息

properties = kafkaProperties; return kafkaProperties; }} 3 发送消息 实现方法创建发送消息程序 ProducerDemo.java。 编译并运行 ProducerDemo.java 发送消息。 查看运行结果。运行结果示... kafkaProperties.getProperty("bootstrap.servers")); //Kafka消息的序列化方式 props.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringSerialize...

如何使用Nginx代理访问VPC内的自建Kafka

前言 对于一些自建在VPC内的Kafka有暴露到外网的需求,那么我们就可以通过Nginx代理来做四层代理,转发请求。 关于实验 预计部署时间:30分钟级别:初级相关产品:同VPC内的ECS两台(1台做Nginx代理,1台做Kafka Server)受... kafka import KafkaProducerfrom kafka import KafkaConsumerdef test(): producer = KafkaProducer(bootstrap_servers=['180.184.70.*:9092']) msg='demomessage' future = producer.send('my_topic' , ...

默认接入点收发消息

方法创建消息发送程序 producer.cpp。 执行以下命令编译 producer.cpp。 Bash gcc -lrdkafka ./producer.cpp -o producer 执行以下命令发送消息。从命令行接收消息并发送至 Kafka。 Shell ./producer -b -t 查看运行结果。运行结果示例如下。 说明 消息队列 Kafka版提供示例项目供您快速接入,下载并解压缩 Demo 后,可以直接执行以下命令发送并消费消息。 Shell ./producer -b -t 示例代码通过默认接入点生产消息的示例代码如下,...

Python SDK

('kafka')logger.addHandler(logging.StreamHandler(sys.stdout))logger.setLevel(logging.DEBUG) 发送消息创建并编写producer.py发送消息。 PLAINTEXTPython from kafka import KafkaProducerproducer = KafkaPro... result = producer.send('your topic', b'some_message_bytes').get() print("send message: partition " + str(result.partition) + " offset " + str(result.offset)) SASL_PLAINTEXT通过 SASL 用户名和...