T-SQL:CREATEFUNCTIONmustbetheonlystatementinbatch

社区干货

社区干货

ApacheCon - 云原生大数据上的 Apache 项目实践

Flink SQL 技术负责人Apache Calcite PMC Member,Apache Flink Committer,毕业于北京大学,目前就职于字节跳动流式计算团队,Flink SQL 技术负责人。 ## 专题演讲### 专题:数据湖与数据仓库#### 基于 Fl... 需要额外的 Pipeline 工具管理串行运行的 Job,希望迁移 Spark 但是存量作业数量多且大量作业使用了 Spark 本身不支持的各种脚本。在此背景下,字节跳动 Batch 团队设计并实现了一套 MapReduce 任务平滑迁移 Spark 的...

干货 | BitSail Connector 开发详解系列一:Source

(ExecutionEnviron execution, BitSailConfiguration readerConfiguration) throws IOException; /** * Indicate the Source type. */ Boundedness getSourceBoundedness(); /** * Create Source... =&rk3s=8031ce6d&x-expires=1714926094&x-signature=nmczwaB53nNhPrL4hXmRmetcvQs%3D)##### 流批一体场景示例```@Overridepublic Boundedness getSourceBoundedness() { return Mode.BATCH.equals(Mode.ge...

干货|字节跳动基于Flink SQL的流式数据质量监控

上线了一系列基于Flink StreamSQL的流式数据质量监控。本文为系列文章的上篇,重点介绍字节跳动数据质量平台技术调研及选型的思考。## 产品调研在2020年下半年,我们决定支持流式数据的质量监控,随即开展了业内... Flink | Spark | Spark + deequ + delta lake || **主要技术实现** | 将流转为batch,基于batch数据做计算。 | Flink中两个窗口聚合。 | Spark收集审计数据,发到审计中心。...

计算引擎在K8S上的实践|社区征文

spark.executor.heartbeatInterval=30s - --hiveconf - javax.jdo.option.ConnectionURL=jdbc:mysql://ip:4306/metastore?createDatabaseIfNotExist=true&useSSL=false ... hive.server2.authentication=NOSASL - --hiveconf - hive.metastore.sasl.enabled=false```还有许多其他参数可以使用--conf来添加,这里只是一个简单的版本。## 创建对...

特惠活动

特惠活动

T-SQL:CREATEFUNCTIONmustbetheonlystatementinbatch

-优选内容

T-SQL:CREATEFUNCTIONmustbetheonlystatementinbatch

-优选内容

T-SQL:CREATEFUNCTIONmustbetheonlystatementinbatch

-相关内容

T-SQL:CREATEFUNCTIONmustbetheonlystatementinbatch

-相关内容

干货|字节跳动基于Flink SQL的流式数据质量监控

上线了一系列基于Flink StreamSQL的流式数据质量监控。本文为系列文章的上篇,重点介绍字节跳动数据质量平台技术调研及选型的思考。## 产品调研在2020年下半年,我们决定支持流式数据的质量监控,随即开展了业内... Flink | Spark | Spark + deequ + delta lake || **主要技术实现** | 将流转为batch,基于batch数据做计算。 | Flink中两个窗口聚合。 | Spark收集审计数据,发到审计中心。...

计算引擎在K8S上的实践|社区征文

spark.executor.heartbeatInterval=30s - --hiveconf - javax.jdo.option.ConnectionURL=jdbc:mysql://ip:4306/metastore?createDatabaseIfNotExist=true&useSSL=false ... hive.server2.authentication=NOSASL - --hiveconf - hive.metastore.sasl.enabled=false```还有许多其他参数可以使用--conf来添加,这里只是一个简单的版本。## 创建对...

干货 | 在字节跳动,一个更好的企业级SparkSQL Server这么做

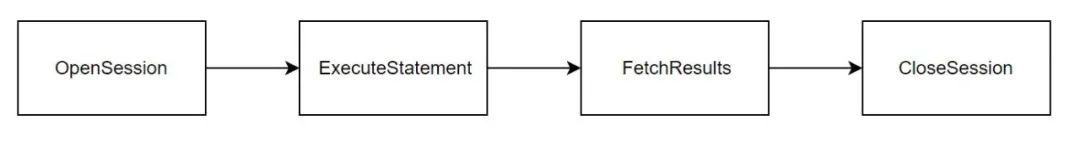

logs = hiveStatement.getQueryLog();```对于Log的获取获取也是调用FetchResult接口,通过不同的参数来区分是获取Log信息还是获取内容信息,所以Hive JDBC背后封装的调用Hive Server2的RPC接口的的流程是:如果该流程触发获取MetaData、获取Functions等操作,则会调用其他接口,其中身份信息即tok...

统计信息和执行计划

ByteHouse 提供展示物理执行计划能力,用 Explain + Query 的方式对执行进行分析,便于更加直观地对查询进行分析和优化,并配合 Query Profiler 查询详情进行可视化展示。 注:当前需要先手动收集统计信息后,再生成执行计划 生成物理执行计划: SQL EXPLAIN (QUERY Statement) ;注:当前 EXPLAIN 语义仅支持 DQL SELECT 语法的分析。 使用示例创建数据库表 SQL CREATE DATABASE sampledb;CREATE TABLE sampledb.t1 ( id Int64, name ...

Flink SQL Client 使用参考

显示如何集成 Hive Connector。 启动 SQL 客户端命令行界面 bash ./bin/yarn-session.sh -d./bin/sql-client.sh embedded -s yarn-session -j connectors/flink-sql-connector-hive-3.1.2_2.12-1.16.1.jar创建 Hive Catalog 以及 Demo 数据库 bash Flink SQL> CREATE CATALOG hive WITH (> 'type' = 'hive',> 'hive-conf-dir' = '/etc/emr/hive/conf'> );[INFO] Execute statement succeed.Flink SQL> use catalog hive;[INF...

达梦@记一次国产数据库适配思考过程|社区征文

若是通过**DM8工具去建表建字段或者带小写加双引号创建脚本**,出现双引号则在实际的sql方言中也需要加上双引号,否则执行sql会抛出视图或表不存在,字段列名不存在的异常。 DriverManager.getConnection(url,username,password);// 获取数据库操作对象PreparedStatement ps = con.prepareStatement("SELECT COUNT(*) FROM TEST;");// 执行sqlResultSe...

干货 | 在字节跳动,一个更好的企业级SparkSQL Server这么做

("com.mysql.cj.jdbc.Driver"); Connection connection= DriverManager.getConnection(DB_URL,USER,PASS); //操作 connection.close(); ```第一,初始化驱动、创建连接... throws org.apache.thrift.TException; public TGetInfoResp GetInfo(TGetInfoReq req) throws org.apache.thrift.TException; public TExecuteStatementResp Exe...

行存表使用指南

1 语法说明1.1 DDL语法建表语句 sql CREATE TABLE [IF NOT EXISTS] [database.]table_name(column_definition1[, column_definition2, ...])ENGINE = ROW_STOREPRIMARY KEY(column1[, column2]);行存建表语句和普通... 列存表的相关语法参考StarRocks社区。 1.点查询 对于行存表,使用全主键进行查询时,会走短路径对SQL进行优化。示例 sql -- 创建表CREATE DATABASE IF NOT EXISTS demo;DROP TABLE IF EXISTS demo.t1;CREATE TABLE I...

DescribeApplicationInstance

可能的取值如下: SPARK_BATCH_JAR:当是 Spark Scala 任务时,同样是这个类型 SPARK_BATCH_SQL SPARK_BATCH_PYTHON Image string 192.168..:30004/open_platform/streamx:888 用户自定义镜像。 RestUrl string /ui/s-166209-driver-svc.doc-spark-pool-q0xt-00**5:4040/jobs 任务相对路径。 ProjectId string w4***rd65 任务所属项目的 ID。 UserId string 6e224069****cc1517306a 任务创建者的 ID。 EngineVersi...