Kafka中的状态存储是否可以在多个流之间共享?

社区干货

社区干货

Kafka@记一次修复Kafka分区所在broker宕机故障引发当前分区不可用思考过程 | 社区征文

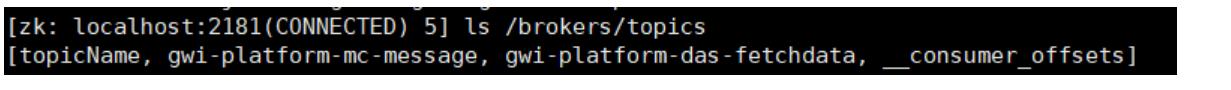

怀疑是Kafka某个节点有问题-失联-假死?## 思考过程从这个表象来看,某台机器有过宕机事件,宕机原因因环境而异,但Kafka的高可用性HA我们是耳熟能详的,为啥我们搭建的Kafka集群由多个节点组成,但其中某个节点宕掉... 查看到了Zookeeper中存储了brokers信息,输入 ls /brokers/ids,查看到ids [0],...

Kafka 消息传递详细研究及代码实现|社区征文

存储和处理事件,并有发布和订阅事件流的特性。本文将研究 Kafka 从生产、存储到消费消息的详细过程。 ## Producer### 消息发送所有的 Kafka 服务器节点任何时间都能响应是否可用、是否 topic 中的 partit... 其中直接发送无回调,同步发送有阻塞,故生产环境多用异步发送。```Properties properties = new Properties();// 建立与 Kafka 群集的初始连接的主机/端口对的列表 多个以逗号隔开properties.put(Producer...

聊聊 Kafka:Topic 创建流程与源码分析 | 社区征文

事件就是该文件夹中的文件。Kafka 中的主题总是多生产者和多订阅者:一个主题可以有零个、一个或多个向其写入事件的生产者,以及零个、一个或多个订阅这些事件的消费者。可以根据需要随时读取主题中的事件——与传统消息传递系统不同,事件在消费后不会被删除。相反,您可以通过每个主题的配置设置来定义 Kafka 应该保留您的事件多长时间,之后旧事件将被丢弃。Kafka 的性能在数据大小方面实际上是恒定的,因此长时间存储数据是完全没问...

消息队列选型之 Kafka vs RabbitMQ

对此本文将在接下来的内容中以 Kafka 和 RabbitMQ 为例分享消息队列选型的一些经验。消息队列即 Message+Queue,消息可以说是一个数据传输单位,它包含了创建时间、通道/主题信息、输入参数等全部数据;队列(Queue)... 可以使整个系统更加灵活和可扩展。 **削峰**最重要的优势就是能用来平滑处理系统中的高峰流量。当系统面临瞬时高流量时,消息队列可以作为一个缓冲层,将大量的请求消息存储在队列中,然后按照系统处...

特惠活动

特惠活动

Kafka中的状态存储是否可以在多个流之间共享?

-优选内容

Kafka中的状态存储是否可以在多个流之间共享?

-优选内容

Kafka中的状态存储是否可以在多个流之间共享?

-相关内容

Kafka中的状态存储是否可以在多个流之间共享?

-相关内容

Upsert Kafka

Upsert Kafka 连接器支持以 upsert 方式从 Kafka topic 中读取数据并将数据写入 Kafka topic,支持做数据源表和结果表。 作为源表时,Upsert Kafka 连接器可以将 Kafka 中存储的数据转换为 changelog 流,其中每条数据... String 读取或写入 Kafka 消息 key 部分时使用的序列化和反序列化的格式,支持csv、json、avro。 key.fields 否 (none) String Kafka 消息 key 部分对应的源表或结果表字段。多个字段名以分号(;)分隔。例如...

什么是消息队列 Kafka版

消息队列 Kafka版是一款基于 Apache Kafka 构建的分布式消息中间件服务,具备高吞吐、高可扩展性等特性,提供流式数据的发布/订阅和多副本存储机制,广泛应用于日志压缩收集、流式数据处理、消息解耦、流量削峰去谷等应用场景。消息队列 Kafka版开箱即用,业务代码无需改造,帮助您将更多的精力专注于业务快速开发,免除繁琐的部署和运维工作。 产品功能高效的消息收发:海量消息堆积的情况下,消息队列 Kafka版仍然维持Kafka集群对消息收...

消息队列选型之 Kafka vs RabbitMQ

对此本文将在接下来的内容中以 Kafka 和 RabbitMQ 为例分享消息队列选型的一些经验。消息队列即 Message+Queue,消息可以说是一个数据传输单位,它包含了创建时间、通道/主题信息、输入参数等全部数据;队列(Queue)... 可以使整个系统更加灵活和可扩展。 **削峰**最重要的优势就是能用来平滑处理系统中的高峰流量。当系统面临瞬时高流量时,消息队列可以作为一个缓冲层,将大量的请求消息存储在队列中,然后按照系统处...

CreateInstance

如果需要通过公网访问消息队列 Kafka版实例,请先申请同地域的 EIP,详细操作步骤请参考申请公网 IP。 默认情况下,您可以在每个地域中创建 8 个 Kafka 实例,每个账号在每个地域中的所有实例存储容量总和最大为 90Ti... 消息队列 Kafka版实例支持跨AZ部署,查看指定可用区下提供哪些计算规格时,可以指定多个可用区。多个可用区ID之间以逗号(,)间隔。您可以调用 DescribeAvailabilityZones 查询当前提供服务的可用区列表。 Version S...

Kafka订阅埋点数据(私有化)

中的流数据,以便进一步进行数据分析和应用,比如实时推荐等。 1. 准备工作 kafka消费只支持内网环境消费,在开始之前,需要提前准备好如下输入: Kafka 0.10.1版本及以上的客户端(脚本或JAR包) zookeeper链接:可联系运维获取 broker链接:可联系运维获取 topic名称:下方给出了两个topic数据格式,确认需要消费哪一个topic; ConsumerGroup:确认好ConsumerGroup,以免冲突,导致数据消费异常; 确认需要消费的app_id:Topic中存在多个app_id,...

Kafka订阅埋点数据(私有化)

中的流数据,以便进一步进行数据分析和应用,比如实时推荐等。 1. 准备工作 kafka消费只支持内网环境消费,在开始之前,需要提前准备好如下输入: Kafka 0.10.1版本及以上的客户端(脚本或JAR包) zookeeper链接:可联系运维获取 broker链接:可联系运维获取 topic名称:下方给出了两个topic数据格式,确认需要消费哪一个topic; ConsumerGroup:确认好ConsumerGroup,以免冲突,导致数据消费异常; 确认需要消费的app_id:Topic中存在多个app_id,...

Kafka订阅埋点数据(私有化)

中的流数据,以便进一步进行数据分析和应用,比如实时推荐等。 1. 准备工作 kafka消费只支持内网环境消费,在开始之前,需要提前准备好如下输入: Kafka 0.10.1版本及以上的客户端(脚本或JAR包) zookeeper链接:可联系运维获取 broker链接:可联系运维获取 topic名称:下方给出了两个topic数据格式,确认需要消费哪一个topic; ConsumerGroup:确认好ConsumerGroup,以免冲突,导致数据消费异常; 确认需要消费的app_id:Topic中存在多个app_id...

Kafka 集群数据均衡

Kakfa 实例均为集群化部属,每个 Kakfa 实例由多个 Broker 组成。本文档介绍如何保障 Kafka 集群各个 Broker 之间的数据均衡。 数据均衡每个 Kakfa 实例由多个 Broker 组成。不同 Broker 之间的数据流量、磁盘占用率... 多个分区,每个分区都是一个有序的队列,分区数量影响 Topic 承载业务流量的能力。创建 Topic 时需要指定分区数量,Kafka 实例会将分区尽可能均衡地划分给各个 Broker,每个 Broker 均负责集群中部分数据的处理和存储。...

Kafka 迁移上云(方案一)

您可以访问 Kafka 实例详情页中的接入点,确认实例的网络连通性。 业务迁移之前,请确认您已根据业务需求选择了正确的迁移方案。迁移方案对比请参考概述。 1 环境准备迁移之前,您需要根据业务量合理评估资源需求,并创建 Kafka 实例及相关的依赖资源。 1.1 迁移评估根据现有业务量和消息量估算所需的消息队列 Kafka版资源,例如业务读写流量峰值、磁盘容量和分区数等。不同规格的 Kafka 实例代表不同的计算能力及存储空间,请根据业务...