多个Cuda文件

社区干货

社区干货

Linux安装CUDA

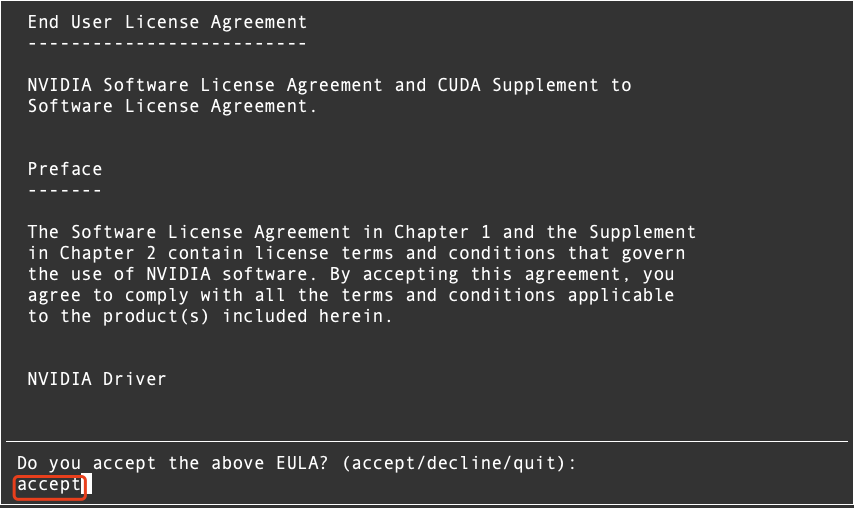

# 运行环境* CentOS* RHEL* Ubuntu* OpenSUSE# 问题描述初始创建的火山引擎实例并没有安装相关cuda软件,需要手动安装。# 解决方案1. 确认驱动版本,以及与驱动匹配的cuda版本,执行命令`nvidia-smi`显示如... cuda_11.0.2_450.51.05_linux.run`稍等片刻,输入 accept 回车确认。7. 由于CUDA安装文件里面...

火山引擎部署ChatGLM-6B实战指导

火山引擎默认提供的GPU驱动版本为CUDA11.3,如果需要升级版本的话可以参考后面的步骤,配置GPU服务器。 特惠活动

特惠活动

多个Cuda文件-优选内容

多个Cuda文件-优选内容

多个Cuda文件-相关内容

多个Cuda文件-相关内容

卸载NVIDIA Tesla驱动

卸载NVIDIA Tesla驱动(Linux)注意事项卸载GPU驱动需要root账号操作权限,如果您是普通用户,请使用sudo命令获取root权限后再操作,本文以root登录系统操作为例。 卸载不同CUDA版本的命令可能不同,若不存在cuda-uninstaller文件, 请进入“/usr/local/cuda/bin/”目录查看是否存在uninstall_cuda开头的文件。若有,请将命令中的cuda-uninstaller替换为uninstall_cuda开头的文件名。 卸载run包方式安装的NVIDIA驱动登录Linux实例。 执...

GPU实例部署paddlepaddle-gpu环境

本文介绍 GPU 实例部署深度学习Paddle环境。 前言 在ECS GPU实例上部署深度学习Paddle环境。 关于实验 预计实验时间:20分钟级别:初级相关产品:ECS受众: 通用 环境说明 本文测试规格如下:实例规格:ecs.pni2.3xlargeGPU 类型:Tesla A100 80G显存容量:81920MiB实例镜像:velinux - 1.0 with GPU DriverNVIDIA-SMI:470.57.02NVIDIA Driver version:470.57.02CUDA version:11.4CUDA Toolkit version:11.2Python version:Python 3.7.3pa...

火山引擎部署ChatGLM-6B实战指导

火山引擎默认提供的GPU驱动版本为CUDA11.3,如果需要升级版本的话可以参考后面的步骤,配置GPU服务器。 2024-01-31 自定义 GPU 驱动安装说明 华...

提交文件预热任务

调用本接口提交文件预热任务到云服务商平台。 使用说明每个请求中必须包含鉴权信息。该鉴权信息用以验证请求者的身份。参见签名机制。 使用限制节流限制:您每秒最多可以提交 50 个 API 请求。 云服务商平台接口限制... Body参数名称数据类型是否必选参数说明示例UrlsString是设置一个或者多个需要预热的 URL。多个 URL 以\n分隔。最多可以输入 100 个 URL。URL 必须以http://或https://开头。URL 中的域名必须是某个已同步到多云CDN...

通过工作流串联训练与评测任务

概述 机器学习平台工作流模块支持用户编排多个自定义任务。用户可以使用工作流串联模型训练与模型评估任务,并为每个任务提供不同的计算规格,在一次工作流任务中灵活完成训练与评估任务。本文介绍一个简单的训练+评估工作流demo。该工作流使用PytorchDDP框架拉起一个多机GPU训练任务,并在训练结束将模型文件存储到TOS。然后拉起一个单机CPU任务,读取训练好的模型文件,在测试数据集上进行模型效果的评估。 开发训练与评估代码 假设...