hbasecore个数

社区干货

社区干货

9年演进史:字节跳动 10EB 级大数据存储实战

HBase,日志服务,Kafka 数据存储 - Yarn,Flink 的计算框架平台数据 - Spark,MapReduce 的计算相关数据存储![]()# **字节跳动特色的** **HDFS** **架构**在深入相关的技术细节之前,我们先看看字节跳动的 H... 当 Buffer 中的元素个数达到设定的数量以后,重新生成一个新的 Buffer 接收请求,并在老 Buffer 上起一个线程将数据填入 BlockMap。#### **接收块上报优化**DanceNN 启动以后会首先进入安全模式,接收所有 Date N...

万字长文,Spark 架构原理和 RDD 算子详解一网打进! | 社区征文

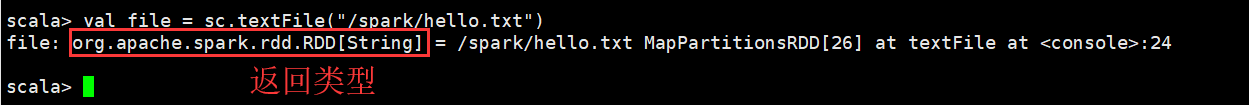

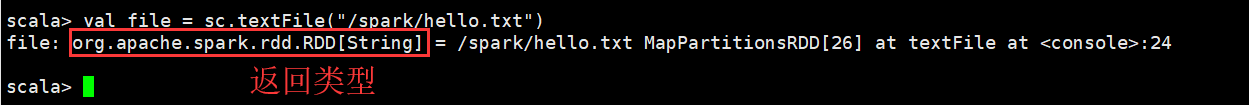

用户可以在创建RDD时指定RDD的分片个数,如果没有指定,那么就会采用默认值。默认值就是程序所分配到的CPU Core的数目。(2)一个计算每个分区的函数。Spark中RDD的计算是以分片为单位的,每个RDD都会实现compute函数... HBase等```cppscala> val file = sc.textFile("/spark/hello.txt")```### 3.2 通过并行化的方式创建RDD由一个已经存在的Scala集...

数据库顶会 VLDB 2023 论文解读 - Krypton: 字节跳动实时服务分析 SQL 引擎设

结果通过 ETL 导入到 HBase/ES/ClickHouse 等系统提供在线的查询服务。对于实时链路, 数据会直接进入到 HBase/ES 提供高并发低时延的在线查询服务,另一方面数据会流入到 ClickHouse/Druid 提供在线的查询聚合服务。... 每一个 Core 都绑定了一个 Task Group,它管理了所有分配给它的 Tasks, 这里每个 Task 对应一个 Coro-thread,在执行期间,Task 被提交到 Local Task Queue 中等待执行,在一段时间 t 之后,没有完成的 Local Task 会被...

数据库顶会 VLDB 2023 论文解读:Krypton: 字节跳动实时服务分析 SQL 引擎设计

结果通过 ETL 导入到 HBase/ES/ClickHouse 等系统提供在线的查询服务。对于实时链路, 数据会直接进入到 HBase/ES 提供高并发低时延的在线查询服务,另一方面数据会流入到 ClickHouse/Druid 提供在线的查询聚合服务。... 每一个 Core 都绑定了一个 Task Group,它管理了所有分配给它的 Tasks, 这里每个 Task 对应一个 Coro-thread,在执行期间,Task 被提交到 Local Task Queue 中等待执行,在一段时间 t 之后,没有完成的 Local Task 会被...

特惠活动

特惠活动

hbasecore个数-优选内容

hbasecore个数-优选内容

hbasecore个数-相关内容

hbasecore个数-相关内容

DescribeDBInstanceDetail

调用 DescribeDBInstanceDetail 接口查询指定实例的详细信息。 请求类型同步请求。 请求参数名称 类型 是否必选 示例值 描述 InstanceId String 是 hb-cn019f341d51**** 实例 ID。 说明 您可以调用 DescribeDBInstances 接口查询目标地域下所有 HBase 实例的基本信息,包括实例 ID。 返回数据名称 类型 示例值 描述 ChargeType String PostPaid 计费类型,取值: PostPaid:按量计费(后付费)。 PrePaid:包年包月(预付费)。 ...

ModifyRSNodeCount

个数。 请求类型异步请求。 注意事项缩减节点数量过程中,实例可能会出现 1~3 分钟的断连。请谨慎操作。建议在业务低峰期执行变配操作,并确保客户端配置了正确的重试机制。更多详情,请参见变更实例配置。 请求参数名称 类型 是否必选 示例值 描述 InstanceId String 是 hb-bbf19cb0**** 实例 ID。 说明 您可以调用 DescribeDBInstances 接口查询目标地域下所有 HBase 实例的基本信息,包括实例 ID。 RSCount Integer 是 3 Re...

9年演进史:字节跳动 10EB 级大数据存储实战

HBase,日志服务,Kafka 数据存储 - Yarn,Flink 的计算框架平台数据 - Spark,MapReduce 的计算相关数据存储![]()# **字节跳动特色的** **HDFS** **架构**在深入相关的技术细节之前,我们先看看字节跳动的 H... 当 Buffer 中的元素个数达到设定的数量以后,重新生成一个新的 Buffer 接收请求,并在老 Buffer 上起一个线程将数据填入 BlockMap。#### **接收块上报优化**DanceNN 启动以后会首先进入安全模式,接收所有 Date N...

功能发布记录

Core或者Task节点组,实现计算节点和调度节点混合部署。 EMR软件栈更新 软件栈版本 功能描述 相关文档 发布地域 软件栈EMR-V3.10.0 新增功能【组件】Spark中提供Native引擎功能,是一款自研的湖仓分析加速C++引擎,使用向量化计算、Codegen等加速技术等。 更改、增强和解决的问题【组件】Proton组件由1.8.0版本升级到1.8.4,优化访问TOS时的吞吐与请求次数、以及小文件写等场景,参考:Proton 发行版本。 【组件】HBase组件由2.3.7升...

基础使用

HBase或任何提供Hadoop InputFormat的数据集。 2.1 创建RDD示例:通过集合来创建RDD val data = Array(1, 2, 3, 4, 5)val distData = sc.parallelize(data)通过外部数据集构建RDD val distFile = sc.textFile("data... count() 返回RDD中的元素个数。 countByValue() 返回各元素在RDD中出现的次数。 reduce() 并行整合所有RDD数据,例如求和操作。 fold(0)(func) 和reduce()功能一样,但是fold带有初始值。 aggregate(0)(seqOp,combo...

最佳实践

1 控制小文件个数背景:HDFS NameNode 将所有文件元数据加载在内存中,在集群磁盘容量一定的情况下,如果小文件个数过多,则会造成 NameNode 的内存容量瓶颈。 建议:尽量控制小文件的个数。对于存量的小文件,建议合并... 单击core-site页签,然后单击添加自定义参数,新增参数fs.protected.directories,参数值为您待保护的目录,多个目录时使用逗号(,)分隔,并保存配置。 7 使用Balancer进行容量均衡背景:HDFS集群可能出现DataNode节点间...

万字长文,Spark 架构原理和 RDD 算子详解一网打进! | 社区征文

用户可以在创建RDD时指定RDD的分片个数,如果没有指定,那么就会采用默认值。默认值就是程序所分配到的CPU Core的数目。(2)一个计算每个分区的函数。Spark中RDD的计算是以分片为单位的,每个RDD都会实现compute函数... HBase等```cppscala> val file = sc.textFile("/spark/hello.txt")```### 3.2 通过并行化的方式创建RDD由一个已经存在的Scala集...

Shell 调用 DataX 最佳实践

DataX 是开源的一个异构数据源离线同步工具,致力于实现包括关系型数据库(MySQL、Oracle 等)、HDFS、Hive、ODPS、HBase、FTP 等各种异构数据源之间稳定高效的数据同步功能。DataX 作为数据同步框架,它将不同数据源的... 默认配置 1CU(1CU = 1Core 4GB),下拉可选择更高规格的资源配置。 3.3 网络设置在选取独享计算资源组设置后,网络配置中会默认将独享计算资源组绑定的私有网络、子网、安全组信息填入,且不可修改,您可在创建独享计算...

数据库顶会 VLDB 2023 论文解读 - Krypton: 字节跳动实时服务分析 SQL 引擎设

结果通过 ETL 导入到 HBase/ES/ClickHouse 等系统提供在线的查询服务。对于实时链路, 数据会直接进入到 HBase/ES 提供高并发低时延的在线查询服务,另一方面数据会流入到 ClickHouse/Druid 提供在线的查询聚合服务。... 每一个 Core 都绑定了一个 Task Group,它管理了所有分配给它的 Tasks, 这里每个 Task 对应一个 Coro-thread,在执行期间,Task 被提交到 Local Task Queue 中等待执行,在一段时间 t 之后,没有完成的 Local Task 会被...