hbasemapper

社区干货

社区干货

达梦@记一次国产数据库适配思考过程|社区征文

mapper-locations: classpath*:mapper/**.xml configuration: database-id: dm8``` **ii**、 通过configuration配置类,往容器注入Bean方式指定databaseId:```/** * @Auther: X.D.Yang * @Date: 2021/4/1 13:14 * @Description: */@Configurationpublic class DatabasesConfig { private static final Logger logger = LoggerFactory.getLogger(DatabasesConfig.class); @Bean public Databa...

Cloud Shuffle Service 在字节跳动 Spark 场景的应用实践

Mapper M 都会在本地生成属于自己的 Shuffle 文件。这个 Shuffle 文件内部由 R 个连续的数据片段组成。每一个 Reduce Task 运行时都会分别连接所有的 Task,从 Mapper 1 一直到 Mapper M 。连接成功后,Reduce Task 会读取每个文件中属于自己的数据片段。![]()上述方式带来的问题是显而易见的:- 由于每次读取的都是这个 Shuffle 文件的 1/R,通常情况下这个数据量是非常非常小的,大概是 KB 级别(从几百 KB 到几 KB 不等),这...

Hive SQL 底层执行过程 | 社区征文

Hive直接访问存储在 HDFS 中或者 HBase 中的文件,通过 MapReduce、Spark 或 Tez 执行查询。我们今天来聊的就是 Hive 底层是怎样将我们写的 SQL 转化为 MapReduce 等计算引擎可识别的程序。了解 Hive SQL 的底层编... 在每个 task(mapper/reducer) 中,从HDFS文件中读取与表或中间输出相关联的数据,并通过相关算子树传递这些数据。最终这些数据通过序列化器写入到一个临时HDFS文件中(如果不需要 reduce 阶段,则在 map 中操作)。临时...

MAD,现代安卓开发技术:Android 领域开发方式的重大变革|社区征文

interface Mapper { int map(String input);}class Temp { void main() { stringMapper("Android", input -> input.length() + 2); } int stringMapper(String input, Mapper mapper) { // Do something ... return mapper.map(input); }}```Kotlin 则无需定义接口,直接将匿名回调函数作为参数传入即可。(匿名函数是最后一个参数的话,方法体可单独拎出,增加可读性)...

特惠活动

特惠活动

hbasemapper-优选内容

hbasemapper-优选内容

hbasemapper-相关内容

hbasemapper-相关内容

代码示例

ObjectMapper mapper = new ObjectMapper(); return mapper.writer(defaultPrettyPrinter).writeValueAsString(value);}public void TestCreateDBInstance() { CreateDBInstanceRequest req = new CreateDBInstanceRequest(); req.setChargeType("PostPaid"); req.setDbEngineVersion("MySQL_8_0"); req.setDbTimeZone("UTC +08:00"); req.setInstanceName("your instance name"); req.setLowerCaseTab...

DevOps基于k8s发布系统CI/CD的实现|社区征文

ObjectNode objectNode = JsonUtils.getObjectMapper().createObjectNode(); objectNode.put("project_name", "dhorse"); //1:公有类型 objectNode.put("public", 1); httpPost.setEntity(new StringEntity(objectNode.toString(),"UTF-8")); try (CloseableHttpResponse response = createHttpClient(imageRepo.getUrl()).execute(httpPost)){ if (response.getStatusLine().getStatusCode() != 201 && response.get...

Cloud Shuffle Service 在字节跳动 Spark 场景的应用实践

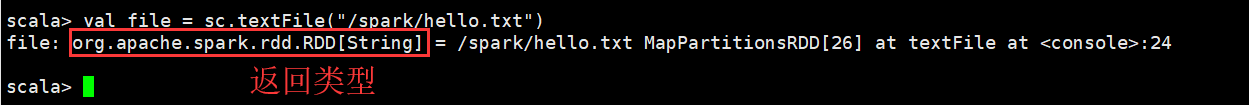

Mapper M 都会在本地生成属于自己的 Shuffle 文件。这个 Shuffle 文件内部由 R 个连续的数据片段组成。每一个 Reduce Task 运行时都会分别连接所有的 Task,从 Mapper 1 一直到 Mapper M 。连接成功后,Reduce Task 会读取每个文件中属于自己的数据片段。```### 3.2 通过并行化的方式创建RDD由一个已经存在的Scala集合创建。```cppscala> val array = Array(1,2,3,4,5)array: Array[Int] = Array(1, 2, 3, 4, 5)scala> val rdd = sc.parallelize(array)rdd: org.apache.spark.rdd.RDD[Int] = ParallelCollectionRDD[27] at ...

干货|火山引擎A/B测试平台如何“嵌入”技术研发流程

优化前需要知道mapper数、reducer数、excutor数等参数怎么设置,还要面料executor堆内内存不够、driver堆外内存不够、序列化结果过大等让人头大的错误。 其次,SQL运维优化会花费大量的人力,随着数据量的上升,其执行的环境也会变化。一次好的优化不一定永远都是对的,可能需要随着数据量上涨、需要随着环境的变化不停地去调,有可能未来也变得很差。 针对这件事怎么做更好呢?团队大数据的同学想到了AB测试。...

字节跳动 Spark Shuffle 大规模云原生化演进实践

Mapper 会把当前的 Partition 按照 Reduce 的 Partition 分成 R 个新的 Partition,并排序后写到本地磁盘上。生成的 Map Output 包含两个文件:索引文件和按 Partition 排序后的数据文件。当所有的 Mappers 写完 Map Output 后,就会开始第二个阶段- Shuffle Read 阶段。这个时候每个 Reducer 会向所有包含它的 Reducer Partition 的 ESS 访问,并读取对应 Reduce Partition 的数据。这里有可能会请求到所有 Partition 所在的 ESS,...

火山引擎 LAS Spark 升级:揭秘 Bucket 优化技术

通过上图可以发现,Hive 在写 Bucket 表之前会将相同分桶的数据通过 reduce 操作写到一个文件中,而 Spark 原生 Bucket 优化并没有这一步,因此存在如下问题:**问题1 —— 过多小文件**:Spark 写出 Bucket 表的原生实现是,在 mapper 端将数据写到文件当中,而每个 map task 中可能包含多个分桶的数据,最坏情况下会产生 M*B 个文件,M 是 map task 数目,B 是分桶数。按照这个逻辑,每个分桶内的数据都被分成了 M 份,因此可能大部分都是...

GPU实例硬件相关FAQ

ROW_REMAPPER 正常返回如下图所示。如果Pending指标为YES,表示当前发生行重映射,需要重启实例。 如果Remapping Failure Occurred指标为YES,表示当前行重映射发生异常,主机需要下线检修。 如果Bank Remap Availability Histogram指标的Low/None值 > 0,表示可用的重映射保留行不足,主机需要下线检修。 如何查看Retired Pages相关指标(除Ampere外的其它架构)?当发生Double Bit ECC错误或多个Single Bit ECC错误时,可能会淘汰GPU设备...

火山引擎 LAS Spark 升级:揭秘 Bucket 优化技术

在 mapper 端将数据写到文件当中,而每个 map task 中可能包含多个分桶的数据,最坏情况下会产生 M*B 个文件,M 是 map task 数目,B 是分桶数。按照这个逻辑,每个分桶内的数据都被分成了 M 份,因此可能大部分都是小文件。当任务并发度为 1000、分桶数目为128 时,最坏情况下会产生 M*B = 128000 个文件,如此多的文件数目会大大增加 HDFS NameNode 的压力,增加 HDFS 读取的延时。**问题2 —— 无法保证单个分桶内数据有序性**:Spark...