使批处理中的FOR /F忽略注册表的AutoRun

社区干货

社区干货

如何使用 Cluster Autoscaler 将批处理作业的节点扩容到 2000 个|KubeCon China

在帮助客户实现集群资源弹性过程中的一些经历和挑战,共分为以下几个部分: * 第一部分介绍什么是 CA,以及它内部的流程和实现方式,帮助大家更好地理解其工作机制;* 第二部分简要说明客户批处理作业的使用场景;* 第三部分把重心放在客户在使用 Cluster Autoscaler 的过程中,碰到的问题和挑战,以及我们是如何解决的;* 最后将给出一些建议,帮助大家更好地实现集群弹性,避免踩到类似的坑。 **0****1** ...

Kafka 消息传递详细研究及代码实现|社区征文

本文将研究 Kafka 从生产、存储到消费消息的详细过程。 ## Producer### 消息发送所有的 Kafka 服务器节点任何时间都能响应是否可用、是否 topic 中的 partition leader,这样生产者就能发送它的请求到服务器... default: 2147483647valid values: [0, ..., 2147483647]importance: high [**batch.size**](url)当多条消息发送到一个分区时,producer 批量发送消息大小的上限 (以字节为单位)。即使没有达到这个大小,生...

如何使用 Cluster Autoscaler 将批处理作业的节点扩容到 2000 个

在帮助客户实现集群资源弹性过程中的一些经历和挑战,共分为以下几个部分:* 第一部分介绍什么是 CA,以及它内部的流程和实现方式,帮助大家更好地理解其工作机制;* 第二部分简要说明客户批处理作业的使用场景;* 第三部分把重心放在客户在使用 Cluster Autoscaler 的过程中,碰到的问题和挑战,以及我们是如何解决的;最后将给出一些建议,帮助大家更好地实现集群弹性,避免踩到类似的坑。 什么是 Cluster Autoscaler ...

如何使用 Cluster Autoscaler 将批处理作业的节点扩容到 2000 个

在帮助客户实现集群资源弹性过程中的一些经历和挑战,共分为以下几个部分: * 第一部分介绍什么是 CA,以及它内部的流程和实现方式,帮助大家更好地理解其工作机制;* 第二部分简要说明客户批处理作业的使用场景;* 第三部分把重心放在客户在使用 Cluster Autoscaler 的过程中,碰到的问题和挑战,以及我们是如何解决的;* 最后将给出一些建议,帮助大家更好地实现集群弹性,避免踩到类似的坑。**什么是 Cluster Autosc...

特惠活动

特惠活动

使批处理中的FOR /F忽略注册表的AutoRun-优选内容

使批处理中的FOR /F忽略注册表的AutoRun-优选内容

使批处理中的FOR /F忽略注册表的AutoRun-相关内容

使批处理中的FOR /F忽略注册表的AutoRun-相关内容

我与Stable Diffusion的“缘” 主赛道 | 社区征文

但这段与Stable Diffusion的“缘分”如同一场艺术画,每一笔勾勒都是对技术探索的独特贡献。或许,未来还有更多的发现等待着我,让我在技术的海洋中不断前行,发现更多未知的宝藏。接下来我就比赛中的优化方向、思路和... 请看模型压缩包中:```import numpy as npimport oneflow as flowimport oneflow.typing as tpBATCH_SIZE = 100def mlp(data): #构建网络...@flow.global_function(type="train")def train_job( ...

配置Windows实例NTP服务

本文以Windows Server 2019 数据中心版64位为例,介绍如何使用NTP服务同步Windows实例的本地时间。 什么是NTP?NTP(Network Time Protocol)即网络时间协议,是TCP/IP协议族中的一个应用层协议,用于客户端和服务器之间... 在运行窗口中执行regedit命令。 在“注册表编辑器”窗口的左侧目录树中,选择“HKEY_LOCAL_MACHINE > SYSTEM > CurrentControlSet > Services > W32Time > TimeProviders > NtpClient”。 在右侧详情窗口“名称”...

飞连更新日志

Filter ID。 优化 管理 802.1x 认证员工入网 支持更精细的访客 Wi-Fi 使用时长设置,可以按小时进行配置,提高管理的灵活性。 优化 管理访客入网 终端管控 支持进程组检测,您可以选择检测以下任一进程/应用或... 防止攻击者通过注册表写病毒文件。 优化 防病毒策略配置 动态控制 动态控制新增定期自动重置 Wi-Fi 密码的策略模版,增强网络安全性。 优化 动态决策 工作流 审批流模板:支持使用预定义模板快速创建审批流程...

Redis 使用 List 实现消息队列有哪些利弊?|社区征文

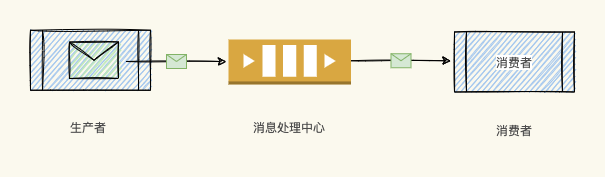

缓冲或批处理工作以及缓解高峰期工作负载。- Producer:消息生产者,负责产生和发送消息到 Broker;- Broker:消息处理中... 可以按照元素被推入列表中的顺序来存储元素,能满足「先进先出」的需求,这些元素既可以是文字数据,又可以是二进制数据。**LPUSH**生产者使用 `LPUSH key element[element...]` 将消息插入到队列的头部,如果 key...

搭建Llama-2-7b-hf模型进行推理

本文主要介绍在云服务器实例中部署meta-llama/Llama-2-7b-hf模型并使用CPU进行推理,以及通过Intel xFasterTransformer实现推理过程加速的方案。 背景信息Llama-2-7b-hf模型Llama 2是Meta公司开源的一个预训练和微调的生成文本模型集合,规模从70亿 ~ 700亿参数不等。本实践使用该模型集合中的7b(70亿)参数规模,且转换为HF格式的模型。更多详情,可查看meta-llama/Llama-2-7b-hf。 xFasterTransformerIntel xFasterTransformer 是In...