Kafka生产者SSL属性的YAML文件

社区干货

社区干货

如何使用 SASL_SSL 公网连接消息队列Kafka版

# 问题描述开启公网连接后,如何使用 Python 正常连接到 Kafka 进行生产和消费。# 问题分析在公网环境下,消息队列 Kafka 版要求通过 SSL 证书对消息进行鉴权和加密,保障数据传输过程的安全性,防止数据在网络传输过程中被截取或者窃听,相较于普通公网访问方式具备更高的安全性。目前支持客户端对服务端证书的单向认证, 所以需要下载 SASL_SSL 证书 并指定 SASL_SSL 协议。# 解决方案Python 示例demo如下:```pythonfrom kaf...

如何排查消费者无法连接到Kafka问题

# 问题描述在开发和测试过程中,我们可能会遇到无法连接 Kafka 的情况,本文使用 kafka-console-consumer,来模拟几类常见的连接报错# 环境配置* 密码类型选择 Scram* 使用 SASL_SSL接入点,公网连接,客户端配置文件如下:```Plain Textsasl.jaas.config=org.apache.kafka.common.security.sc...

Kafka数据同步

# 前言 [#](https://vsop-online.bytedance.net/doc/manage/detail/6627/detail/?DocumentID=173809#%E5%89%8D%E8%A8%80)Kafka MirrorMaker 是 Kafka 官网提供的跨数据中心流数据同步方案,其实现原理是通过从 Sou... KAFKA_HEAP_OPTS="-Xmx1024M -Xms512M"fi```保存退出。(2)kafka生产者启动后报错:Error while fetching metadata with correlation解决方法:修改 config\server.properties,修改内容如下:```XMLlisteners...

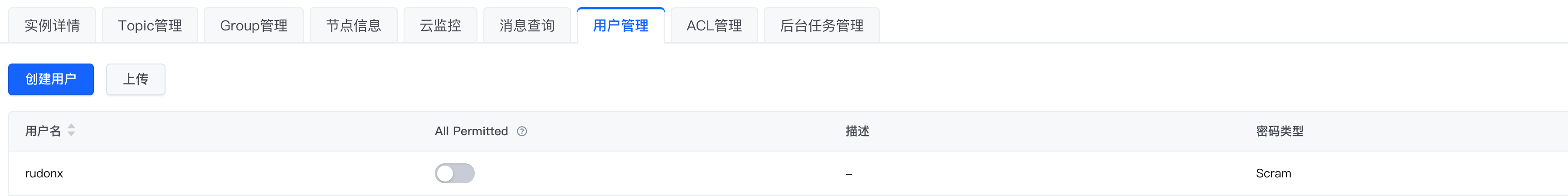

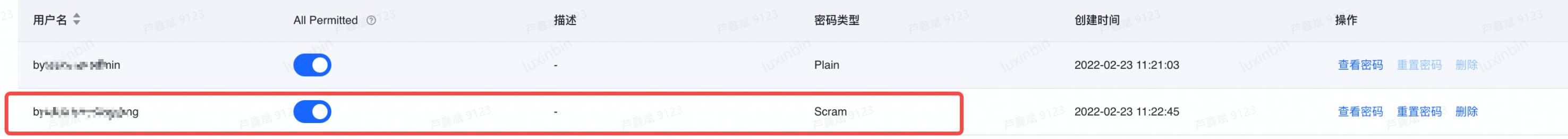

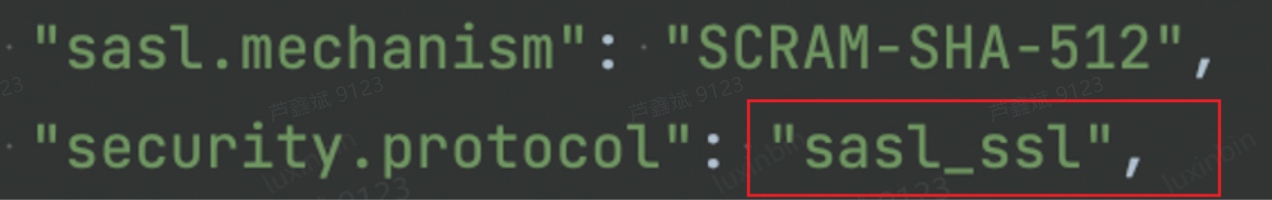

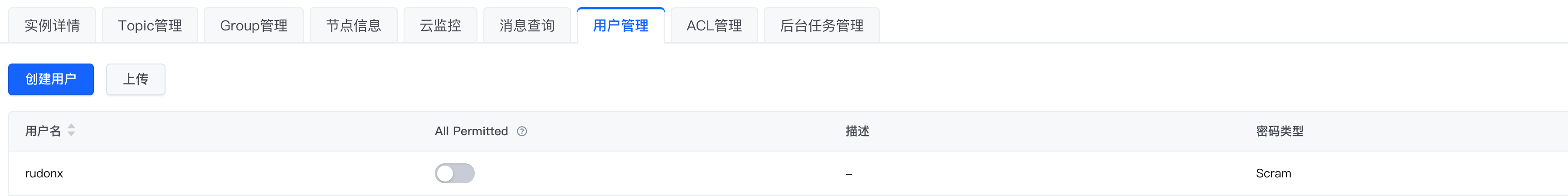

如何使用Scram类型密码连接消息队列Kafka

# 问题描述 客户在前端创建Scram类型密码,代码中无法连接到Kafka  # 问题分析 客户代码中协议及认证机制部分配置如下:  因为SASL_SSL协议并不支持SCRAM,需要更改为SASL_PLAINTEXT...

特惠活动

特惠活动

Kafka生产者SSL属性的YAML文件-优选内容

Kafka生产者SSL属性的YAML文件-优选内容

Kafka生产者SSL属性的YAML文件-相关内容

Kafka生产者SSL属性的YAML文件-相关内容

SASL_SSL 接入点 SCRAM 机制收发消息

2 添加配置文件创建消息队列 Kafka版配置文件 config.properties。配置文件字段的详细说明,请参考配置文件。 说明 SCRAM 机制下,应使用具备对应 Topic 访问权限的 SCRAM 用户进行 SASL 认证。获取用户名及密码的方式请参考2 收集连接信息。 通过 SASL_SSL 接入点 SCRAM 机制接入时,配置文件示例如下。 YAML bootstrap.servers=xxxxxsecurity.protocol=SASL_SSLtopic=my-topicconsumer.group.id=testconsumer.auto.offset.reset=...

实例连接

消息队列 Kafka版提供以下实例连接相关的常见问题供您参考。 FAQ 列表是否支持修改 VPC 和子网? 是否支持修改实例的连接地址和端口号? SSL 证书的有效期是多久? 是否支持无密码访问 Kafka 实例? 是否支持跨 VPC 或子网访问 Kafka 实例? 是否支持跨地域或跨可用区访问 Kafka 实例? 是否支持通过代理访问 Kakfa 实例? 如何测试实例的连通性? 是否支持修改 VPC 和子网?创建实例后,不支持修改 VPC,但可以修改子网。修改方式请参考切...

使用 Kafka 协议上传日志

对于不合法的 JSON 格式,部分字段可能出现会解析错乱的情况;对于其他格式的日志数据,原始日志全文会以字符串格式被统一封装在字段 __content__ 中。 说明 通过 Kafka 协议解析 JSON 格式日志时,最多支持一层扩展,包含多层嵌套的日志字段将被作为一个字符串进行采集和保存。 限制说明支持的 Kafka 协议版本为 0.11.x~2.0.x。 支持压缩方式包括 gzip、snappy 和 lz4。 为保证日志传输的安全性,必须使用 SASL_SSL 连接协议。对应的...

流式导入

当前已经支持的 Kafka 消息格式为: JSON Protobuf 支持的 Kafka/Confluent Cloud 版本:0.10 及以上 必备权限要将 Kafka 数数据迁移到ByteHouse,需要确保 Kafka 和 ByteHouse 之间的访问权限配置正确。需要在Kafka中... 并选择 Kafka 数据源类型。 您可以选择已保存的数据源信息,如果没有已存在的数据源,您可以新建数据源。当前 Kafka 数据源支持以下四种鉴权模式,并支持 SSL 加密:None 无鉴权 PLAINTEXT 鉴权(支持 SSL) SCRAM-SHA-2...

Kafka/BMQ

此处仅支持 Kafka 连接器。 注意 Kafka-0.10 和 Kafka-0.11 两个版本的连接器使用的 Kafka 客户端有缺陷,在某些情况下可能无法自动提交 Kafka offset 信息。 topic 是 (none) String 指定 Kafka Topic 的名称。 properties.bootstrap.servers 是 (none) String 指定 Kafka Broker 的地址,格式为host:port。 properties.group.id 是 (none) String 指定 Kafka 消费组的 ID。 注意 在 Flink 中使用 Kafka 连接器消...

使用Logstash消费Kafka中的数据并写入到云搜索

前言 Kafka 是一个分布式、支持分区的(partition)、多副本的(replica) 分布式消息系统, 深受开发人员的青睐。 云搜索服务是火山引擎提供的完全托管的在线分布式搜索服务,兼容 Elasticsearch、Kibana 等软件及常用开... Kafka 云搜索 云服务器ECS:Centos 7 在 ECS 主机上准备 Kafka 客户端的运行环境,提前安装好Java运行环境 在 ECS 主机上安装 Logstash 实验步骤 步骤一:准备 Logstash 配置文件Logstash 配置文件有如下格式: i...

如何排查消费者无法连接到Kafka问题

# 问题描述在开发和测试过程中,我们可能会遇到无法连接 Kafka 的情况,本文使用 kafka-console-consumer,来模拟几类常见的连接报错# 环境配置* 密码类型选择 Scram* 使用 SASL_SSL接入点,公网连接,客户端配置文件如下:```Plain Textsasl.jaas.config=org.apache.kafka.common.security.sc...

新功能发布记录

kafka.1200xrate.hw 和 kafka.1500xrate.hw 共计 3 款实例规格。 2024-1-5 全部地域 产品规格 优化实例详情 在实例详情页,增加磁盘水位的百分比展示。 2024-1-5 全部地域 查看实例详情 2023年12月功能名称 功能描述 发布时间 发布地域 相关文档 批量导入 SASL 用户 支持通过上传配置文件的方式批量创建多个 SASL 用户。 2023-12-08 全部地域 批量导入 SASL 用户 2023年11月功能名称 功能描述 发布时间 发...

流式导入

ByteHouse 支持通过 Kafka 进行实时数据写入。相比通过引擎进行 Insert 数据,ByteHouse 的 Kafka 导入功能具有以下特点: 支持 at-least-once 语义,可自动切换主备写入,稳定高可用。 数据根据 Kafka Partition 自动... sasl_ssl 协议类型。 用户名、密码:填写有权限访问 Kafka 实例的用户名和密码信息。 数据源信息填写完成后,单击确定按钮,进行数据源连通性测试,连通成功后,即代表数据源创建成功。 新建导入任务在对应数据源下,单...