kafka什么时候更新hw

社区干货

社区干货

聊聊 Kafka:Topic 创建流程与源码分析 | 社区征文

您可以通过每个主题的配置设置来定义 Kafka 应该保留您的事件多长时间,之后旧事件将被丢弃。Kafka 的性能在数据大小方面实际上是恒定的,因此长时间存储数据是完全没问题的。主题是**分区的**,这意味着一个主题分... =&rk3s=8031ce6d&x-expires=1714666902&x-signature=Oo3hwI%2B4RvYZ16L%2FVkTe1A01KN8%3D)为了使数据具有容错性和高可用性,每个主题都可以**复制**,甚至可以跨地理区域或数据中心**复制**,以便始终有多个代理拥有...

消息队列选型之 Kafka vs RabbitMQ

对此本文将在接下来的内容中以 Kafka 和 RabbitMQ 为例分享消息队列选型的一些经验。消息队列即 Message+Queue,消息可以说是一个数据传输单位,它包含了创建时间、通道/主题信息、输入参数等全部数据;队列(Queue)... =&rk3s=8031ce6d&x-expires=1714580418&x-signature=a3QmsdwwkZM%2BhWLlaeyEzs1vd9M%3D)* **Producer** :主要就是生成消息,通过信道(Channel),把消息发送给交换机(Exchange)。* **Consumer** :监听 RabbitMQ ...

字节跳动基于Apache Atlas的近实时消息同步能力优化 | 社区征文

文 | **洪剑**、**大滨** 来自字节跳动数据平台开发套件团队# 背景## 动机字节数据中台DataLeap的Data Catalog系统基于Apache Atlas搭建,其中Atlas通过Kafka获取外部系统的元数据变更消息。在开源版本中,每台... 消息处理时间 | 不同类型的消息,处理时间会有较大差别,从<1s~1min || 封装 | 确保不丢消息的前提下,依赖框架做Offset的提交,业务侧只需要编写消息的处理逻辑;另外,将...

数据一致性离不开的checkpoint机制 |社区征文

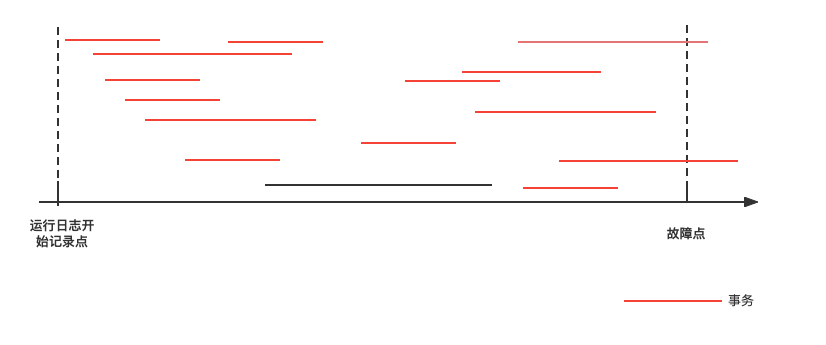

但是故障恢复是需要时间的。运行日志保存了若干天的记录,当发生系统故障时应从哪一点开始恢复呢?  DBMS在运行日志中定期的设置和更新检查点。检查点是这样的时刻:在该时刻,DBMS强制使内存DB Buffer中的内容与DB中的内容保持一致,即将DB Buffer中更新的所有内容写回DB中。即在检查点之前内...

特惠活动

特惠活动

kafka什么时候更新hw-优选内容

kafka什么时候更新hw-优选内容

kafka什么时候更新hw-相关内容

kafka什么时候更新hw-相关内容

Kafka订阅埋点数据(私有化)

(不同的Kafka版本使用方式不一样),更多参数可以参考kafka官方手册。 Plain /opt/tiger/kafka/bin/kafka-console-consumer.sh --zookeeper ${zk_host1}:2181,${zk_host2}:2181,${zk_host3}:2181/kafka_vpc_lf --topic behavior_event/opt/tiger/kafka/bin/kafka-console-consumer.sh --bootstrap-server ${broker_host1}:9192,${broker_host2}:9192,${broker_host3}:9192 --topic behavior_event说明 zk_host[123]更新为kafka依赖...

消息队列选型之 Kafka vs RabbitMQ

对此本文将在接下来的内容中以 Kafka 和 RabbitMQ 为例分享消息队列选型的一些经验。消息队列即 Message+Queue,消息可以说是一个数据传输单位,它包含了创建时间、通道/主题信息、输入参数等全部数据;队列(Queue)... =&rk3s=8031ce6d&x-expires=1714580418&x-signature=a3QmsdwwkZM%2BhWLlaeyEzs1vd9M%3D)* **Producer** :主要就是生成消息,通过信道(Channel),把消息发送给交换机(Exchange)。* **Consumer** :监听 RabbitMQ ...

产品规格

火山引擎消息队列 Kafka版兼容 Apache Kafka,支持多副本存储,实例的计算能力与存储空间依据您选定的计算规格和存储规格而定。 计算规格 计算规格列表消息队列 Kafka版为实例提供以下计算规格供您选择。 说明 某些地... kafka.20xrate.hw 20 20 350 350~1000 300~96000 kafka.30xrate.hw 30 30 350 350~1000 300~96000 kafka.60xrate.hw 60 60 400 400~1000 300~96000 kafka.100xrate.hw 100 100 600 600~30...

Upsert Kafka

Upsert Kafka 连接器支持以 upsert 方式从 Kafka topic 中读取数据并将数据写入 Kafka topic,支持做数据源表和结果表。 作为源表时,Upsert Kafka 连接器可以将 Kafka 中存储的数据转换为 changelog 流,其中每条数据记录代表一个更新或删除事件。数据记录中有 key,表示 UPDATE;数据记录中没有 key,表示 INSERT;数据记录中 key 的 value 为空,表示 DELETE。 作为结果表时,Upsert Kafka 连接器可以消费上游计算逻辑产生的 changelog...

Kafka消息订阅及推送

1. 功能概述 VeCDP产品提供强大的开放能力,支持通过内置Kafka对外输出的VeCDP系统内的数据资产。用户可以通过监测Kafka消息,及时了解标签、分群等数据变更,赋能更多企业业务系统。 2. 消息订阅配置说明 topic规范... status 状态结果 Long 是 Sucess成功Failed失败 err_msg 报错信息 String 是 task_time 任务更新时间 String 是 3.2 标签快照序号 事件名称 事件说明 属性 属性展示名 属性类型 是否必填 ...

CreateInstance

如果需要通过公网访问消息队列 Kafka版实例,请先申请同地域的 EIP,详细操作步骤请参考申请公网 IP。 默认情况下,您可以在每个地域中创建 8 个 Kafka 实例,每个账号在每个地域中的所有实例存储容量总和最大为 90Ti... Version String 是 2.2.2 支持的Kafka版本。当前支持的版本包括: 2.2.2:Kafka 2.2.2版本。 2.8.2:Kafka 2.8.2版本。 ComputeSpec String 是 kafka.20xrate.hw 实例的计算规格。消息队列 Kafka版实例提供...

创建 Kafka 触发器

函数服务支持对接火山引擎的 消息队列 Kafka 版。 通过创建 Kafka 触发器,函数服务将作为消费者消费 Kafka 中的消息,并将消息传递给用户函数,触发函数代码逻辑。您无需关心函数服务消费消息的细节,只需编写处理消息的函数。本文为您介绍如何创建 Kafka 触发器。 前提条件函数已开启 VPC 调用功能,详细操作可参见 更新函数配置。 函数至少完成一次全量发布,详细操作可参见 发布函数。 已创建 Kafka 实例和 Topic,且已获得访问 Kaf...

ModifyInstanceSpec

升级实例的计算规格时,需要同步升级存储空间。 请求参数参数 参数类型 是否必选 示例值 说明 InstanceId String 是 kafka-cnngqkfgdudt**** 实例 ID。 ComputeSpec String 否 kafka.60xrate.hw 实... 仅升级存储规格时无需再均衡。即此参数仅在指定 ComputeSpec 参数时生效。 RebalanceTime String 否 2022-07-18T07:48:58Z 自动再均衡的执行时间。时间格式为 YYYYMMDD'T'HHMMSS'Z',例如 2022-07-18T07:48:5...

配置 Kafka 数据源

Kafka 数据源为您提供实时读取和离线写入 Kafka 的双向通道能力,实现不同数据源与 Kafka 数据源之间进行数据传输。本文为您介绍 DataSail 的 Kafka 数据同步的能力支持情况。 1 支持的 Kafka 版本实时读、离线读:支... 则可以忽略不填 version Kafka broker 版本 group.id Kafka 中 group id 信息 若不填时,会默认按照任务名称和任务 id 拼接而成 update-mode 消息更新模式 Kafka 一般情况下配置为:append *child_connect...