查看kafka客户端链接

社区干货

社区干货

如何排查消费者无法连接到Kafka问题

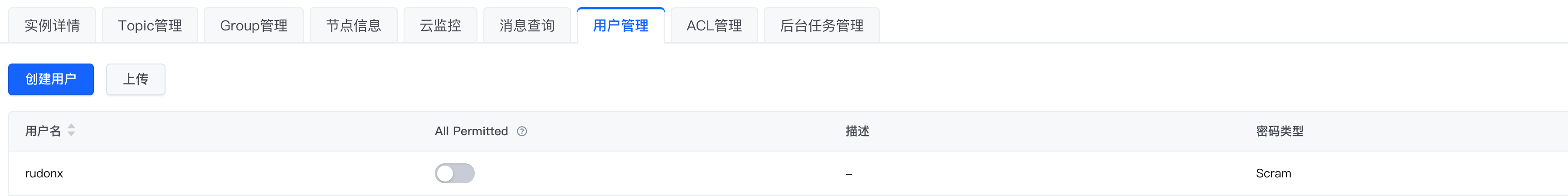

# 问题描述在开发和测试过程中,我们可能会遇到无法连接 Kafka 的情况,本文使用 kafka-console-consumer,来模拟几类常见的连接报错# 环境配置* 密码类型选择 Scram* 使用 SASL_SSL接入点,公网连接,客户端配置文件如下:```Plain Textsasl.jaas.config=org.apache.kafka.common.security.sc...

Kafka 消息传递详细研究及代码实现|社区征文

Kafka 消息发送分为直接、同步、异步发送。其中直接发送无回调,同步发送有阻塞,故生产环境多用异步发送。```Properties properties = new Properties();// 建立与 Kafka 群集的初始连接的主机/端口对的列表... 它可以确定每条消息在 partition 内的唯一位置。如上图所示, .index 文件中的 N 为索引,position 为元数据物理位置。 .log 文件中的 345678 + N 为 offset,position 为物理偏移地址。 .index 文件元数据物理位置...

如何使用 SASL_SSL 公网连接消息队列Kafka版

# 问题描述开启公网连接后,如何使用 Python 正常连接到 Kafka 进行生产和消费。# 问题分析在公网环境下,消息队列 Kafka 版要求通过 SSL 证书对消息进行鉴权和加密,保障数据传输过程的安全性,防止数据在网络传输过程中被截取或者窃听,相较于普通公网访问方式具备更高的安全性。目前支持客户端对服务端证书的单向认证, 所以需要下载 SASL_SSL 证书 并指定 SASL_SSL 协议。# 解决方案Python 示例demo如下:```pythonfrom kaf...

消息队列选型之 Kafka vs RabbitMQ

在面对众多的消息队列时,我们往往会陷入选择的困境:“消息队列那么多,该怎么选啊?Kafka 和 RabbitMQ 比较好用,用哪个更好呢?”想必大家也曾有过类似的疑问。对此本文将在接下来的内容中以 Kafka 和 RabbitMQ 为例分... 同时有兜底 Task 查询转账所有未到终态领取单并通过 MQ 异步发送转账消息。 **解耦**其次通过使用消息队列,发送方和接收方可以解耦,彼此之间不直接通信。发送方只需将消息发送到队列中,而不需要关...

特惠活动

特惠活动

查看kafka客户端链接-优选内容

查看kafka客户端链接-优选内容

查看kafka客户端链接-相关内容

查看kafka客户端链接-相关内容

使用 SASL_SSL 接入点连接实例

消息队列 Kafka版支持通过 SSL 证书对消息进行鉴权和加密,保障数据传输过程的安全性,防止数据在网络传输过程中被截取或者窃听,相较于普通访问方式具备更高的安全性。目前支持客户端对服务端证书的单向认证。 前提条件已获取 SASL_SSL 接入点信息,包括连接地址和端口号。详细信息请参考查看接入点。 已创建 Topic。操作步骤请参考创建 Topic。 如果通过公网访问实例,建议实例绑定的 EIP 带宽上限大于预估的公网业务流量峰值。详...

Kafka/BMQ

您可以创建 source 流从 Kafka Topic 中获取数据,作为作业的输入数据;也可以通过 Kafka 结果表将作业输出数据写入到 Kafka Topic 中。 注意事项使用 Flink SQL 的用户需要注意,不再支持 kafka-0.10 和 kafka-0.11 两个版本的连接器,请直接使用 kafka 连接器访问 Kafka 0.10 和 0.11 集群。Kafka-0.10 和 Kafka-0.11 两个版本的连接器使用的 Kafka 客户端有缺陷,在某些情况下可能无法自动提交 Kafka offset 信息。 使用 datastrea...

常见问题

具体命令如下: shell telnet {Kafka Broker 地址} 9092如果无法连通,请检查 Kafka Client 所处环境与 EMR Kafka 集群的网络连通性,例如 Client 与 Broker 是否处于同一个 VPC(如果不在同一个 VPC,是否通过给 Broker 绑定公网 IP 等机制打通 Client 与 Broker 之间的网络),以及 Broker ECS 安全组规则配置中是否把 9092 端口开放给了 Client。如果判断网络连通性没有问题,可以查看 Kafka Broker 机器上的日志,排查 Kafka 进程是否...

Kafka订阅埋点数据(私有化)

本文档介绍了在增长分析(DataFinder)产品私有化部署场景下,开发同学如何访问Kafka Topic中的流数据,以便进一步进行数据分析和应用,比如实时推荐等。 1. 准备工作 kafka消费只支持内网环境消费,在开始之前,需要提前准备好如下输入: Kafka 0.10.1版本及以上的客户端(脚本或JAR包) zookeeper链接:可联系运维获取 broker链接:可联系运维获取 topic名称:下方给出了两个topic数据格式,确认需要消费哪一个topic; ConsumerGroup:确认好Co...

Kafka订阅埋点数据(私有化)

本文档介绍了在增长分析(DataFinder)产品私有化部署场景下,开发同学如何访问Kafka Topic中的流数据,以便进一步进行数据分析和应用,比如实时推荐等。 1. 准备工作 kafka消费只支持内网环境消费,在开始之前,需要提前准备好如下输入: Kafka 0.10.1版本及以上的客户端(脚本或JAR包) zookeeper链接:可联系运维获取 broker链接:可联系运维获取 topic名称:下方给出了两个topic数据格式,确认需要消费哪一个topic; ConsumerGroup:确认好Co...

使用 SASL_PLAINTEXT 接入点连接实例

详细接入方式请参考使用 SASL_SSL 接入点连接实例。 前提条件已获取 SASL_PLAINTEXT 接入点信息,包括连接地址和端口号。详细信息请参考查看接入点。 已创建 Topic。操作步骤请参考创建Topic。 如果通过公网访问实例,建议实例绑定的 EIP 带宽上限大于预估的公网业务流量峰值。详细信息请参考配置公网访问。 环境中已成功安装 JDK、配置环境变量,并下载 Kafka 开源客户端,例如 Kafka 2.2.2 客户端。 配置鉴权在 Kafka 客户端包的....

实例管理

支持哪些语言的客户端? 支持的消息体最大是多少? 消息的保留时间是多久? 支持的 Kafka 版本包括哪些? 如何选择计算规格和存储规格?消息队列 Kafka版提供多种实例规格供您选择,你可以根据业务的读写流量峰值、所需... 对于已购买的 Kafka 实例,您可以在 Kafka 实例的实例详情页签中基本信息区域找到可用区一行,查看可用区数量。如果可用区数量大于 1,表示该实例为多可用区部署的实例。 单 AZ 实例如何切换为多 AZ?创建实例后,不可修...

配置 Kafka 数据源

连接串形式接入用连接串形式配置 Kafka 数据源,其中参数名称前带 * 的为必填参数,名称前未带 * 的为可选填参数。 参数 说明 基本配置 *数据源类型 Kafka *接入方式 火山引擎 Kafka *数据源名称 数据源的名称,可自行设置,仅支持中文,英文,数字,“_”,100个字符以内。 参数配置 *Kafka 版本 Kafka 版本,下拉可选。当前支持 Kafka 2.2.x 和 0.10 版本。 *Kafka 集群地址 启动客户端连接Kafka服务时使用。填写格式为...

使用Logstash消费Kafka中的数据并写入到云搜索

您将学习如何使用 Logstash 消费 Kafka 中的数据,并写入到云搜索服务中。 关于实验 预计部署时间:20分钟级别:初级相关产品:消息队列 - Kafka & 云搜索受众: 通用 环境说明 如果还没有火山引擎账号,点击此链接注册账号 如果您还没有VPC,请先点击链接创建VPC 消息队列 - Kafka 云搜索 云服务器ECS:Centos 7 在 ECS 主机上准备 Kafka 客户端的运行环境,提前安装好Java运行环境 在 ECS 主机上安装 Logstash 实验步骤 步骤一:准...