kafka2.13jaas

社区干货

社区干货

如何排查消费者无法连接到Kafka问题

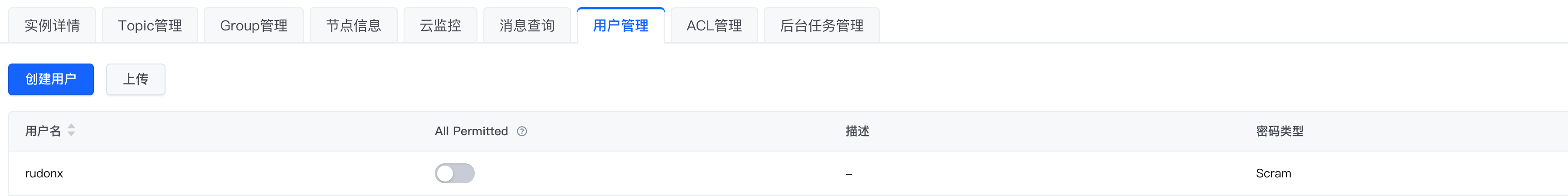

# 问题描述在开发和测试过程中,我们可能会遇到无法连接 Kafka 的情况,本文使用 kafka-console-consumer,来模拟几类常见的连接报错# 环境配置* 密码类型选择 Scram* 使用 SASL_SSL接入点,公网连接,客户端配置文件如下:```Plain Textsasl.jaas.config=org.apache.kafka.common.security.sc...

Logstash 如何通过 Kafka 协议消费 TLS 日志

# **问题现象**如何通过修改 Logstash 配置文件,实现通过 Kafka 协议消费日志到其他业务系统。# 问题分析TLS 日志服务支持通过 Logstash 消费日志数据,您可以通过配置 Logstash 服务内置的 logstash-input-kafka 插件获取日志服务中的日志数据。# 解决方案## 1.安装 logstash1.1 [下载安装包](https://www.elastic.co/cn/downloads/logstash)。1.2 解压安装包到指定目录。1.3 查看logstash 版本```Java[root@lxb-jms ...

Kafka 消息传递详细研究及代码实现|社区征文

Java 实现 Kafka 消息发送分为直接、同步、异步发送。其中直接发送无回调,同步发送有阻塞,故生产环境多用异步发送。```Properties properties = new Properties();// 建立与 Kafka 群集的初始连接的主机/端口对的列表 多个以逗号隔开properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "kafka1:9092, kafka2:9092, kafka3:9092");// 消息不成功重试次数properties.put(ProducerConfig.RETRIES_CONFIG, 0);...

聊聊 Kafka:Topic 创建流程与源码分析 | 社区征文

/kafka-run-class.sh kafka.admin.TopicCommand "$@"```最终执行的是 kafka.admin.TopicCommand 该类,源码中找到该类,用 IDEA 进行断点调试源码。程序参数:```--create --boo...

特惠活动

特惠活动

kafka2.13jaas-优选内容

kafka2.13jaas-优选内容

kafka2.13jaas-相关内容

kafka2.13jaas-相关内容

Kafka 生产者最佳实践

本文档以 Confluent 官方的 Java 版本 SDK 为例介绍 Kafka 生产者和消费者的使用建议。推荐在使用消息队列 Kafka版进行消息生产与消费之前,阅读以下使用建议,提高接入效率和业务稳定性。 消息顺序性火山引擎 Kafka... 会根据消息 key 的 hash 结果进行分区选择,相同 key 的消息将会分配到相同的分区编号。因而当为一批消息指定相同的消息 key 时,即可实现这些消息的分区有序。但是需要注意,若执行 Topic 增加分区后,消息 key 选择到...

SASL_SSL 接入点 PLAIN 机制收发消息

获取用户名及密码的方式请参考2 收集连接信息。 通过 SASL_SSL 接入点 PLAIN 机制接入时,配置文件示例如下。 YAML bootstrap.servers=xxxxxsecurity.protocol=SASL_SSLtopic=my-topicconsumer.group.id=testconsumer.auto.offset.reset=earliestconsumer.enable.auto.commit=falseclient.dns.lookup=use_all_dns_ipssasl.mechanism=PLAINsasl.jaas.config=org.apache.kafka.common.security.plain.PlainLoginModule required us...

SASL_SSL 接入点 SCRAM 机制收发消息

获取用户名及密码的方式请参考2 收集连接信息。 通过 SASL_SSL 接入点 SCRAM 机制接入时,配置文件示例如下。 YAML bootstrap.servers=xxxxxsecurity.protocol=SASL_SSLtopic=my-topicconsumer.group.id=testconsumer.auto.offset.reset=earliestconsumer.enable.auto.commit=falseclient.dns.lookup=use_all_dns_ipssasl.mechanism=SCRAM-SHA-256sasl.jaas.config=org.apache.kafka.common.security.scram.ScramLoginModule req...

Logstash 如何通过 Kafka 协议消费 TLS 日志

# **问题现象**如何通过修改 Logstash 配置文件,实现通过 Kafka 协议消费日志到其他业务系统。# 问题分析TLS 日志服务支持通过 Logstash 消费日志数据,您可以通过配置 Logstash 服务内置的 logstash-input-kafka 插件获取日志服务中的日志数据。# 解决方案## 1.安装 logstash1.1 [下载安装包](https://www.elastic.co/cn/downloads/logstash)。1.2 解压安装包到指定目录。1.3 查看logstash 版本```Java[root@lxb-jms ...

Kafka订阅埋点数据(私有化)

${zk_host2}:2181,${zk_host3}:2181/kafka_vpc_lf --topic behavior_event/opt/tiger/kafka/bin/kafka-console-consumer.sh --bootstrap-server ${broker_host1}:9192,${broker_host2}:9192,${broker_host3}:9192 --topic behavior_event说明 zk_host[123]更新为kafka依赖的zookeeper机器的地址(sd lookup vpc.zookeeper)。 broker_host[123] 修改为Kafka Broker的地址(sd lookup kafka_vpc)。 2.2 Java Client添加Maven依赖,如...

Kafka订阅埋点数据(私有化)

${zk_host2}:2181,${zk_host3}:2181/kafka_vpc_lf --topic behavior_event/opt/tiger/kafka/bin/kafka-console-consumer.sh --bootstrap-server ${broker_host1}:9192,${broker_host2}:9192,${broker_host3}:9192 --topic behavior_event说明 zk_host[123]更新为kafka依赖的zookeeper机器的地址(sd lookup vpc.zookeeper)。 broker_host[123] 修改为Kafka Broker的地址(sd lookup kafka_vpc)。 2.2 Java Client添加Maven依赖,如...

Kafka订阅埋点数据(私有化)

${zk_host2}:2181,${zk_host3}:2181/kafka_vpc_lf --topic behavior_event/opt/tiger/kafka/bin/kafka-console-consumer.sh --bootstrap-server ${broker_host1}:9192,${broker_host2}:9192,${broker_host3}:9192 --topic behavior_event说明 zk_host[123]更新为kafka依赖的zookeeper机器的地址(sd lookup vpc.zookeeper)。 broker_host[123] 修改为Kafka Broker的地址(sd lookup kafka_vpc)。 2.2 Java Client添加Maven依赖,如...

快速开始

示例代码 创建实例通过 Volcengine Java SDK 调用消息队列 Kafka版 V2 API CreateInstance 的示例代码如下。 Java package com.volcengine.kafka.examples;import com.volcengine.ApiClient;import com.volcengine.ApiException;import com.volcengine.kafka.KafkaApi;import com.volcengine.kafka.model.*;import com.volcengine.sign.Credentials;public class TestKafka { public static void main(String[] args) throw...

Kafka 消费者最佳实践

本文档以 Confluent 官方 Java 版本客户端 SDK 为例,介绍使用火山引擎 Kafka 实例时的消费者最佳实践。 广播与单播在同一个消费组内部,每个消息都预期仅仅只被消费组内的某个消费者消费一次,因而使用同一个消费组的... 自由分配(Assign):完全由业务自己指定消费者需要消费的分区信息,不同消费者之间的消费协调等都需要业务自己实现。 推荐直接使用订阅(Subscribe)的方式。 消费模型消费者使用拉模型进行数据读取,需要保证拉取的线程...