怎么使用CUDA加速c代码

社区干货

社区干货

nvidia-cuda镜像

## 简介CUDA-X AI 是软件加速库的集合,这些库建立在 CUDA® (NVIDIA 的开创性并行编程模型)之上,提供对于深度学习、机器学习和高性能计算 (HPC) 必不可少的优化功能。下载地址:- 火山引擎访问地址:https://mirrors.ivolces.com/nvidia_all/- 公网访问地址:https://mirrors.volces.com/nvidia_all/## 相关链接官方主页:[https://www.nvidia.cn/technologies/cuda-x/](https://www.nvidia.cn/technologies/cuda-x/?spm=a...

【高效视频处理】一窥火山引擎多媒体处理框架-BMF|社区征文

我们可以添加编码、解码和过滤模块,构建一个从MP4到MKV的转码Pipeline。了解配置接口后,即可按需设置参数,如改变视频大小或帧率等。2. 视频编辑通过添加视频拼接和视频叠加模块,我们可以实现视频剪辑功能。比... GPU加速BMF完整支持GPU硬件,提供CPU到GPU的数据传输。我们可以实现视频解码和视频过滤等任务的GPU加速,显著提升处理效率。它还支持不同框架如CUDA和OpenCL之间的异构计算。从这些建议简单实验开始, 开发者就...

【高效视频处理】体验火山引擎多媒体处理框架 BMF |社区征文

我编写了一些支持 GPU 加速的代码片段,并通过比较 CPU 和 GPU 环境下的运行时间,验证了 GPU 加速的实际效果。## 代码分析以下是 BMF 的一部分示例代码,展示了如何利用 BMF 进行简单的视频处理,以及如何利用 GPU 加速进行优化。创建了一个视频处理管道,依次添加了视频输入、转码和输出模块。通过简单的几行代码,就可以完成一个基本的视频处理流程。为了充分发挥 GPU 加速的优势,可以在创建模块时指定使用GPU。```import bm...

2022技术盘点之平台云原生架构演进之道|社区征文

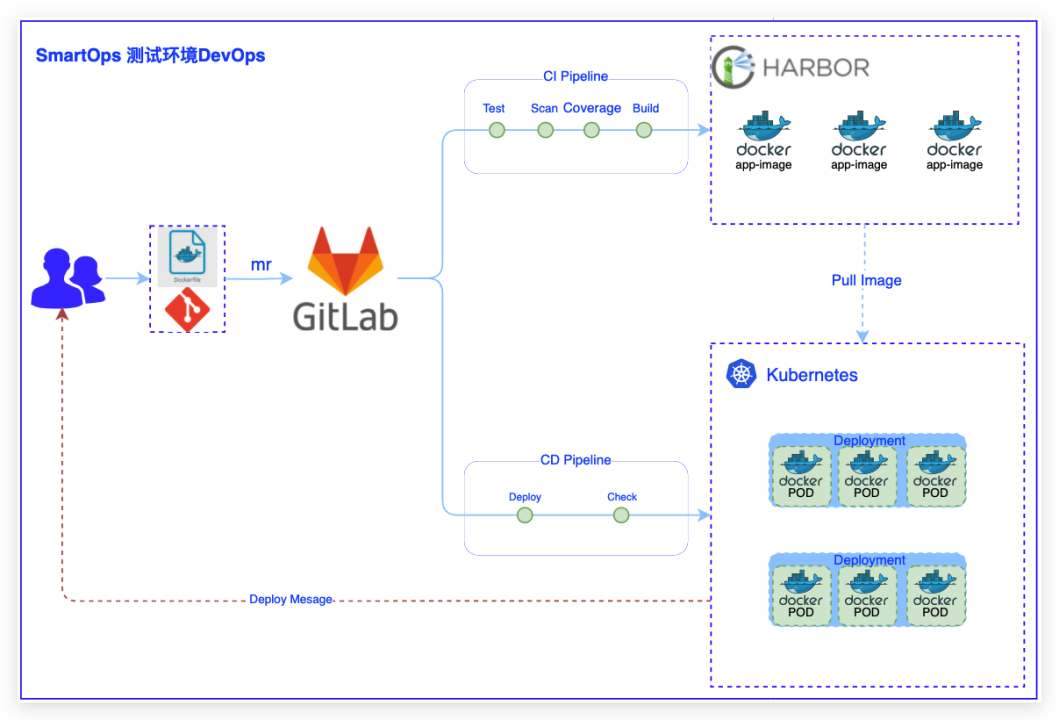

加速企业的数字化转型。## 二 高可用架构云的时代需要新的技术架构,来帮助企业应用能够更好地利用云计算优势,充分释放云计算的技术红利,让业务更敏捷、成本更低的同时又可伸缩性更灵活,而这些正好就是云原生架... 起初DevOps使用Gitlab CI进行管控。- CI/CD:各业务代码仓库保护.gitlab.yml,利用Gitlab CI进行CI和CD过程...

特惠活动

特惠活动

怎么使用CUDA加速c代码-优选内容

怎么使用CUDA加速c代码-优选内容

怎么使用CUDA加速c代码-相关内容

怎么使用CUDA加速c代码-相关内容

GPU-基于Diffusers和Gradio搭建SDXL推理应用

Pytorch:开源的Python机器学习库,实现强大的GPU加速的同时还支持动态神经网络。本文以2.0.0为例。Pytorch使用CUDA进行GPU加速时,在GPU驱动已经安装的情况下,依然不能使用,很可能是版本不匹配的问题,请严格关注虚拟... 下载Anaconda安装包。wget https://repo.anaconda.com/archive/Anaconda3-2022.05-Linux-x86_64.sh 执行以下命令,静默安装Anaconda。 在静默模式下安装Anaconda时,将使用默认设置,包括安装路径(/root/anaconda3)和...

GPU-部署ChatGLM-6B模型

CUDA版本 ≥ 11.4。 NVIDIA驱动:GPU驱动:用来驱动NVIDIA GPU卡的程序。本文以535.86.10为例。 CUDA:使GPU能够解决复杂计算问题的计算平台。本文以CUDA 12.2为例。 CUDNN:深度神经网络库,用于实现高性能GPU加速。本... 下载ChatGLM2-6B大模型的权重文件。 git clone https://huggingface.co/THUDM/chatglm2-6b 执行以下命令,下载官方示例代码。git clone https://github.com/THUDM/ChatGLM2-6B 依次执行以下命令,安装相应的依赖包...

集简云本周更新:流程模版中心上线,新增应用:千米网,App评论订阅

流程配置中需要的样本与字段设置默认设置好,只需要添加自己的应用帐号保存即可开启您的自动化流程。  [金数据表单+企业微信加速团队协作效率](https://thoug...

GPU推理服务性能优化之路

最终通过两项关键的技术: 1.Python的GPU与CPU进程分离,2.使用TensorRT对模型进行加速,使得线上大部分模型服务QPS提升5-10倍左右,大量节约了线上GPU推理服务的成本。针对上面的两项关键技术,我们还自研了相关框架... CUDA Stream流:Cuda stream是指一堆异步的cuda操作,他们按照host代码调用的顺序执行在device上。典型的CUDA代码执行流程:a.将数据从Host端copy到Device端。b.在Device上执行kernel。c.将结果从Device段cop...

GPU-部署Baichuan大语言模型

CUDA版本 ≥ 11.8。 NVIDIA驱动:GPU驱动:用来驱动NVIDIA GPU卡的程序。本文以535.86.10为例。 CUDA:使GPU能够解决复杂计算问题的计算平台。本文以CUDA 12.2为例。 CUDNN:深度神经网络库,用于实现高性能GPU加速。本... 官方的权重文件保存在huggingface仓库。 git clone https://huggingface.co/baichuan-inc/Baichuan-13B-Chat 执行以下命令,克隆官方示例代码。git clone https://github.com/baichuan-inc/Baichuan-13B.git 依次...

探索云原生化的服务架构体系的技术风向,攻克云原生化微服务架构的痛点和特性 | 社区征文

随着云原生架构的加速演进,更充分释放了云的潜力。,...

火山引擎大规模机器学习平台架构设计与应用实践

ce6d&x-expires=1714407643&x-signature=YgsCRAUVHz1DcLmqEbvVxCVZY6I%3D) 本文主要介绍了火山引擎云原生机器学习平台在高性能计算和存储的规模化调度上的架构设计,如何对模型分布式训练进行加速,... 在使用一些框架的时候我们希望读写存储能够像读本地文件一样方便,这就需要存储接口友好,代码零修改,兼容 POSIX。同时能便捷传输,方便数据上云下云。有一些客户对安全性有要求,客户之间的存储要进行隔离。* 存储的...

查询调度实例详情

调用本接口查询某个调度实例的详情,包括调度实例的基本信息、加速域名地址池(即“加速 CNAME 地址池”等),以及调度实例下当前生效的调度策略的信息等。 使用说明每个请求中必须包含鉴权信息。该鉴权信息用以验证请... webCreatedAtLong调度实例的创建时间。格式为 Unix 时间戳,单位为秒。1704383825WeightInfosObject[]调度实例下当前生效的调度策略的信息列表。CountryString调度区域所属国家或地区的代码。您可以调用 ListViews ...