服务器如何配置CUDA

社区干货

社区干货

Linux安装CUDA

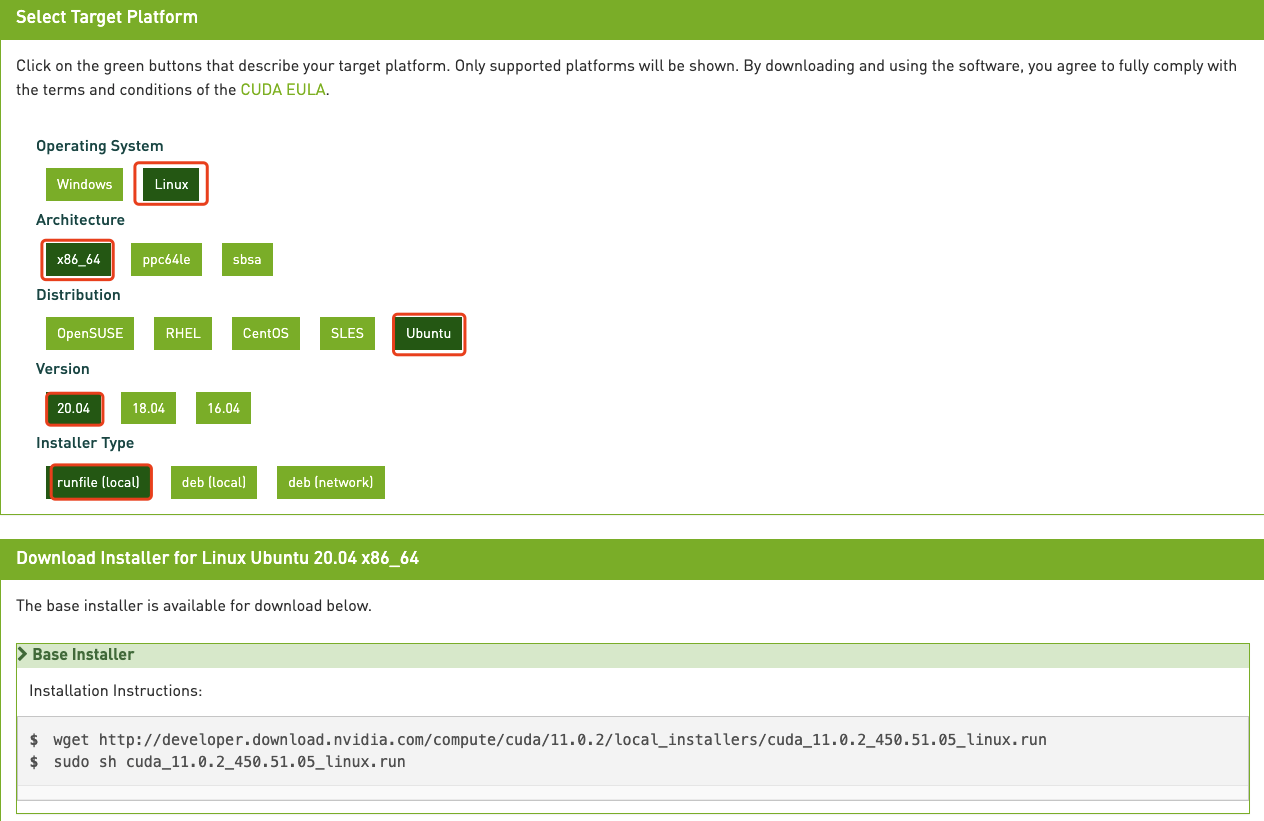

# 运行环境* CentOS* RHEL* Ubuntu* OpenSUSE# 问题描述初始创建的火山引擎实例并没有安装相关cuda软件,需要手动安装。# 解决方案1. 确认驱动版本,以及与驱动匹配的cuda版本,执行命令`nvidia-smi`显示如... 用户需要根据自身操作系统以及网络条件来选择相关配置项,生成不同的安装命令,此处演示为Ubu...

nvidia-cuda镜像

CUDA® (NVIDIA 的开创性并行编程模型)之上,提供对于深度学习、机器学习和高性能计算 (HPC) 必不可少的优化功能。下载地址:- 火山引擎访问地址:https://mirrors.ivolces.com/nvidia_all/- 公网访问地址:https://mirrors.volces.com/nvidia_all/## 相关链接官方主页:[https://www.nvidia.cn/technologies/cuda-x/](https://www.nvidia.cn/technologies/cuda-x/?spm=a2c6h.13651104.0.0.14626225PGZDBA)官方配置文档:[ht...

海量笔记@在云上,如何搭建属于自己的全文搜索引擎 Web应用-个人站点 | 社区征文

服务器配置(物理机or虚拟机or云主机)还可选择更高配些! Ok,now,有了这些前提条件,接下来开始**安装部署**我们**译点笔记应用**-所需要的**服务组件**: ## 系统环境准备**系统环境**首先,在云后台-... yum install mysql-server示例:包不存在(镜像站RPM或源码编译方式)通过wget方式下载repo源:wget http://repo.mysql.com/mysql-community-***.***.rpm安装:rpmrpm -ivh mysql-community-***.***.rpm安装:mysql...

【高效视频处理】体验火山引擎多媒体处理框架 BMF |社区征文

我在一台配备 NVIDIA GPU 的 Linux 服务器上进行了部署。确保系统环境中已经安装了必要的 GPU 驱动和 CUDA 工具包,这对于 BMF 的 GPU 加速至关重要。- Windows 平台——虽然 Windows 不是 BMF 的主要开发平台,但... 通过在模块中设置 `use_gpu=True` 参数,即可启用 GPU 加速。这里展示的是一个简单的例子,实际项目中,可以根据需求添加更多的处理模块,构建复杂的处理流程。BMF 提供了详细的文档和示例代码,方便开发人员更深入地理...

特惠活动

特惠活动

服务器如何配置CUDA-优选内容

服务器如何配置CUDA-优选内容

服务器如何配置CUDA-相关内容

服务器如何配置CUDA-相关内容

GPU-部署Baichuan大语言模型

本文以搭载了一张A10显卡的ecs.gni2.3xlarge实例为例,介绍如何在GPU云服务器上部署Baichuan大语言模型。 背景信息Baichuan-13B是包含130亿参数的开源可商用的大语言模型,在知识问答、聊天、逻辑推理、总结摘要等场... 需保证CUDA版本 ≥ 11.8。 NVIDIA驱动:GPU驱动:用来驱动NVIDIA GPU卡的程序。本文以535.86.10为例。 CUDA:使GPU能够解决复杂计算问题的计算平台。本文以CUDA 12.2为例。 CUDNN:深度神经网络库,用于实现高性能GPU加...

GPU-使用Llama.cpp量化Llama2模型

本文以搭载了一张V100显卡的ecs.g1ve.2xlarge实例,介绍如何在云服务器上利用Llama.cpp执行Llama2-7B模型的量化,并对比基于CPU的推理和基于GPU的推理速度。 背景信息Llama.cpp简介Llama.cpp是使用C++语言编写的大模型量化工具,同时也提供了部署和运行量化后模型的demo。它基于GGML(一种机器学习张量库),实现了对Llama模型的量化、推理部署功能。旨在实现开源大模型运行于相对低配置或廉价的硬件之上,它能支持将Llama模型推理部署至...

后端服务器组FAQ

添加后端服务器时是否支持选择其他VPC下的云服务器? 操作使用删除后端服务器后多久CLB实例会将已有的连接断开? 为什么配置了黑/白名单后,客户端仍然可以访问后端服务器? 后端服务器如何被认为是健康的? 为什么100开头的IP在频繁的访问后端服务器? 后端服务器权重修改后多久生效? 负载均衡后端服务器的安全组应该如何配置? 后端服务器能否获取客户端访问七层监听器的协议版本? 后端服务器权重设置为0与移除该后端服务器有什么区...

【高效视频处理】体验火山引擎多媒体处理框架 BMF |社区征文

我在一台配备 NVIDIA GPU 的 Linux 服务器上进行了部署。确保系统环境中已经安装了必要的 GPU 驱动和 CUDA 工具包,这对于 BMF 的 GPU 加速至关重要。- Windows 平台——虽然 Windows 不是 BMF 的主要开发平台,但... 通过在模块中设置 `use_gpu=True` 参数,即可启用 GPU 加速。这里展示的是一个简单的例子,实际项目中,可以根据需求添加更多的处理模块,构建复杂的处理流程。BMF 提供了详细的文档和示例代码,方便开发人员更深入地理...

(基础)保姆级指南!手动在火山引擎云服务器中搭建幻兽帕鲁服务器

购买了云服务器。2. 参考[配置安全组](https://developer.volcengine.com/articles/7328448271943204927#heading2)指引,在安全组入方向中放通了`UDP`协议的`8211`端口。## 手动搭建Palworld服务器### 在linu... 6. 将Palworld服务器进程创建为自定义服务。 1. 执行如下命令,创建并进入palworld服务文件。 ``` vim /etc/systemd/system/pal-world-server.service ``` 2. 按`i`键...

使用火山引擎搭建幻兽帕鲁&雾锁王国游戏联机服务器常见问题指南

以上配置的预估费用,在创建实例时可实时看到。 #### **问题4:已创建的** **云服务器** **实例在产品控制台找不到?****参考回答:**点击控制台左侧边栏“实例与镜像”--“实例”,可以查看已部署的实例列表... #### 问题8:怎么迁移其他云服务器的存档至火山引擎的幻兽帕鲁服务器?两边都是Linux服务器吗?如果是的话可以参考如下操作:1. 远程登录到原服务器上。2. 找到幻兽帕鲁服务端存档地址,比如:/home/steam/Steam...

(进阶~)保姆级指南!通过脚本(非Docker版)快速搭建幻兽帕鲁服务器

购买了云服务器。2. 参考[配置安全组](https://developer.volcengine.com/articles/7328448271943204927#heading2)指引,在安全组入方向中放通了`UDP`协议的`8211`端口。## 通过脚本(非Docker版)搭建Palworld服... 在云服务器中执行如下命令,进行更新操作。 ``` sudo systemctl stop pal-world-server.service sudo -u steam $(which steamcmd) +login anonymous +app_update 2394010 validate +quit ``` ...

GPU在Kubernetes中的使用与管理 | 社区征文

对于GPU资源只能设置`limit`,这意味着`requests`不可以单独使用,要么只设置`limit`、要么同时设置二者,但二者值必须相等,不可以只设置`request`而不设置`limit`。- pod及容器之间,不可以共享GPU,且GPU也不可... name: cuda-vector-addspec: restartPolicy: OnFailure containers: - name: cuda-vector-add # https://github.com/kubernetes/kubernetes/blob/v1.7.11/test/images/nvidia-cuda/Dockerfile ...

单协议任务高级配置

本文为您介绍如何进行单协议任务的高级配置。 操作背景当您创建单协议任务或更新一个单协议任务时,根据业务场景需要进行定制化的配置(如设置访问服务器的类型、更新HTTP版本等操作),可参考本部分内容。 操作步骤在创建拨测任务页面,找到高级配置模块。 在高级配置模块,点击展开查看。 根据实际业务需要完成具体的配置工作。更多参见不同拨测方式的高级配置说明。说明 单协议任务中不同的监测方式需要配置的信息有所区别,请根据当...