服务器配置p100gpu

社区干货

社区干货

【图说产品】初见GPU云服务器 - 专业图像处理、人工智能算法训练及推理的“加速器”

GPU云服务器(GPUCloudComputing,GPU)是提供GPU算力的弹性计算服务,具有高效稳定的计算能力,适用于生成式AI、自动驾驶、图像处理、科学计算等多种应用场景。

WebRTC 服务器架构 | 社区征文

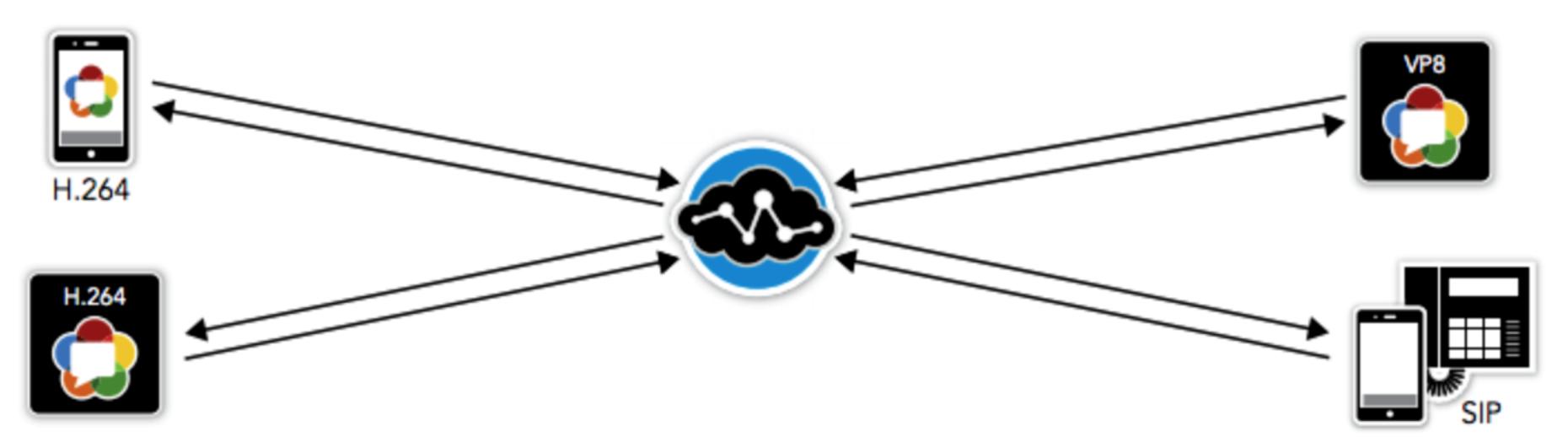

肯定少不了服务器的支持。目前,WebRTC 主要有三种网络架构:Mesh、MCU、SFU。今天就来分别介绍一下三者,带大家认识一下它们的优点和缺点。# 正文## 1. Mesh(P2P)### 简介 Mesh 服务器架构其实就是标准 P2P ... 由服务端来抵消移动端的资源消耗。### 缺点**a. 对服务器压力最大。** MCU ...

弹性容器实例:从节点中心转型 Serverless 化架构的利器

以充分发挥 Serverless 的优势及价值。# **从节点中心到 Serverless 化架构**传统 Kubernetes 架构一般以节点为中心,即技术团队需要基于云服务器等资源节点搭建集群,并围绕节点进行运维管理的传统 Kubernetes ... 具体包括节点的配置与初始化、操作系统更新与升级、安全性管理、运行监控与日志采集分析、故障恢复、网络管理、存储管理、扩缩容、资源规划与分配,以及资源成本管理等复杂且繁琐的节点运维工作;* **资源利用率低*...

基于边缘计算 Client-Edge-Server 业务模型实践

近期,以 **《极致体验,揭秘抖音背后的音视频技术》** 为主题字节跳动第五期技术沙龙圆满落幕。在沙龙中,火山引擎边缘计算产品解决方案架构师王琦从架构的角度,跟大家探讨了 Client-Edge-Server 云边端架构(以下简称... 后端即服务端,在其架构演进中,系统容量、可用性等一直是衡量其架构设计的关键因素。随着分布式架构理念的落地,通过集群部署代替单点部署,提升系统容量和可用性;再后来将服务端做上云部署,通过云服务的弹性、敏捷特...

特惠活动

特惠活动

服务器配置p100gpu-优选内容

服务器配置p100gpu-优选内容

服务器配置p100gpu-相关内容

服务器配置p100gpu-相关内容

【图说产品】初见GPU云服务器 - 专业图像处理、人工智能算法训练及推理的“加速器”

GPU云服务器(GPUCloudComputing,GPU)是提供GPU算力的弹性计算服务,具有高效稳定的计算能力,适用于生成式AI、自动驾驶、图像处理、科学计算等多种应用场景。

GPU-部署ChatGLM-6B模型

本文以搭载了一张A10显卡的ecs.gni2.3xlarge实例为例,介绍如何在GPU云服务器上部署ChatGLM-6B大语言模型。 背景信息ChatGLM-6B是一个具有62亿参数的、支持中英双语问答的对话语言模型,基于General Language Model(... 参考本地数据上传到GPU实例中。 操作步骤步骤一:创建GPU计算型实例请参考通过向导购买实例创建一台符合以下条件的实例: 基础配置:计算规格:ecs.gni2.3xlarge 镜像:Ubuntu 20.04,不勾选“后台自动安装GPU驱动”。 存...

GPU实例硬件相关FAQ发布

GPU实例相比普通云服务器实例,增加了较多的外设,包括GPU、RDMA网络直通网卡、本地盘等。因此,除普通云服务器可能发生的常见问题外,还有如GPU、直通网卡及PCIe链路上发生的亚健康或故障,围绕GPU实例的常见故障,梳理处理建议和FAQ,提升用户体验。 具体内容请参考GPU实例硬件相关FAQ。

GPU-部署基于DeepSpeed-Chat的行业大模型

本文以搭载了一张A100显卡的ecs.pni2.3xlarge为例,介绍如何在GPU云服务器上进行DeepSpeed-Chat模型的微调训练。 背景信息DeepSpeed-Chat简介 DeepSpeed-Chat是微软新公布的用来训练类ChatGPT模型的一套代码,该套代... 参考本地数据上传到GPU实例中。 步骤一:准备环境创建GPU计算型实例请参考通过向导购买实例创建一台符合以下条件的实例: 基础配置:计算规格:ecs.pni2.3xlarge 镜像:Ubuntu 20.04 with GPU Driver。该镜像已默认安装...

GPU-使用Llama.cpp量化Llama2模型

本文以搭载了一张V100显卡的ecs.g1ve.2xlarge实例,介绍如何在云服务器上利用Llama.cpp执行Llama2-7B模型的量化,并对比基于CPU的推理和基于GPU的推理速度。 背景信息Llama.cpp简介Llama.cpp是使用C++语言编写的大模型量化工具,同时也提供了部署和运行量化后模型的demo。它基于GGML(一种机器学习张量库),实现了对Llama模型的量化、推理部署功能。旨在实现开源大模型运行于相对低配置或廉价的硬件之上,它能支持将Llama模型推理部署至...

GPU-基于Diffusers和Gradio搭建SDXL推理应用

本文以搭载了一张V100显卡的ecs.g1ve.2xlarge实例,介绍如何在GPU云服务器上基于Diffusers搭建SDXL 1.0的base + refiner组合模型。 背景信息SDXL Stable Diffusion XL(简称SDXL)是最新的图像生成模型,与之前的SD模型... 参考本地数据上传到GPU实例中。 操作步骤步骤一:创建实例请参考通过向导购买实例创建一台符合以下条件的实例: 基础配置:计算规格:ecs.g1ve.2xlarge 镜像:Ubuntu 20.04,并勾选“后台自动安装GPU驱动”。 存储:云盘容...

安装GPU驱动

背景信息GPU云服务器正常工作需提前安装正确的基础设施软件,对NVIDIA Tesla系列的GPU而言,有以下两个层次的软件包需要安装: 驱动GPU工作的硬件驱动程序。 上层应用程序所需要的库。 在通用计算场景下,如深度学习、... 本文以Tesla T4安装CUDA 12.2对应的GPU驱动版本为例,如下图所示。 配置项 说明 示例 产品类型 产品系列 产品家族 根据实例规格配备的GPU卡进行选择。详情请参见实例规格介绍。 Data Center / Tesla T-Series Tes...

GPU云服务器-火山引擎

GPU云服务器(GPU Compute service)是提供 GPU 算力的弹性计算服务,拥有超强的计算能力,能高效服务于机器学习、科学计算、图形处理、视频编解码等多种场景。火山引擎为您提供随时可取的弹性算力,有效应对计算需求,提升业务效率及竞争力

GPU实例硬件相关FAQ

如何判断和处理硬件相关故障?GPU实例相比普通云服务器实例,增加了较多的外设,包括GPU、RDMA网络直通网卡、本地盘等。因此,除普通云服务器可能发生的常见问题外,还有如GPU、直通网卡以及PCIe链路上发生的亚健康或故障。针对GPU实例的常见故障和处理建议具体如图1所示。 图1 常见故障及处理建议 图2 故障处理流程GPU亚健康或故障处理流程如图2所示,以下重点介绍亚健康现象的处理流程。 除亚健康外的其它故障现象,您可以通过工单系统...