深度学习处理器芯片

社区干货

社区干货

个人年度总结:深度学习与AIGC技术在智能诗歌生成中的应|社区征文

其中深度学习模型不断完善、开源模式的推动、大模型探索商业化的可能,成为 AIGC 发展的“加速度”。# “智能诗歌生成”的AIGC项目我曾参与了一个名为“智能诗歌生成”的AIGC项目。该项目的主要目标是利用人工智... **模型训练:** 我们采用了基于循环神经网络(RNN)的生成模型进行训练。该模型接受诗歌的特征作为输入,并输出下一行诗歌的词向量序列。在训练过程中,我们使用了变分自编码器(VAE)来引入潜在变量,以捕捉诗歌的潜在分布...

写给Android开发者的芯片知识| 社区征文

作为 Android 开发者,免不了要处理 arm、armv7a、armv8a、x86 等架构适配,加上今年各个行业都遇到了“缺芯”的困扰,以及美国对华为的芯片制裁,制裁的是什么技术?本文尝试讲清楚下面几个问题:1. Android动态库适配到底在适配什么?2. CPU、架构、指令集、芯片之间的关系和联系;3. armv7a中的a指什么?4. 芯片的核心技术和门槛是什么?## CPU接触过计算机的朋友们都知道CPU的含义,就是中央处理器,是负责计算机主要运算任务...

字节跳动智能音频信号处理的应用实践

深度学习和心理声学技术的发展也大大加速了多模态音视频信号处理技术的发展,保证了声音效果。- 有了这些基础就可以为上层业务,比如声场还原、人机交互、音视频处理等提供更高质量的音频。介绍了音频信号的几个组成部分,下面我们来看一下音频信号技术的整体发展趋势。当提到音频信号处理时,不可避免地会提到贝尔实验室。贝尔实验室在 1979 年发明了系统单片机型的数字信号处理器(SoC DSP,用于调制解调器、无线电话等),从而...

关于 AI 边云协同解决方案在 IOT 领域的研究与讨论 | 社区征文

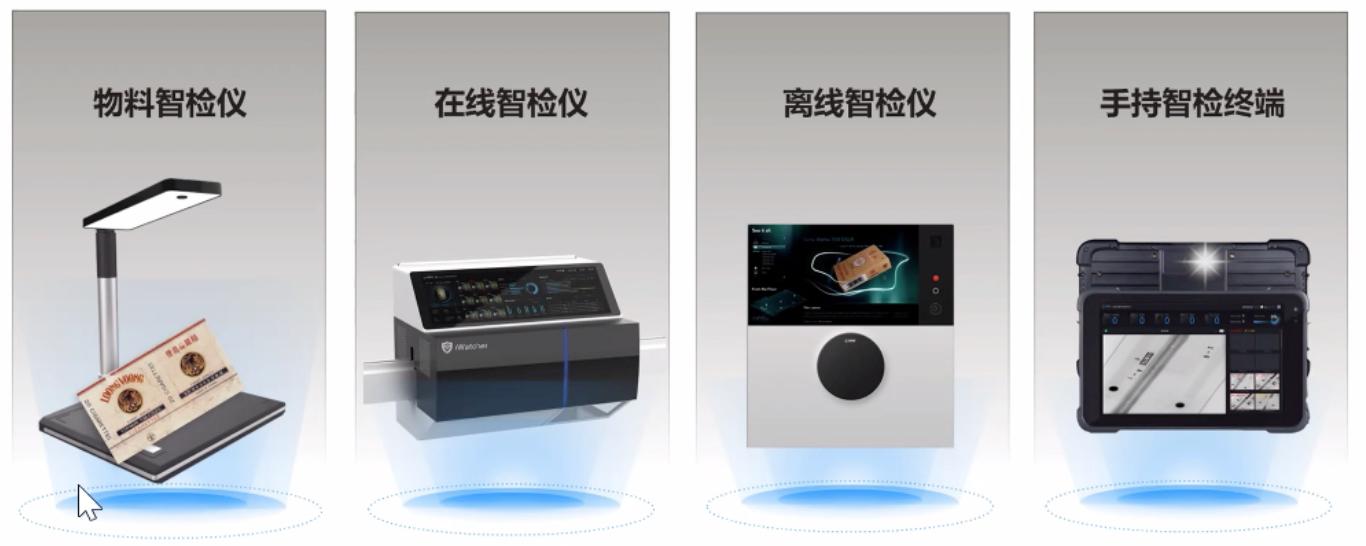

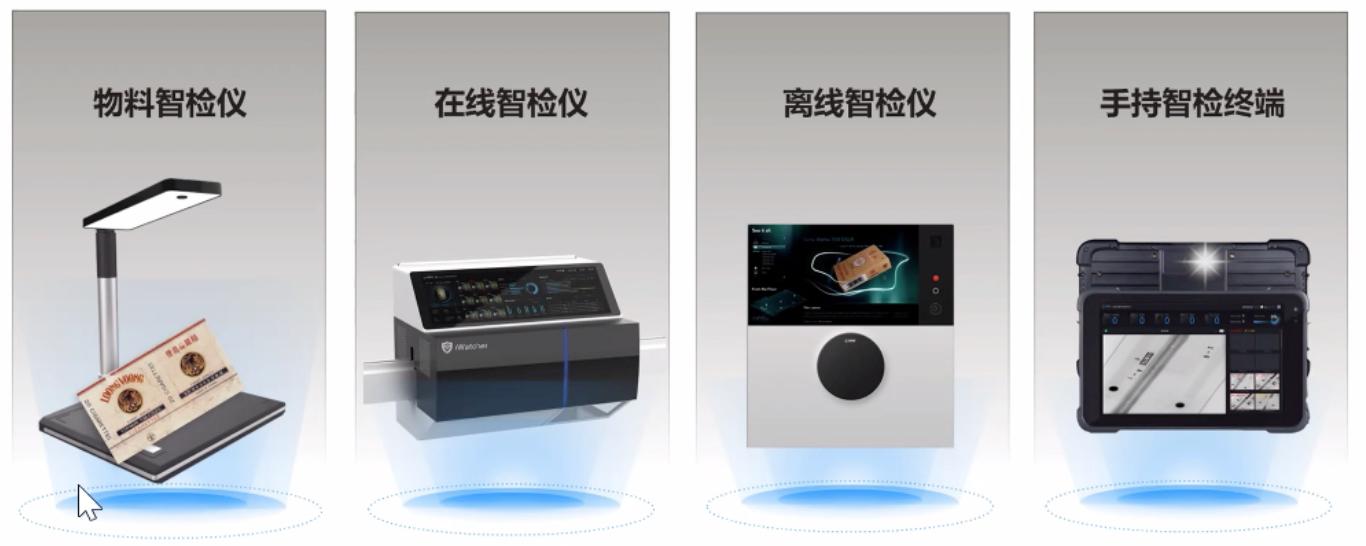

集成专业升腾芯片,多 CPU 处理器,内置内存及高速固态硬盘。超强大脑,深度学习算法,有效提升识别率,机器训练,随机缺陷全面覆盖,相机、光源等设置方案智能切换。极致体验,全封闭一体化设计,超宽一体触摸屏,一览无余,结构合理美观,零进入风险。边缘质检终端,多模式兼容、多场景兼顾,可以根据实...

特惠活动

特惠活动

深度学习处理器芯片-优选内容

深度学习处理器芯片-优选内容

深度学习处理器芯片-相关内容

深度学习处理器芯片-相关内容

关于 AI 边云协同解决方案在 IOT 领域的研究与讨论 | 社区征文

集成专业升腾芯片,多 CPU 处理器,内置内存及高速固态硬盘。超强大脑,深度学习算法,有效提升识别率,机器训练,随机缺陷全面覆盖,相机、光源等设置方案智能切换。极致体验,全封闭一体化设计,超宽一体触摸屏,一览无余,结构合理美观,零进入风险。边缘质检终端,多模式兼容、多场景兼顾,可以根据实...

即将停售的实例规格

全核睿频3.1 GHz 处理器与内存配比为1:4 最大支持88 vCPU,352 GiB GPU显卡:NVIDIA Tesla V100(单卡32 GB显存),单台实例最多支持挂载8张显卡 存储 性能型SSD云盘 存储I/O性能与计算规格相关,规格越高,性能越强 网络 最大网络带宽:25 Gbit/s 最大网络收发包:350 万PPS 网络性能与计算规格相关,规格越高,性能越强 适用场景 深度学习,例如图像分类、无人驾驶、语音识别等人工智能算法的训练应用。 科学计算,例如计算流体动力学、计算...

即将停售的实例规格

全核睿频3.1 GHz 处理器与内存配比为1:4 最大支持88 vCPU,352 GiB GPU显卡:NVIDIA Tesla V100(单卡32 GB显存),单台实例最多支持挂载8张显卡 存储 性能型SSD云盘 存储I/O性能与计算规格相关,规格越高,性能越强 网络 最大网络带宽:25 Gbit/s 最大网络收发包:350 万PPS 网络性能与计算规格相关,规格越高,性能越强 适用场景 深度学习,例如图像分类、无人驾驶、语音识别等人工智能算法的训练应用。 科学计算,例如计算流体动力学、计算...

字节跳动 EB 级 Iceberg 数据湖的机器学习应用与优化

> 深度学习的模型规模越来越庞大,其训练数据量级也成倍增长,这对海量训练数据的存储方案也提出了更高的要求:怎样更高性能地读取训练样本、不使数据读取成为模型训练的瓶颈,怎样更高效地支持特征工程、更便捷地增删... 随着芯片技术的迭代和算力的增长,训练模型所需的计算资源也在不断提升。然而如果样本的读取速度无法跟上算力的增长就会成为训练过程中的瓶颈,限制算力资源的有效利用率。所以我们需要寻找方法来提高样本的读取吞吐...

火山引擎AI4S全场景产品和方案能力首发,三层架构加速AI与传统科学融合

芯片、材料、工业制造、教育、医疗等行业的产融新模式。 清华大学生命学院教授、中国生物信息学终身成就奖获得者、中国生物信息学学会筹备委员会核心组负责人孙之荣在大会致辞中表示,近年来,Al for Science技术成果... 不仅是深度学习领域的重大突破,也为生物信息学带来了新的机遇。清华大学生命学院教授、中国生物信息学终身成就奖获得者、中国生物信息学学会筹备委员会核心组负责人孙之荣 中国科学院新科院士、国家特聘教授,长江学...

搭建SDXL-Turbo模型文生图推理

本文主要介绍如何在云服务器实例中部署Stable Diffusion XL Turbo模型,并使用CPU加速文生图推理。 功能特色本实践使用了火山引擎第3代云服务器通用型g3i,该规格实例采用火山引擎自研最新DPU架构并搭载了第5代英特尔... 大幅度提升了使用PyTorch在Intel处理器上运行AI应用,尤其是深度学习应用的性能。Intel正不断为PyTorch贡献IPEX的优化性能,为PyTorch社区提供最新的Intel硬件和软件改进。更多信息,请参见IPEX。 SDXL-Turbo模型本实...

【MindStudio训练营第一季】MindStudio Profiling随笔

# MindStudio Profiler简介Ascend AI处理器是一款面向AI业务应用的高性能集成芯片,包含AI CPU、A Core、AI Vector Core等计算单元来提升AI任务的运算性能。基于Ascend AI处理器,Mindstudio在算子开发、模型训练及推理应用等不同环节,提供了端到端的`Profiler`工具。该工具可以帮助用户看到模型从应用层到芯片层的接口和算子耗时,从而准确定位系统的软、硬件性能瓶颈,提高性能分析的效率。调优主要分为三步:- 性能数据采集、...

字节跳动 EB 级 Iceberg 数据湖的机器学习应用与优化

深度学习的模型规模越来越庞大,其训练数据量级也成倍增长,这对海量训练数据的存储方案也提出了更高的要求:怎样更高性能地读取训练样本、不使数据读取成为模型训练的瓶颈,怎样更高效地支持特征工程、更便捷地增删和... 随着芯片技术的迭代和算力的增长,训练模型所需的计算资源也在不断提升。然而如果样本的读取速度无法跟上算力的增长就会成为训练过程中的瓶颈,限制算力资源的有效利用率。所以我们需要寻找方法来提高样本的读取吞吐...

部署模型服务

协处理器类型有不同的要求。具体如下表所示。在部署模型服务前,请确保您的一体机与要部署的模型是兼容的。 模型框架 一体机指令集架构要求 一体机协处理器要求 ONNX x86/amd64、arm CPU、GPU TensorRT x86/amd64、... 一体机会自动开始下载并安装对应的深度学习镜像。这个过程可能会根据一体机的网络环境状态,持续大约 5 到 10 分钟。如果一体机已经安装了对应的深度学习镜像,则部署相关模型的时间会缩短。 当模型服务的状态变为...