kafka服务器日志

社区干货

社区干货

Logstash 如何通过 Kafka 协议消费 TLS 日志

# **问题现象**如何通过修改 Logstash 配置文件,实现通过 Kafka 协议消费日志到其他业务系统。# 问题分析TLS 日志服务支持通过 Logstash 消费日志数据,您可以通过配置 Logstash 服务内置的 logstash-input-kafka 插件获取日志服务中的日志数据。# 解决方案## 1.安装 logstash1.1 [下载安装包](https://www.elastic.co/cn/downloads/logstash)。1.2 解压安装包到指定目录。1.3 查看logstash 版本```Java[root@lxb-jms ...

Kafka 消息传递详细研究及代码实现|社区征文

本文将研究 Kafka 从生产、存储到消费消息的详细过程。 ## Producer### 消息发送所有的 Kafka 服务器节点任何时间都能响应是否可用、是否 topic 中的 partition leader,这样生产者就能发送它的请求到服务器... acks = 1:producer 等待 leader 将记录写入本地日志后,在所有 follower 节点反馈之前就先确认成功。若 leader 在接收记录后,follower 复制数据完成前产生错误,则记录可能丢失acks = all:leader 节点会等待所有同...

聊聊 Kafka:Topic 创建流程与源码分析 | 社区征文

## 一、Topic 介绍Topic(主题)类似于文件系统中的文件夹,事件就是该文件夹中的文件。Kafka 中的主题总是多生产者和多订阅者:一个主题可以有零个、一个或多个向其写入事件的生产者,以及零个、一个或多个订阅这些事件的消费者。可以根据需要随时读取主题中的事件——与传统消息传递系统不同,事件在消费后不会被删除。相反,您可以通过每个主题的配置设置来定义 Kafka 应该保留您的事件多长时间,之后旧事件将被丢弃。Kafka 的性能在...

Kafka@记一次修复Kafka分区所在broker宕机故障引发当前分区不可用思考过程 | 社区征文

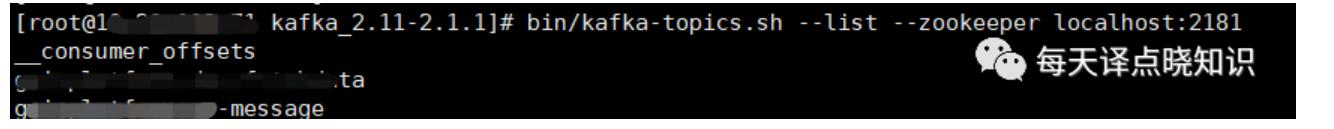

包括不限于改Kafka,主题创建删除,Zookeeper配置信息重启服务等等,于是我们来一起看看... Ok,Now,我们还是先来一步步分析它并解决它,依然以”化解“的方式进行,我们先来看看业务进程中线程报错信息:```jsor... kafka-topics.sh --list --zookeeper localhost:2181```然后,查询topic日志内...

特惠活动

特惠活动

kafka服务器日志-优选内容

kafka服务器日志-优选内容

kafka服务器日志-相关内容

kafka服务器日志-相关内容

从 Kafka 导入数据

日志服务支持 Kafka 数据导入功能,本文档介绍从 Kafka 中导入数据到日志服务的操作步骤。 背景信息日志服务数据导入功能支持将 Kafka 集群的消息数据导入到指定日志主题。Kafka 数据导入功能通常用于业务上云数据迁移等场景,例如将自建 ELK 系统聚合的各类系统日志、应用程序数据导入到日志服务,实现数据的集中存储、查询分析和加工处理。日志服务导入功能支持导入火山引擎消息队列 Kafka 集群和自建 Kafka 集群的数据。创建导入...

OpenKafkaConsumer

调用 OpenKafkaConsumer 接口为指定日志主题开启 Kafka 协议消费功能。 使用说明调用此接口为日志主题开启 Kafka 协议消费功能之后,可以将日志主题作为 Kafka 的 Topic 进行消费,每条日志对应一条 Kafka 消息。通过 Kafka 协议消费日志具体方式和配置请参考通过 Kafka 协议消费日志。此接口调用频率限制为 20 次/s,超出频率限制会报错 ExceedQPSLimit。 说明 消费日志时会产生私网或公网的读流量。价格信息请参考计费指引。 关闭...

管理 Kafka 投递配置

成功创建日志投递配置后,您可以在投递配置列表查看并管理 Kafka 投递配置,例如修改投递配置,暂停或启动日志投递等。 修改投递配置成功创建投递配置后,您可以在日志投递页面的投递配置列表中查看投递配置的基本信息,也可以单击投递配置名称,查看投递配置的详细配置,或根据需求随时修改投递配置的各项参数配置。操作步骤如下: 登录日志服务控制台。 在左侧导航栏中选择日志服务 > 日志项目管理。 找到指定的日志项目,单击项目名称。...

通过 ByteHouse 消费日志

ByteHouse(云数仓版)支持通过 Kafka 流式传输数据。本文档介绍如何将日志服务中的日志数据通过 Kafka 协议消费到 ByteHouse。 背景信息日志服务支持通过 Kafka 协议消费指定日志主题中的日志数据,例如消费到 ByteHouse(云数仓版)中进行进一步的分析处理。在 ByteHouse 中创建 Kafka 数据导入任务之后,可以直接通过 Kafka 流式传输数据。数据导入任务将自动运行,持续读取日志主题中的日志数据,并将其写入到指定的数据库表中。消费...

DescribeKafkaConsumer

调用 DescribeKafkaConsumer 查看指定日志主题的 Kafka 消费功能状态。 使用说明此接口调用频率限制为 20 次/s,超出频率限制会报错 ExceedQPSLimit。 请求说明请求方式:GET 请求地址:https://tls-{Region}.ivolces.com/DescribeKafkaConsumer 请求参数下表仅列出该接口特有的请求参数和部分公共参数。更多信息请见公共参数。 Query参数 类型 是否必选 示例值 描述 TopicId String 是 c7e0e442-19bf-4fb3-b547-5992fb8b**** 日志主...

接入 Filebeat

Input 在指定的位置中查找日志数据。 Filebeat 会为每个找到的日志启动 Harvester,Harvester 读取日志并将日志数据发送到 libbeat。 libbeat 聚集数据,然后将聚集的数据发送到配置的 Output。 如需了解 Filebeat 更多信息,请参考开源文档Filebeat 概述、Filebeat 快速入门-安装与配置、Filebeat 工作原理。 前提条件本文介绍在 Filebeat 中接入消息队列 Kafka版,要求用于安装 Filebeat 的云服务器和 Kafka 实例两者的所处地域、所...

服务日志字段

本文档介绍各种日志类型对应的字段信息。 服务日志类型日志服务提供的服务日志类型如下: 日志类型 对应功能 存储位置(Topic) 说明 数据导入运行日志 TOS 数据导入 Kafka 数据导入 tls_import-task TOS 或 K... SendSuccessLogCount 发送成功的日志条数。 SendDropLogSize 因发送失败而丢弃的日志总量,单位为 Byte。 SendDropLogCount 因发送失败而丢弃的日志条数。 SendTotalReqs 向服务端发送的总请求数。 SendS...

Logstash 如何通过 Kafka 协议消费 TLS 日志

# **问题现象**如何通过修改 Logstash 配置文件,实现通过 Kafka 协议消费日志到其他业务系统。# 问题分析TLS 日志服务支持通过 Logstash 消费日志数据,您可以通过配置 Logstash 服务内置的 logstash-input-kafka 插件获取日志服务中的日志数据。# 解决方案## 1.安装 logstash1.1 [下载安装包](https://www.elastic.co/cn/downloads/logstash)。1.2 解压安装包到指定目录。1.3 查看logstash 版本```Java[root@lxb-jms ...

CloseKafkaConsumer

调用 CloseKafkaConsumer 关闭指定日志主题的 Kafka 协议消费功能。 使用说明停止消费后,您可以调用此接口关闭 Kafka 协议消费功能。此接口调用频率限制为 20 次/s,超出频率限制会报错 ExceedQPSLimit。 请求说明请求方式:PUT 请求地址:https://tls-{Region}.ivolces.com/CloseKafkaConsumer 请求参数下表仅列出该接口特有的请求参数和部分公共参数。更多信息请见公共参数。 Body参数 类型 是否必选 示例值 描述 TopicId String ...