怎么配置cuda环境

社区干货

社区干货

Linux安装CUDA

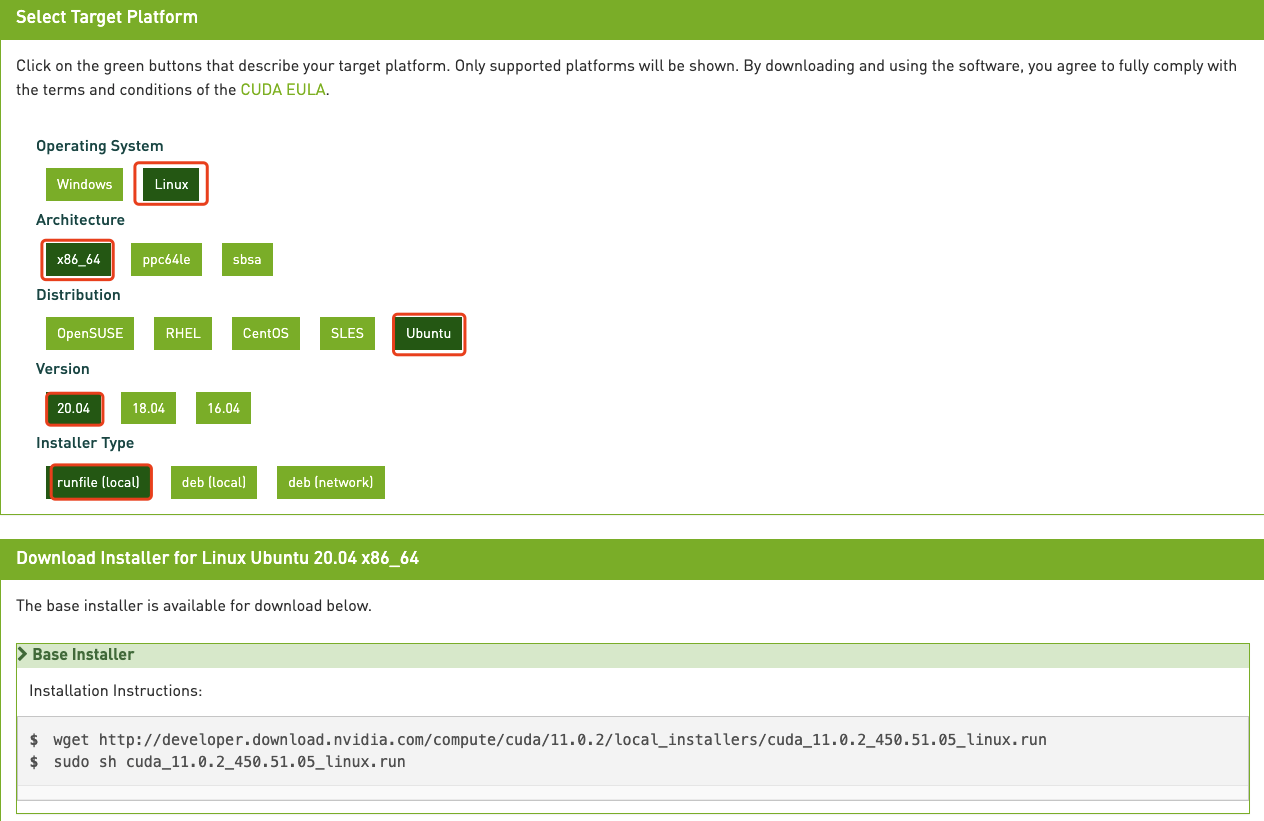

# 运行环境* CentOS* RHEL* Ubuntu* OpenSUSE# 问题描述初始创建的火山引擎实例并没有安装相关cuda软件,需要手动安装。# 解决方案1. 确认驱动版本,以及与驱动匹配的cuda版本,执行命令`nvidia-smi`显示如... 用户需要根据自身操作系统以及网络条件来选择相关配置项,生成不同的安装命令,此处演示为Ubu...

nvidia-cuda镜像

CUDA® (NVIDIA 的开创性并行编程模型)之上,提供对于深度学习、机器学习和高性能计算 (HPC) 必不可少的优化功能。下载地址:- 火山引擎访问地址:https://mirrors.ivolces.com/nvidia_all/- 公网访问地址:https://mirrors.volces.com/nvidia_all/## 相关链接官方主页:[https://www.nvidia.cn/technologies/cuda-x/](https://www.nvidia.cn/technologies/cuda-x/?spm=a2c6h.13651104.0.0.14626225PGZDBA)官方配置文档:[ht...

【高效视频处理】体验火山引擎多媒体处理框架 BMF |社区征文

确保系统环境中已经安装了必要的 GPU 驱动和 CUDA 工具包,这对于 BMF 的 GPU 加速至关重要。- Windows 平台——虽然 Windows 不是 BMF 的主要开发平台,但在某些情况下需要在 Windows 环境中进行部署。我选择了一... 在配置某些特殊模块时,我发现需要更详细和实例化的文档来帮助用户更好地理解和使用框架。以下是一个在使用 GPU 加速的示例代码,展示了文档相对不足的地方。启用了 GPU 加速,但需要用户自行查阅文档获取有关 GPU 加...

GPU推理服务性能优化之路

# 一、背景随着CV算法在业务场景中使用越来越多,给我们带来了新的挑战,需要提升Python推理服务的性能以降低生产环境成本。为此我们深入去研究Python GPU推理服务的工作原理,推理模型优化的方法。最终通过两项关键... CUDA 是 NVIDIA 发明的一种并行计算平台和编程模型。它通过利用图形处理器 (GPU) 的处理能力,可大幅提升计算性能。CUDA的架构中引入了主机端(host, cpu)和设备(device, gpu)的概念。CUDA的Kernel函数既可以运行在...

特惠活动

特惠活动

怎么配置cuda环境-优选内容

怎么配置cuda环境-优选内容

怎么配置cuda环境-相关内容

怎么配置cuda环境-相关内容

GPU实例部署paddlepaddle-gpu环境

本文介绍 GPU 实例部署深度学习Paddle环境。 前言 在ECS GPU实例上部署深度学习Paddle环境。 关于实验 预计实验时间:20分钟级别:初级相关产品:ECS受众: 通用 环境说明 本文测试规格如下:实例规格:ecs.pni2.3xlargeGPU 类型:Tesla A100 80G显存容量:81920MiB实例镜像:velinux - 1.0 with GPU DriverNVIDIA-SMI:470.57.02NVIDIA Driver version:470.57.02CUDA version:11.4CUDA Toolkit version:11.2Python version:Python 3.7.3pa...

GPU-部署Pytorch应用

CUDA 11.4为例。 CUDNN库:深度神经网络库,用于实现高性能GPU加速。本文以8.2.4.15为例。 Anaconda:获取包且对包能够进行管理的工具,包含了conda、Python在内的超过180个科学包及其依赖项,用于创建Python虚拟环境。... 执行source ~/.bashrc命令使配置文件生效。回显如下,表示配置成功,进入base环境。 创建虚拟环境,指定python版本。 执行conda create -n cuda11.4 python=3.8.3命令。其中,cuda11.4表示虚拟环境名称,您可以按需更...

【高效视频处理】体验火山引擎多媒体处理框架 BMF |社区征文

确保系统环境中已经安装了必要的 GPU 驱动和 CUDA 工具包,这对于 BMF 的 GPU 加速至关重要。- Windows 平台——虽然 Windows 不是 BMF 的主要开发平台,但在某些情况下需要在 Windows 环境中进行部署。我选择了一... 在配置某些特殊模块时,我发现需要更详细和实例化的文档来帮助用户更好地理解和使用框架。以下是一个在使用 GPU 加速的示例代码,展示了文档相对不足的地方。启用了 GPU 加速,但需要用户自行查阅文档获取有关 GPU 加...

GPU-部署ChatGLM-6B模型

CUDA:使GPU能够解决复杂计算问题的计算平台。本文以CUDA 12.2为例。 CUDNN:深度神经网络库,用于实现高性能GPU加速。本文以8.5.0.96为例。 运行环境:Transformers:一种神经网络架构,用于语言建模、文本生成和机器... 操作步骤步骤一:创建GPU计算型实例请参考通过向导购买实例创建一台符合以下条件的实例: 基础配置:计算规格:ecs.gni2.3xlarge 镜像:Ubuntu 20.04,不勾选“后台自动安装GPU驱动”。 存储:云盘容量在100 GiB以上。 ...

GPU-部署基于DeepSpeed-Chat的行业大模型

步骤一:准备环境创建GPU计算型实例请参考通过向导购买实例创建一台符合以下条件的实例: 基础配置:计算规格:ecs.pni2.3xlarge 镜像:Ubuntu 20.04 with GPU Driver。该镜像已默认安装Tesla 470.129.06版本的GPU驱动,适配的CUDA版本为11.4,需自行安装。 存储:云盘容量在100 GiB以上。 网络配置:勾选“分配弹性公网IP”。 创建成功后,在实例绑定的安全组中添加入方向规则:放行TCP 6006端口。具体操作请参见修改安全组访问规则。 ...

HPC裸金属-基于NCCL的单机/多机RDMA网络性能测试

具体配置如下表所示,购买实例请参见购买高性能计算GPU型实例。 实例规格 实例数量 镜像类型 驱动安装/版本 是否绑定公网IP ecs.ebmhpcpni2l.32xlarge 2 Ubuntu 20.04 创建实例时勾选“后台自动安装GPU驱动”:系统将自动安装GPU驱动、CUDA和cuDNN库(驱动版本见下图)以及Faric manager安装包。 说明 实例创建完成后您只需启动NVIDIA-Fabric Manager即可。 是,如未绑定,请参见绑定公网IP。 方式一:在虚拟环境中测试网络性能步...

GPU服务器使用

本文将介绍如何创建并使用GPU云服务器。 关于实验 预计部署时间:30分钟 级别:初级 相关产品:GPU云服务器 受众: 通用 环境说明 如果还没有火山引擎账号,点击此链接注册账号 如果您还没有VPC,请先点击链接创建VPC。 ... 点击“下一步:高级配置”。 选择“登录凭证” ---> 输入“登录密码” ---> 输入“实例名称” ---> 点击“下一步:确认订单”。 步骤2:安装CUDA Toolkit具体安装步骤请参英伟达CUDA安装说明 步骤3:安装GPU_BURNGPU_B...

GPU-基于Diffusers和Gradio搭建SDXL推理应用

使配置文件生效。 创建一个名为“sd-xl”的虚拟环境,并指定该环境中的python版本为3.10。 执行conda create -n sd-xl python=3.10命令。 回显Proceed ([y]/n)?时输入“y”确认。 执行以下命令,激活虚拟环境。conda activate sd-xl回显如下,表示激活成功。 执行以下命令,安装git。回显Proceed ([y]/n)?时输入“y”确认安装。conda install git 执行以下命令,安装CUDA 11.8对应的Pytorch。 本文所示“sd-xl”环境中使用的CUDA版...

GPU-部署Baichuan大语言模型

CUDA:使GPU能够解决复杂计算问题的计算平台。本文以CUDA 12.2为例。 CUDNN:深度神经网络库,用于实现高性能GPU加速。本文以8.5.0.96为例。 运行环境:Transformers:一种神经网络架构,用于语言建模、文本生成和机器... 操作步骤步骤一:创建GPU计算型实例请参考通过向导购买实例创建一台符合以下条件的实例: 基础配置:计算规格:ecs.gni2.3xlarge 镜像:Ubuntu 20.04,不勾选“后台自动安装GPU驱动”。 存储:云盘容量在100 GiB以上。 ...