数据仓库标准分层

社区干货

社区干货

浅谈数仓建设及数据治理 | 社区征文

## 一、前言在谈数仓之前,先来看下面几个问题:### 1. 数仓为什么要分层?1. 用空间换时间,通过大量的预处理来提升应用系统的用户体验(效率),因此数据仓库会存在大量冗余的数据;不分层的话,如果源业务系统的业... 高质量的数据是数据可用的前提条件,数据的安全管控是数据可以共享交换的前提条件。##### 3. 数据治理需要IT赋能数据治理不是一堆规范文档的堆砌,而是需要将治理过程中所产生的的规范、流程、标准落地到IT平台上...

火山引擎云原生数据仓库 ByteHouse 技术白皮书 V1.0(上)

> 更多技术交流、求职机会,欢迎关注**字节跳动数据平台微信公众号,回复【1】进入官方交流群** **近日,《火山引擎云原生数据仓库 ByteHouse 技术白皮书》正式发布。** 白皮书简述了 ByteHouse 基于 ClickHous... 支持 ANSI-SQL 2011 标准,TPC-DS 测试集 100%通过率。- UDF:支持 Python UDF/UDAF 创建与管理,补足函数的可扩展性。(Java UDF/UDAF 已在开发中)- 自研优化器:自研 Cost-Based Optimizer,优化多表 JOIN 等复杂...

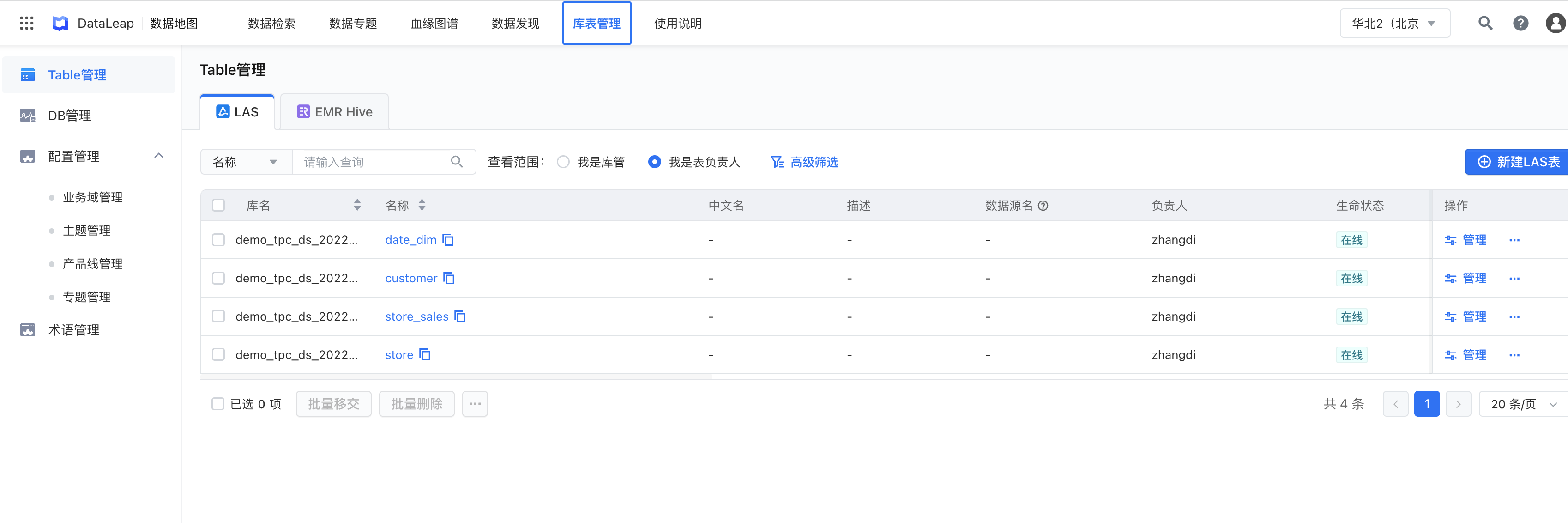

DataLeap数据仓库流程最佳实践

轻度聚合最近三天的数据)* APP (基于DWD或DWM,输出具体报表信息)在“数据地图”中创建数据仓库中要使用到的表:本案例中库信息为:demo_tpc_ds_2022_11_07_59(请结合具体情况修改)## **步骤4:** **数据仓库分层建表**### ODS(数据聚合宽表)```sqlCREATE TABLE demo_tpc_ds_2022_11_07_59.ods_demo_cus...

数仓黄金价值圈: 为什么、是什么、怎么做|社区征文

今天给大家一起分享下有着悠久历史的数据仓库的一些思考由三部分组成为什么,搭建数据仓库是什么,数据仓库定义怎么做,如何搭建数仓# 一:为什么,搭建数据仓库最终目标:**数据驱动资源优化配置,即科学、高效... 都逃脱不了以下的常用分层架构- ODS:操作型数据(Operational Data Store),指结构与源系统基本保持一致的增量或者全量数据。作为DW数据的一个数据准备区,同时又承担基础数据记录历史变化,之所以保留原始数据和线...

特惠活动

特惠活动

数据仓库标准分层-优选内容

数据仓库标准分层-优选内容

数据仓库标准分层-相关内容

数据仓库标准分层-相关内容

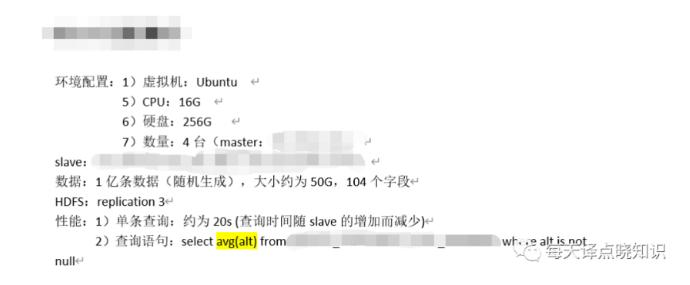

干货 | 看 SparkSQL 如何支撑企业级数仓

本文作者:惊帆 来自于数据平台 EMR 团队# 前言Apache Hive 经过多年的发展,目前基本已经成了业界构建超大规模数据仓库的事实标准和数据处理工具,Hive 已经不单单是一个技术组件,而是一种设计理念。Hive 有 JDB... 数仓在构建的时候通常需要 ETL 处理和分层设计,基于业务系统采集的结构化和非结构化数据进行各种 ETL 处理成为 DWD 层,再基于 DWD 层设计上层的数据模型层,形成 DM,中间会有 DWB/DWS 作为部分中间过程数据。从技...

观点|SparkSQL在企业级数仓建设的优势

**惊帆** 来自 字节跳动数据平台EMR团队EMR 前言Apache Hive 经过多年的发展,目前基本已经成了业界构建超大规模数据仓库的事实标准和数据处理工具,Hive已经不单单是一个技... 数仓在构建的时候通常需要ETL处理和分层设计,基于业务系统采集的结构化和非结构化数据进行各种ETL处理成为DWD层,再基于DWD层设计上层的数据模型层,形成DM,中间会有DWB/DWS作为部分中间过程数据。从技术选型来...

SparkSQL 在企业级数仓建设的优势

**惊帆** 来自 字节跳动数据平台 EMR 团队# 前言Apache Hive 经过多年的发展,目前基本已经成了业界构建超大规模数据仓库的事实标准和数据处理工具,Hive 已经不单单是一个技术组件,而是一种设计理念。Hive 有... 数仓在构建的时候通常需要ETL处理和分层设计,基于业务系统采集的结构化和非结构化数据进行各种ETL处理成为DWD层,再基于DWD层设计上层的数据模型层,形成DM,中间会有DWB/DWS作为部分中间过程数据。从技术选型来说,...

ByteHouse:基于ClickHouse的实时数仓能力升级解读

ByteHouse是火山引擎上的一款云原生数据仓库,为用户带来极速分析体验,能够支撑实时数据分析和海量数据离线分析。便捷的弹性扩缩容能力,极致分析性能和丰富的企业级特性,助力客户数字化转型。全篇将从两个版块讲解... 各种各样的数据源都可以通过Kafka或者Flink写入到ByteHouse里面,然后来对接上层的应用。按照数仓分层角度,Kafka、Flink可以理解为ODS层,那ByteHouse就可以理解为DWD和DWS层。如果说有聚合或者预计算的场景,也可以...

数仓进阶篇@记一次BigData-OLAP分析引擎演进思考过程 | 社区征文

对数据进行分析与处理? ## 预期成熟的海量数据解决方案 **1、** 生态圈丰富,成功案例较多,开源; **2、** 统一数据中心,支持未来数据增长,动态扩展; **3、** 支持目前业务体系,标准化接... 兼顾数据仓库,具有实时,批处理,多并发等优点。**Java接入:** ![image.png]...

干货 | 这样做,能快速构建企业级数据湖仓

非结构化数据,支持多种场景的能力,同时也引入了 Data Warehouse 支持事务和数据质量的特点。LakeHouse 定义了一种叫我们称之为 **Table Format** 的存储标准。Table format 有四个典型的特征:* **支持 ACID 和历... Codegen 和向量化都是从数据仓库,而不是 Hadoop 体系的产品中衍生出来。Codegen 是 Hyper 提出的技术,而向量化则是 MonetDB 提出的,所以计算引擎的精细化也是沿着数仓开辟的路子在走。Spark 等 Hadoop 体系均走...

基于火山引擎 EMR 构建企业级数据湖仓

非结构化数据,支持多种场景的能力,同时也引入了 Data Warehouse 支持事务和数据质量的特点。LakeHouse 定义了一种叫我们称之为 Table Format 的存储标准。Table format 有四个典型的特征:- 支持 ACID 和历史... 都是从数据仓库而不是 Hadoop 体系的产品中长出来的:Codegen 是 Hyper 提出的技术,而向量化则是 MonetDB 提出的,所以计算引擎的精细化也是沿着数仓开辟的路子在走。Spark 等 Hadoop 体系均走了 Codegen 的道路,因为...

基于火山引擎 EMR 构建企业级数据湖仓

非结构化数据,支持多种场景的能力,同时也引入了 Data Warehouse 支持事务和数据质量的特点。LakeHouse 定义了一种叫我们称之为 **Table Format** 的存储标准。Table format 有四个典型的特征:* **支持 ACID 和历... 都是从数据仓库而不是 Hadoop 体系的产品中长出来的:Codegen 是 Hyper 提出的技术,而向量化则是 MonetDB 提出的,所以计算引擎的精细化也是沿着数仓开辟的路子在走。Spark 等 Hadoop 体系均走了 Codegen 的道路,因为...

基于Flink+Paimon的流式湖仓探索|社区征文

目前已经成为全球范围内实时流计算的事实标准。在实时数据存储方面, Apache Paimon作为面向流而设计的数据湖,支持大规模更新及流读,可以为用户提供高吞吐、低延迟的数据摄入、流式订阅以及实时查询能力。从使用角... 实时数仓分层随着行内业务对实时依赖度的不断增大,使得越来越多的业务指标需要加工,为了提高模型的复用率,同时兼顾易用性、一致性以及计算成本,因此项目决定搭建实时数据仓库。实时数据仓库的分层架构在设计上必...