kafka中的isr和ar

社区干货

社区干货

聊聊 Kafka:Topic 创建流程与源码分析 | 社区征文

## 一、Topic 介绍Topic(主题)类似于文件系统中的文件夹,事件就是该文件夹中的文件。Kafka 中的主题总是多生产者和多订阅者:一个主题可以有零个、一个或多个向其写入事件的生产者,以及零个、一个或多个订阅这些事... /bin/kafka-topics.sh --create --zookeeper localhost:2181 --partitions 3 --replication-factor 3 --topic topic_test```注:-–zookeeper 后面接的是 kafka 的 zk 配置, 假如你配置的是 localhost:2181/kafk...

Kafka@记一次修复Kafka分区所在broker宕机故障引发当前分区不可用思考过程 | 社区征文

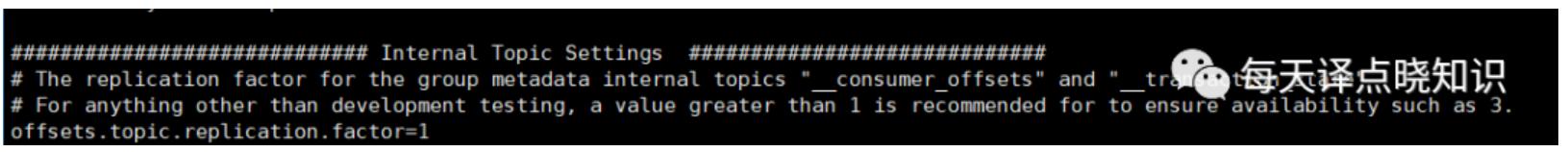

我们来看下Kafka的配置信息:```js[root@xx-xx-xxx-xx kafka_2.11-2.1.1]# nohup bin/kafka-server-start.sh config/server.properties & ```这里使用了默认的topic分区副本数量:offsets.topic.replication.factor=1,当分区副本数量为1,则副本信息只会存在某一个broker节点,Isr即其自身。...

字节跳动新一代云原生消息队列实践

相较于 Kafka 省去了 ISR 相关的管理。Controller 可以更加专注地关注集群整体流量均衡及故障检测。在 BMQ 中用户所有请求都会由 Proxy 接入,因此 BMQ 的 Metadata 中的 ‘Broker’ 信息实际上填写的是 BMQ 中 Proxy 的信息,客户端根据 Metadata 请求将生产和消费等请求发送到对应的 Proxy,再由 Proxy 处理或转发。这样的架构有助于 BMQ 做更多的容错工作。例如在 Broker 重启时,Proxy 可以感知到相关错误并进行 **退避重试...

字节跳动新一代云原生消息队列实践

相较于 Kafka 省去了 ISR 相关的管理。Controller 可以更加专注地关注集群整体流量均衡及故障检测。在 BMQ 中用户所有请求都会由 Proxy 接入,因此 BMQ 的 Metadata 中的 ‘Broker’ 信息实际上填写的是 BMQ 中 Proxy 的信息,客户端根据 Metadata 请求将生产和消费等请求发送到对应的 Proxy,再由 Proxy 处理或转发。这样的架构有助于 BMQ 做更多的容错工作。例如在 Broker 重启时,Proxy 可以感知到相关错误并进行 **退避重试...

特惠活动

特惠活动

kafka中的isr和ar-优选内容

kafka中的isr和ar-优选内容

kafka中的isr和ar-相关内容

kafka中的isr和ar-相关内容

字节跳动新一代云原生消息队列实践

相较于 Kafka 省去了 ISR 相关的管理。Controller 可以更加专注地关注集群整体流量均衡及故障检测。在 BMQ 中用户所有请求都会由 Proxy 接入,因此 BMQ 的 Metadata 中的 ‘Broker’ 信息实际上填写的是 BMQ 中 Proxy 的信息,客户端根据 Metadata 请求将生产和消费等请求发送到对应的 Proxy,再由 Proxy 处理或转发。这样的架构有助于 BMQ 做更多的容错工作。例如在 Broker 重启时,Proxy 可以感知到相关错误并进行 **退避重试...

查看 Topic 详情

创建 Topic 后,您可以随时在控制台中查看 Topic 和对应分区的详细信息,包括 Topic 详情、分区信息、消费连接信息。 前提条件已创建消息队列 Kafka版实例。详细操作步骤请参考创建实例。 查看 Topic 详情您可以参考以下操作步骤,查看指定 Topic 的详情页。 登录消息队列 Kafka版控制台。 在顶部菜单栏中选择地域,并在左侧导航栏中单击实例列表。 找到目标实例,单击实例名称。 在页签栏中单击Topic管理。 找到目标 Topic,查看其基本...

干货|字节跳动流式数据集成基于Flink Checkpoint两阶段提交的实践和优化(1)

> > 字节跳动开发套件数据集成团队(DTS ,Data Transmission Service)在字节跳动内基于 Flink 实现了流批一体的数据集成服务。其中一个典型场景是 Kafka/ByteMQ/RocketMQ -> HDFS/Hive 。Kafka/ByteMQ/RocketMQ ->... Flink 通过在数据流中注入 barriers 将数据拆分为一段一段的数据,在不终止数据流处理的前提下,让每个节点可以独立创建 Checkpoint 保存自己的快照。每个 barrier 都有一个快照 ID ,在该快照 ID 之前的数据都会进入...

字节跳动 Flink 状态查询实践与优化

可以通过查询任务快照中的 State 获取有效线索。 但目前对于 Flink SQL 任务来说,当我们想要查询作业 State 时,通常会因为无法获知 State 的定义方式和具体类型等信息,而导致查询 State 的成本过高。... =&rk3s=8031ce6d&x-expires=1713630033&x-signature=6sTq8qDVisrByjWQQMtShMEjD8I%3D)提到状态查询,我们自然会联想到 Flink 在 1.9 版本提出的特性 -- State Processor API。使用 State Processor API,我们可以...

Presto 在字节跳动的内部实践与优化

业务数据以及线上日志类数据存储在 MQ 和 Kafka。计算引擎根据业务类型不同,Presto 支撑了 Ad-hoc 查询、部分 BI 报表类查询,SparkSQL 负责超大体量复杂分析及离线 ETL、Flink 负责流式数据清洗与导入。