ByteHouse 是一款火山引擎云原生数据仓库,为您提供极速分析体验,能够支撑实时数据分析和海量数据离线分析等场景。

DataSail 中的 ByteHouse 云数仓版数据源配置,为您提供读取和写入 ByteHouse 的双向通道数据集成能力,实现不同数据源与 ByteHouse 之间进行数据传输。

本文为您介绍 DataSail 的 ByteHouse 数据源的配置操作。

1 支持的 ByteHouse 版本

支持火山引擎 ByteHouse 云数仓版(ByteHouse_CDW)标品。开通服务详见快速开始。

2 使用前提

配置 ByteHouse 云数仓版数据源前,您需先进行以下操作:

- 开通 ByteHouse 云数据仓版服务。开通服务详见快速开始。

- 已创建 ByteHouse 数据库,详见数据库表及视图。

- 已创建合适资源规格的独享数据集成资源组,并将其绑定至创建成功的 DataLeap 项目下。购买操作详见资源组管理,项目绑定操作详见数据集成资源组。

3 使用限制

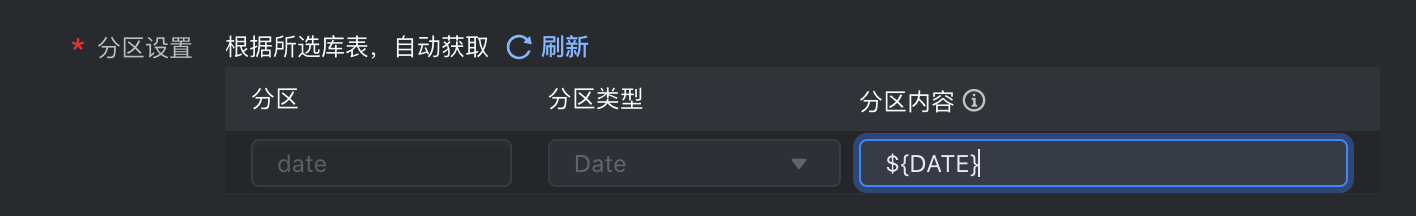

因为 ByteHouse Date 类型的格式限制,如果分区字段类型是 Date,分区内容请填写为 ${DATE}。如果需要写入具体的分区,需按照 yyyy-MM-dd 格式填写。

数据集成任务需要使用独享集成资源组,您需根据实际业务需求,购买相应规格的独享集成资源组。开通资源组详见资源组管理。

ByteHouse CDW 数据源接入方式为连接串模式,配置 ByteHouse CDW 批式写时,暂不支持目标表一键建表功能;配置解决方案中 ByteHouse CDW 写入时,暂不支持自动建表操作。您需手动在目标库表中创建相应的数据表。

DataSail 解决方案中,目标端为 ByteHouse CDW 数据源,在源表和目标表映射中使用已有的 ByteHouse CDW 表时,需保证表结构中必须包含唯一键字段。

ByteHouse CDW 数据源用于配置实时整库同步解决方案,用实时 CDC 方式读取 ByteHouse CDW 数据表时,需满足以下条件:

- ByteHouse CDW 数据源注册配置时,需要使用“火山引擎 ByteHouse 云数仓版”方式接入,连接串模式暂不支持获取源端 Binlog 信息。

- ByteHouse CDW 集群的引擎版本需为 2.3.1 及以上,方可支持 Binlog 消费能力。引擎版本,您可在 ByteHouse 控制台 → 租户管理 → 基础信息中查看。若版本不符合要求时,您可通过提工单的方式,咨询 ByteHouse 同学进行操作。

- 在使用实时整库同步解决方案自动创建 ByteHouse CDW 表时,若要使该表后续具备 Binlog 读取能力,则需要在映射配置 → 高级参数配置处,手动添加高级参数

solution.writer.common.ddl.bytehouse.enable.binlog=true,如此创建的表方可后续支持 Binlog 读取。 - 若是手动创建的 ByteHouse CDW 表,则表的 SETTINGS 参数中必须包含

enable_binlog = 1这一属性参数;存量的表可以通过 ALTER TABLE 语句加上这个参数,如alter table database.name modify setting enable_binlog = 1;

独享数据集成资源组,需要具有 ByteHouse CDW 数据库的网络访问能力,网络互通方案如下:

网络配置方式

操作方式

公网

ByteHouse CDW 数据源可通过公网的方式进行访问,因此独享数据集成资源组需要开通公网能力来访问数据库,操作步骤详见:资源组VPC开通公网。

注意

- 查看资源组绑定的VPC:

- 进入私有网络界面,创建 NAT 网关,并绑定资源组对应的 VPC 信息:

- 配置公网IP:

- 创建完公网 NAT 网关后,在 NAT 列表页面,右侧操作栏中,单击配置公网IP。

- 单击绑定公网IP,下拉框中,选择可绑定的公网 IP,若无可用的公网 IP,可前往 申请公网IP 页面申请。申请操作详见:https://www.volcengine.com/docs/6402/69430。

- 配置 SNAT 规则【不要忘记这一步!!!】

绑定完公网 IP 后,上方功能栏中,切换到SNAT规则,单击创建SNAT规则,选择资源组中对应的 VPC,完成配置。后续该VPC即可访问公网Internet。

火山引擎内网

ByteHouse CDW 同时也支持通过 VPC 内网形式访问连接,主账号需进入 ByteHouse CDW 租户管理界面绑定相关网络信息。操作流程如下:

- 主账号登录 ByteHouse CDW 控制台。

- 在上方导航栏中,切换至租户管理界面。

- 在网络信息 > 私网域名处,单击绑定按钮,并在右侧弹窗中完成绑定私网操作。

- 绑定私网时选择的 VPC、子网、安全组等信息,需和独享集成资源组中绑定的网络信息保持一致,以保障与独享集成资源组网络互通。

更多绑定操作,详见设置网络信息。

- 查看资源组绑定的VPC:

4 数据源注册

说明

在多环境模式的项目下,数据源能够开发环境与生产环境实现注册隔离。并且在进行离线集成任务配置时,多环境下的数据源信息均需要进行注册。新建数据源操作详见2 新建数据源。

下面为您介绍火山引擎 ByteHouse 云数仓版数据源不同接入方式的配置信息。其中参数名称前带 * 的为必填参数,名称前未带 * 的为可选填参数。

4.1 火山引擎 ByteHouse 云数仓版方式接入

参数 | 说明 |

|---|---|

基本配置 | |

数据源类型 | ByteHouse 云数仓版 |

接入方式 | 火山引擎 ByteHouse 云数仓版 |

数据源名称 | 数据源的名称,可自行设置,仅支持中文,英文,数字,“_”,100个字符以内。 |

参数配置 | |

环境 | ByteHouse 云数仓版支持选择多环境实例管理,下拉选择 ByteHouse 云数仓版中具体的环境名称信息。默认为 ByteHouse 云数仓中 default 环境。ByteHouse 云数仓版多环境操作,详见环境管理。 |

*ByteHouse 库 | 下拉选择已在 ByteHouse 云数仓版对应环境中创建的数据库名称信息。 |

*计算组 | ByteHouse_CDW 对应环境中查询使用的计算组。详见 ByteHouse CDW 计算组。 注意 选择计算组时,需确保计算组使用率在 80% 以下,若超过 80% 会导致任务执行时写入异常,需进行扩容。扩容操作详见计算组规格变更。 |

*鉴权方式 | 选择任务执行时需要的鉴权方式,可选择 API Token 或密码鉴权方式接入。

|

API Token | ByteHouse_CDW 租户管理中的 Access Key 信息。ByteHouse 读取数据的时候需要使用,建议绑定一个长效 Token,避免 Token 过期出现任务异常。 说明 使用数据同步解决方案写入、JDBC 连接方式写入和离线读取 ByteHouse CDW 时,API Token 必须填写。 |

用户名/密码 | 当鉴权方式选择为密码鉴权时,需填写数据库表有权限的用户名和密码信息。 |

4.2 连接串方式接入

参数 | 说明 |

|---|---|

基本配置 | |

数据源类型 | ByteHouse 云数仓版 |

接入方式 | 连接串 |

数据源名称 | 数据源的名称,可自行设置,仅支持中文,英文,数字,“_”,100个字符以内。 |

参数配置 | |

环境 | ByteHouse 云数仓版支持选择多环境实例管理,下拉选择 ByteHouse 云数仓版中具体的环境名称信息。默认为 ByteHouse 云数仓中 default 环境。ByteHouse 云数仓版多环境操作,详见环境管理。 |

JDBC URL | 根据数据库所在地域,选择填写 ByteHouse CDW 的 JDBC URL 地址信息,格式如下:

说明 地址信息中的租户 ID 和地域信息需根据实际情况进行替换。地址获取方式详见调用方式。 |

*API Server | 根据数据库所在地域,选择填写 ByteHouse CDW 的 API Server 地址,格式如下:

说明 地址信息中的租户 ID 和地域信息需根据实际情况进行替换。地址获取方式详见调用方式。 |

*数据库名 | 输入已在 ByteHouse 云数仓版中创建的数据库名称信息。 |

*计算组 | ByteHouse_CDW 中查询使用的计算组。详见 ByteHouse CDW 计算组。 |

*鉴权方式 | 选择任务执行时需要的鉴权方式,可选择 API Token 或密码鉴权方式接入。

|

*API Token | ByteHouse_CDW 租户管理中的 Access Key 信息。ByteHouse 读取数据的时候需要使用,建议绑定一个长效 Token,避免 Token 过期出现任务异常。 说明 使用数据同步解决方案写入、JDBC 写入方式和离线读取 ByteHouse CDW 时,API Token 必须填写。 |

用户名/密码 | 当鉴权方式选择为密码鉴权时,需填写数据库表有权限的用户名和密码信息。 |

4.3 测试连通性

参数项填写完整后,勾选已绑定的独享集成资源组,并单击上方测试按钮,执行测试连通性。同时,您可展开资源组 ID,查看该资源组所属 VPC 下各子网的网络连通情况,您需确保各子网均能与数据源连通,避免因子网连通问题导致任务执行异常。

若当前是多环境项目时,您需进行资源组的生产环境测试、开发环境测试连通性,确保不同环境数据源使用的资源组,网络均能正常连通。

连通性测试成功后,单击确定按钮,在弹窗中完成可用资源组的选择后,便可完成新增。

5 后续步骤

数据源创建完成后,您可以进行后续的 ByteHouse CDW 集成任务配置,详见:配置 ByteHouse 云数仓版任务。